💡

原文中文,约4800字,阅读约需12分钟。

📝

内容提要

顿悟现象是指模型在学习任务时,经历记忆期、平台期和泛化期,突然出现学习规律的现象。研究表明,顿悟现象本质上是在学习输入数字的表征。目前,尚未明确指出顿悟现象与大型语言模型的涌现现象之间的关系,但两者存在某些关联。

🎯

关键要点

- 顿悟现象是模型学习过程中突然出现学习规律的现象,经历记忆期、平台期和泛化期。

- 研究表明,顿悟现象与大型语言模型的涌现现象之间存在某些关联,但尚未明确关系。

- 涌现现象是复杂系统中微小个体相互作用后在宏观层面展现的特殊现象。

- 大语言模型的规模增长对下游任务的影响表现为三类任务:伸缩法则、涌现能力和U形曲线。

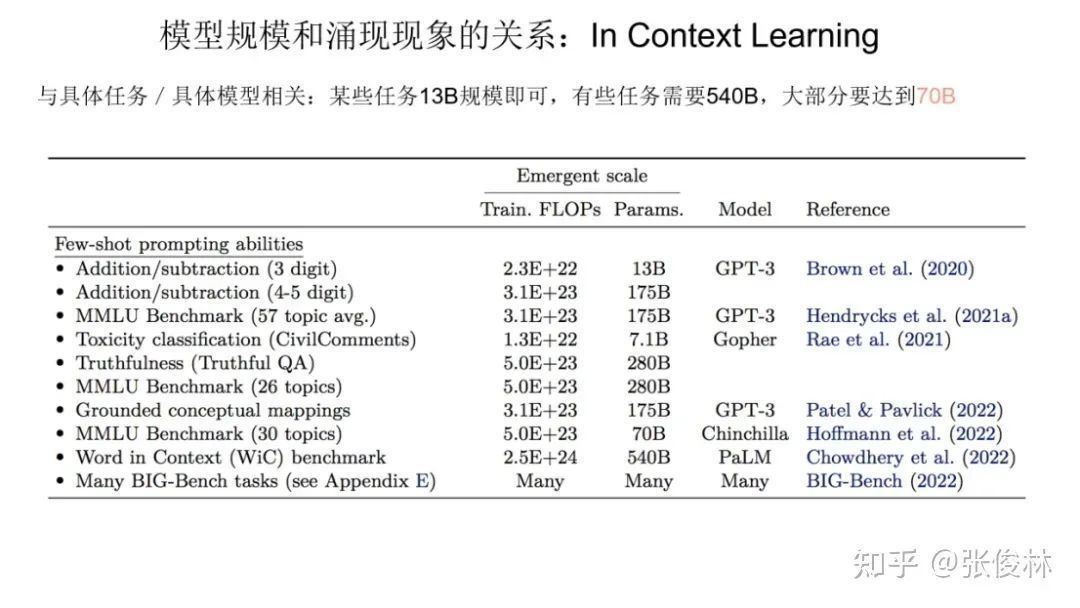

- In Context Learning和思维链(CoT)是被认为具有涌现能力的两类任务。

- 涌现能力与模型规模有一定关联,不同任务对模型规模的要求不同。

- 小模型是否具备涌现能力的问题值得探讨,Chinchilla和LLaMA模型的研究表明小模型也可能具备涌现能力。

- 顿悟现象(Grokking)在模型训练中表现为模型突然学会任务规律,研究表明其本质是学习输入数字的表征。

- 目前尚未有研究明确指出顿悟现象与涌现现象之间的关系,需进一步探索两者的联系。

➡️