长上下文中的语言模型RAG性能

原文英文,约4500词,阅读约需17分钟。发表于:。Retrieval Augmented Generation (RAG) is the most widely adopted generative AI use case among our customers. RAG enhances the accuracy of LLMs by...

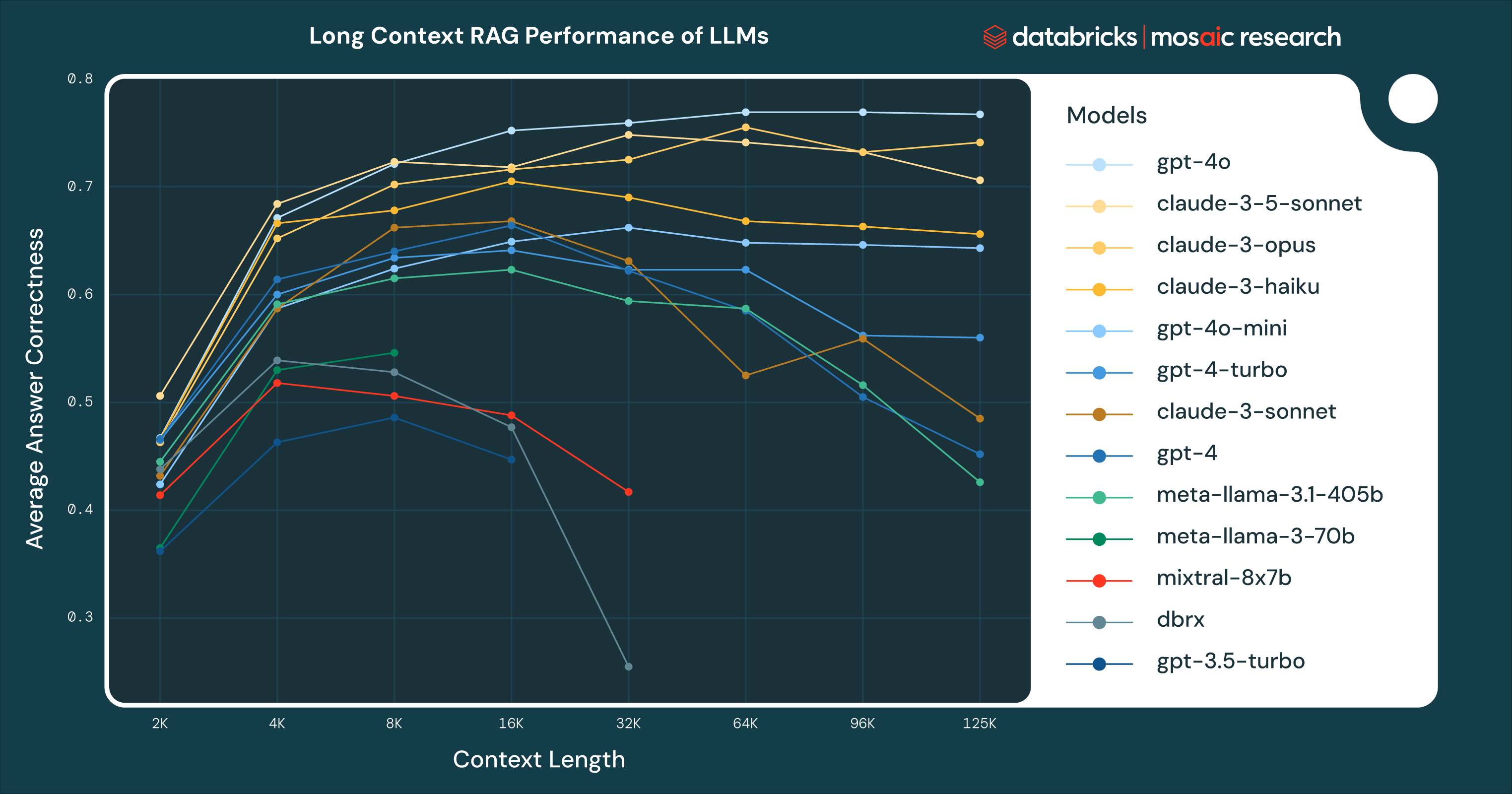

检索增强生成(RAG)是生成式人工智能的一个流行应用。语言模型中更长的上下文长度可以通过检索更相关的信息来提高RAG的性能。然而,存在一个饱和点,更长的上下文并不总是能提高性能。不同的模型在长上下文中以不同的方式失败,例如提供错误答案或拒绝遵循指令。开发者需要仔细选择要包含在上下文中的文档数量。总体而言,更长的上下文模型和RAG是相辅相成的,但在长上下文性能方面仍有改进空间。