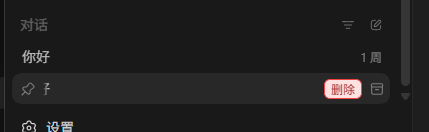

EP217:延迟与吞吐量与带宽

ByteByteGo Newsletter

·

OpenCV 5发布:计算机视觉领域多年来最大的飞跃

OpenCV

·

为什么你的深度学习模型无法学习:诊断医学成像中的数据问题

freeCodeCamp.org

·

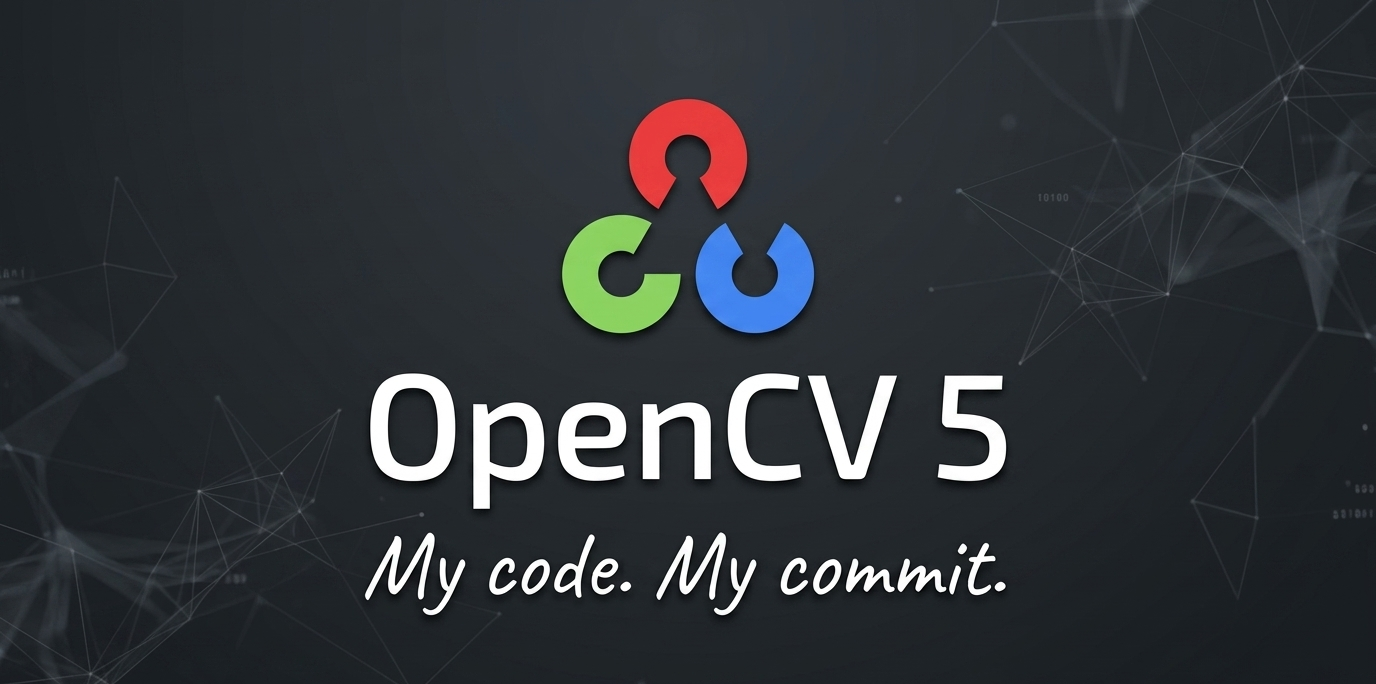

GeCo2:基于渐进式查询聚合的通用尺度目标计数模型部署实践

dotNET跨平台

·

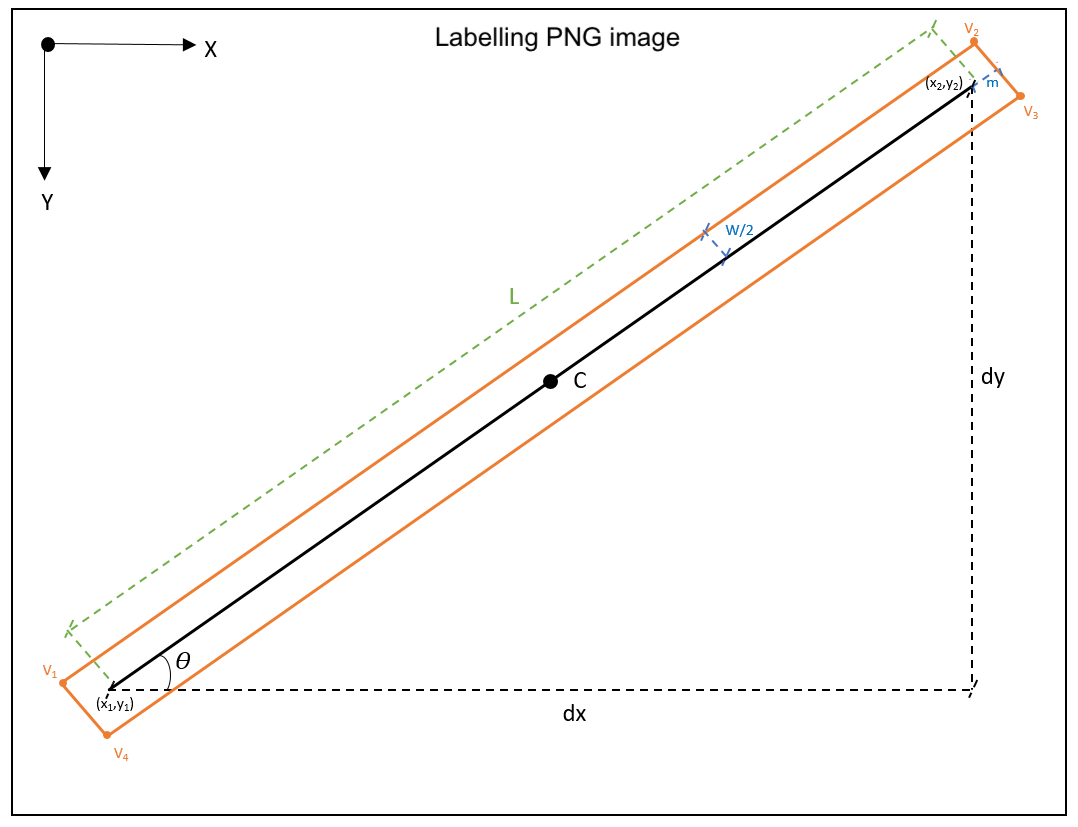

精确率达94%,西班牙团队基于YOLO11实现自动化近地天体与卫星条纹检测,连续帧之间稳定识别

HyperAI超神经

·

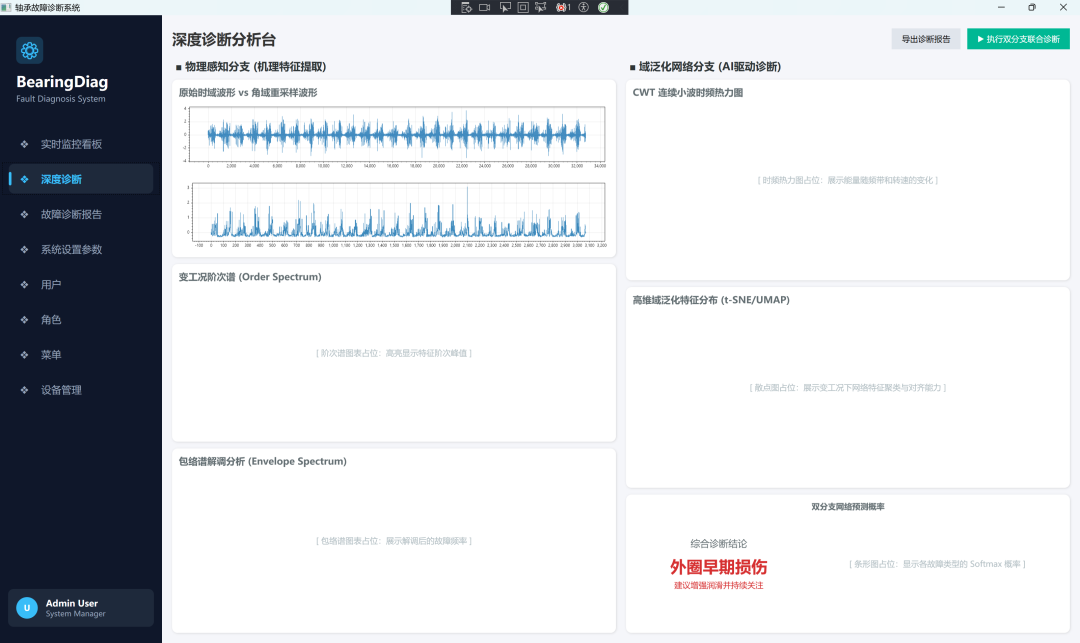

.NET 8 高性能跨平台设备健康监测上位机系统

dotNET跨平台

·

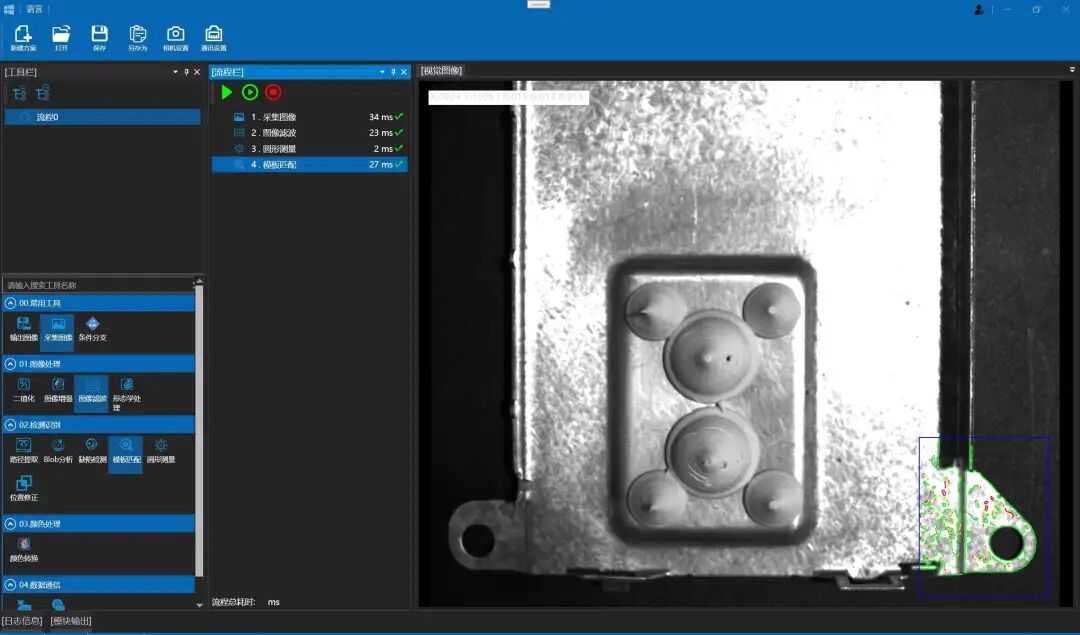

WPF + Halcon + YOLO 工业视觉检测的全能上位机

dotNET跨平台

·

玩美移动升级AI面部分析解决方案

全球TMT-美通国际

·

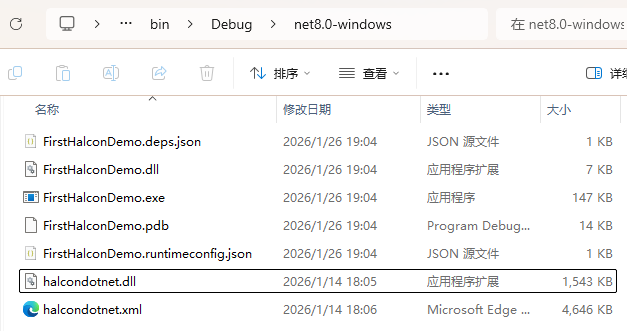

WPF/C#:创建第一个Halcon应用

dotNET跨平台

·