LaCy:小型语言模型可以和应该学习的内容不仅仅是损失问题

Apple Machine Learning Research

·

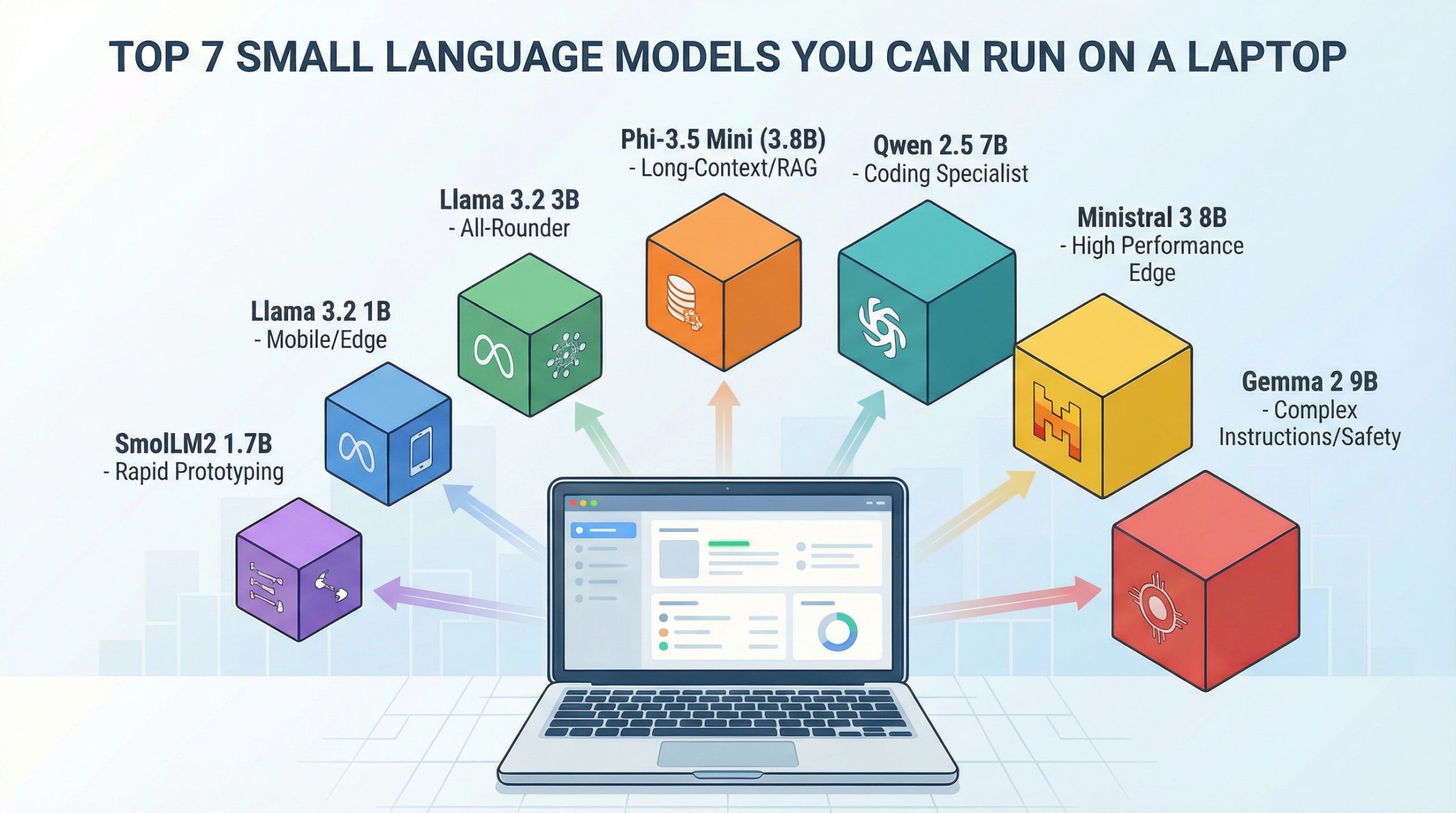

可在笔记本电脑上运行的七种小型语言模型

MachineLearningMastery.com

·

通过NVIDIA MPS扩展小型语言模型

Databricks

·

小型语言模型与大型语言模型:为何小型AI模型在商业中更具优势

The New Stack

·

通过小型语言模型(SLM)和检索增强生成(RAG)构建更便宜、更安全、可审计的人工智能

The New Stack

·

基于层次记忆的预训练:区分长尾知识与常识

Apple Machine Learning Research

·

2026年的数据:可互换模型、云服务与专业化

The New Stack

·

使小型语言模型能够解决复杂推理任务

MIT News - Computer Science and Artificial Intelligence Laboratory (CSAIL)

·

如何在不降低能力的情况下降低人工智能成本:小型语言模型的崛起

freeCodeCamp.org

·

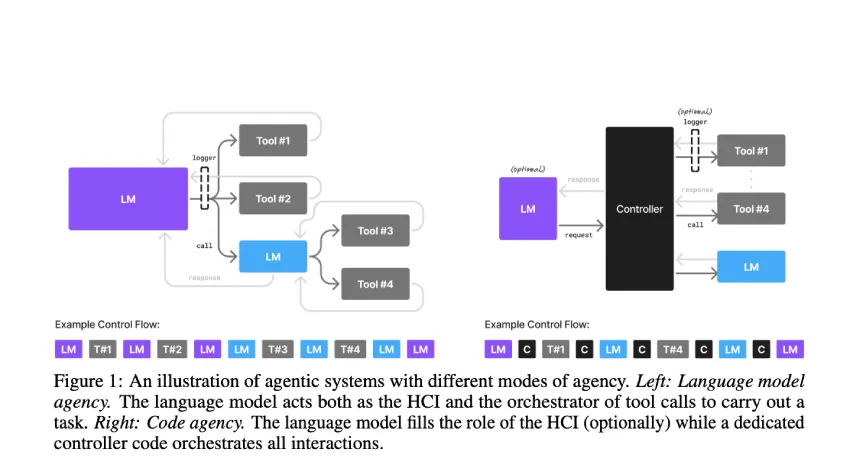

人工智能架构

Alex Ewerlöf Notes

·

介绍:本地浏览器AI

Alex Ewerlöf Notes

·

七大顶尖小型语言模型

KDnuggets

·

小型语言模型是自主人工智能的未来

MachineLearningMastery.com

·

云原生与开源助力扩展智能代理AI工作流

The New Stack

·