去中心化人工智能:安全、更智能和更具主权未来的蓝图

DEV Community

·

AGI前夜的思考 [译]

宝玉的分享

·

推进人工智能治理

OpenAI

·

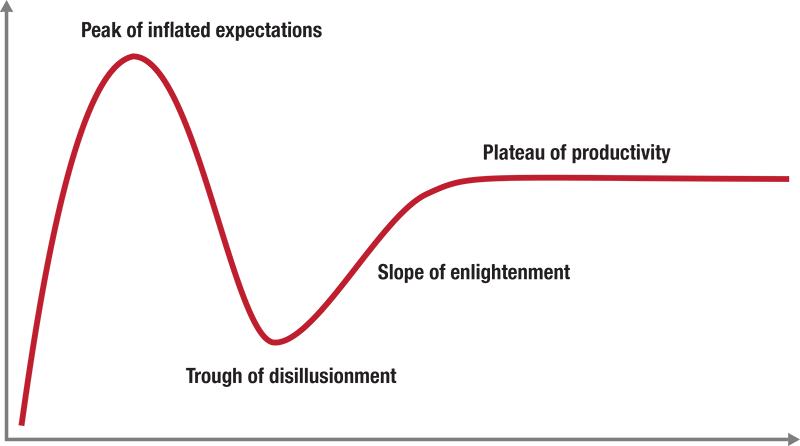

人工智能与炒作周期:被高估、被忽视,最终……不可或缺?

Ben Morris. Agile enterprise architecture.

·