解决“打地鼠困境”:一种更智能的去偏见AI视觉模型的方法

MIT News - Artificial intelligence

·

你的logit值知道什么?(答案可能会让你惊讶!)

Apple Machine Learning Research

·

SafetyPairs:通过反事实图像生成隔离安全关键图像特征

Apple Machine Learning Research

·

TrajTok:学习轨迹标记以提升视频理解

Apple Machine Learning Research

·

一种更好的复杂视觉任务规划方法

MIT News - Artificial intelligence

·

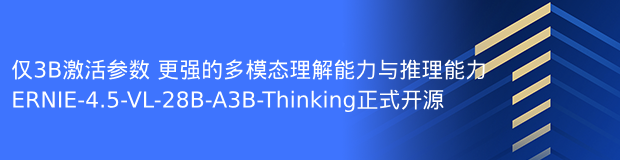

“See_you“:“Next Moment“

百度大脑

·

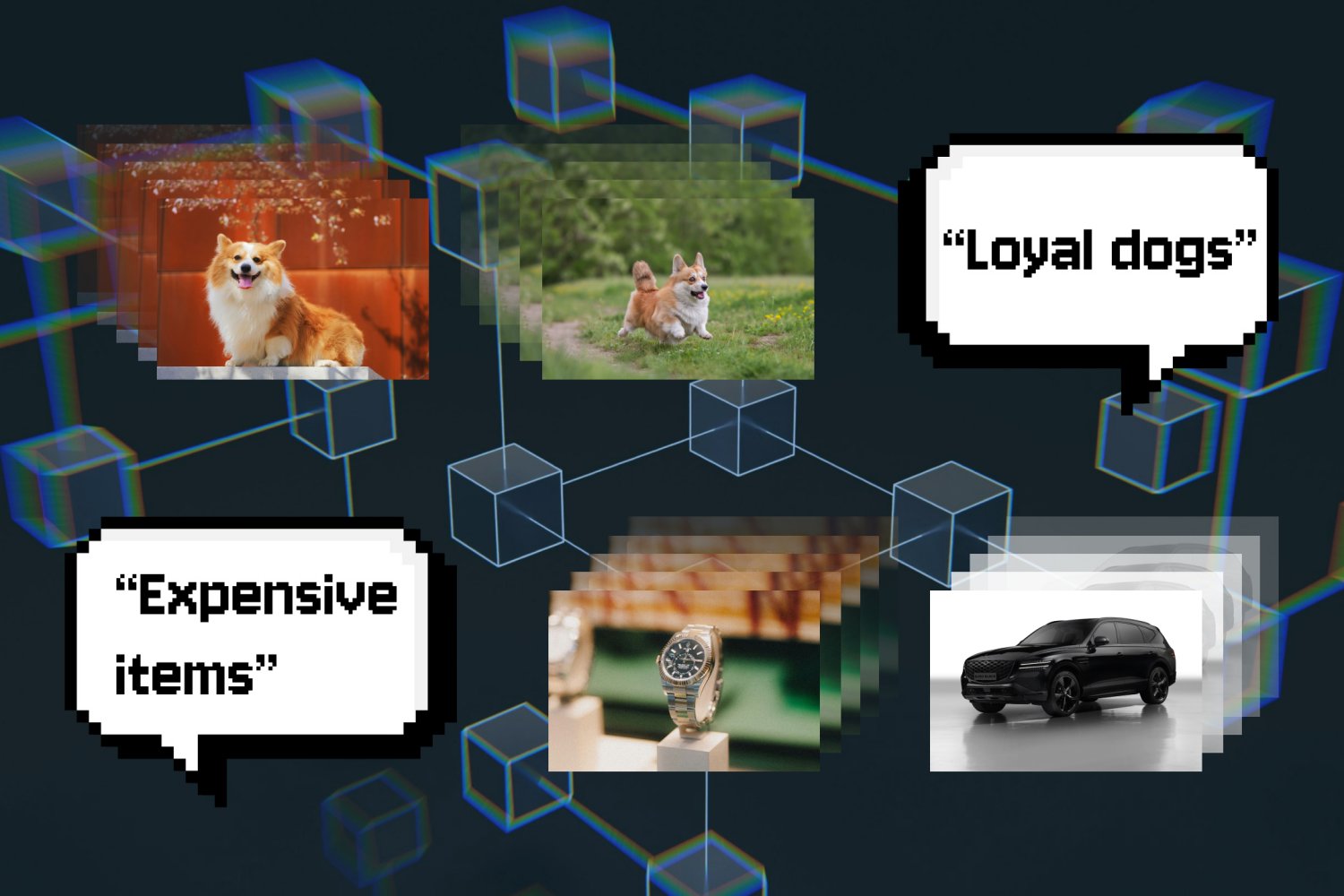

如何在自己的数据上对嵌入模型进行基准测试

freeCodeCamp.org

·

2.5亿美元的文件

ByteByteGo Newsletter

·

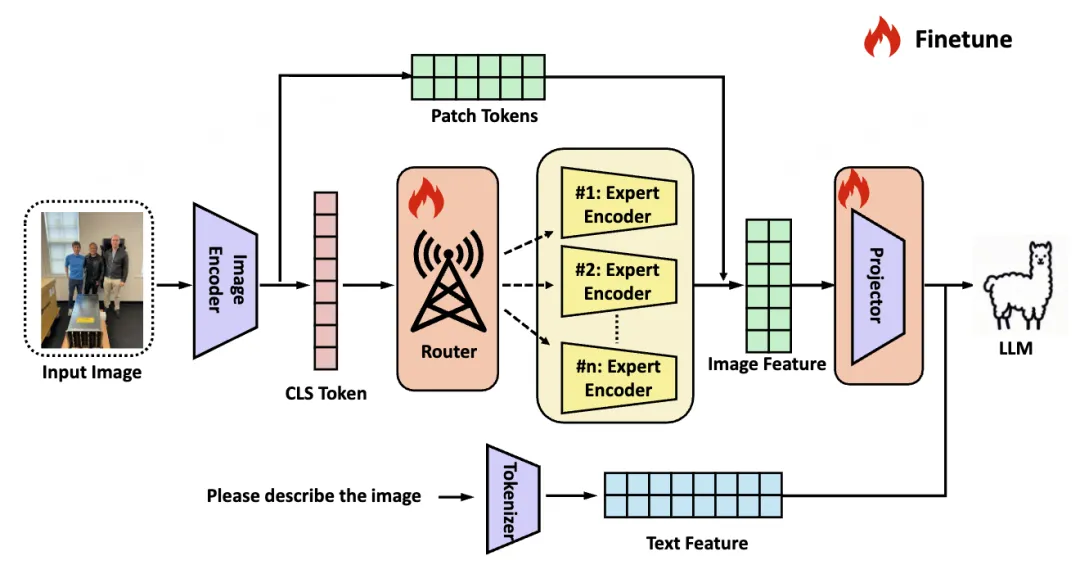

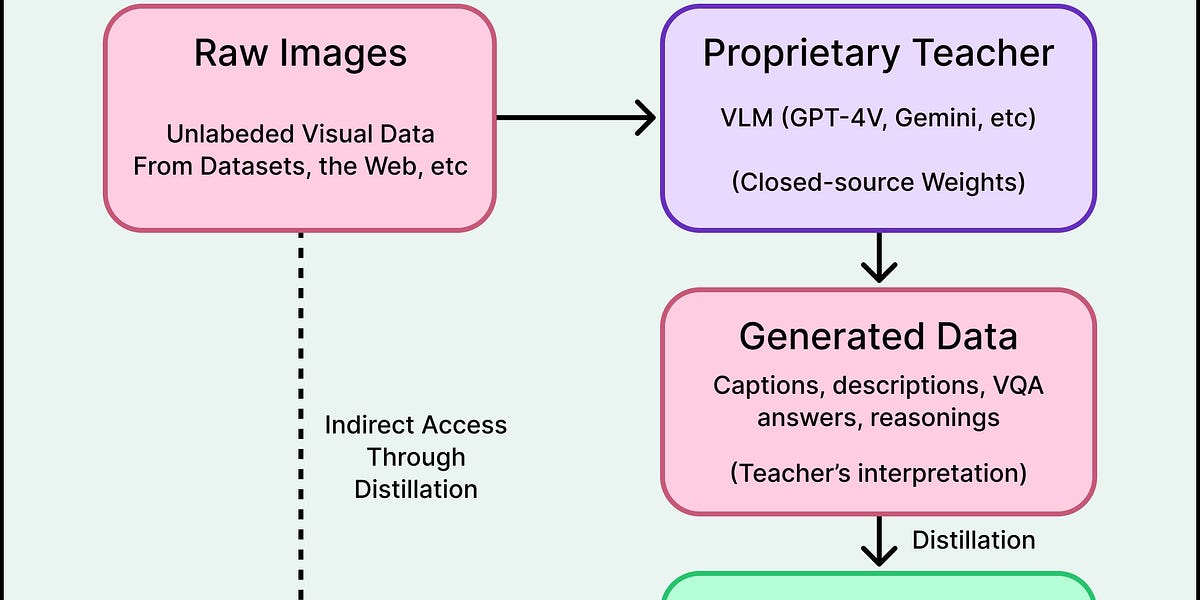

Jina-VLM:小型多语言视觉语言模型

Jina AI

·

使用Amazon Nova模型实现自动化视频高光剪辑

亚马逊AWS官方博客

·