GitHub资深人士Brian Douglas创立Paper Compute以改善AI代理基础设施

The New Stack

·

Beyond compute: Infrastructure that powers and cools AI data centers

McKinsey Insights & Publications

·

服务器渲染基准测试:Fluid Compute与Cloudflare Workers

Vercel News

·

Modular:SF Compute与Modular合作革新AI推理经济

Modular Blog

·

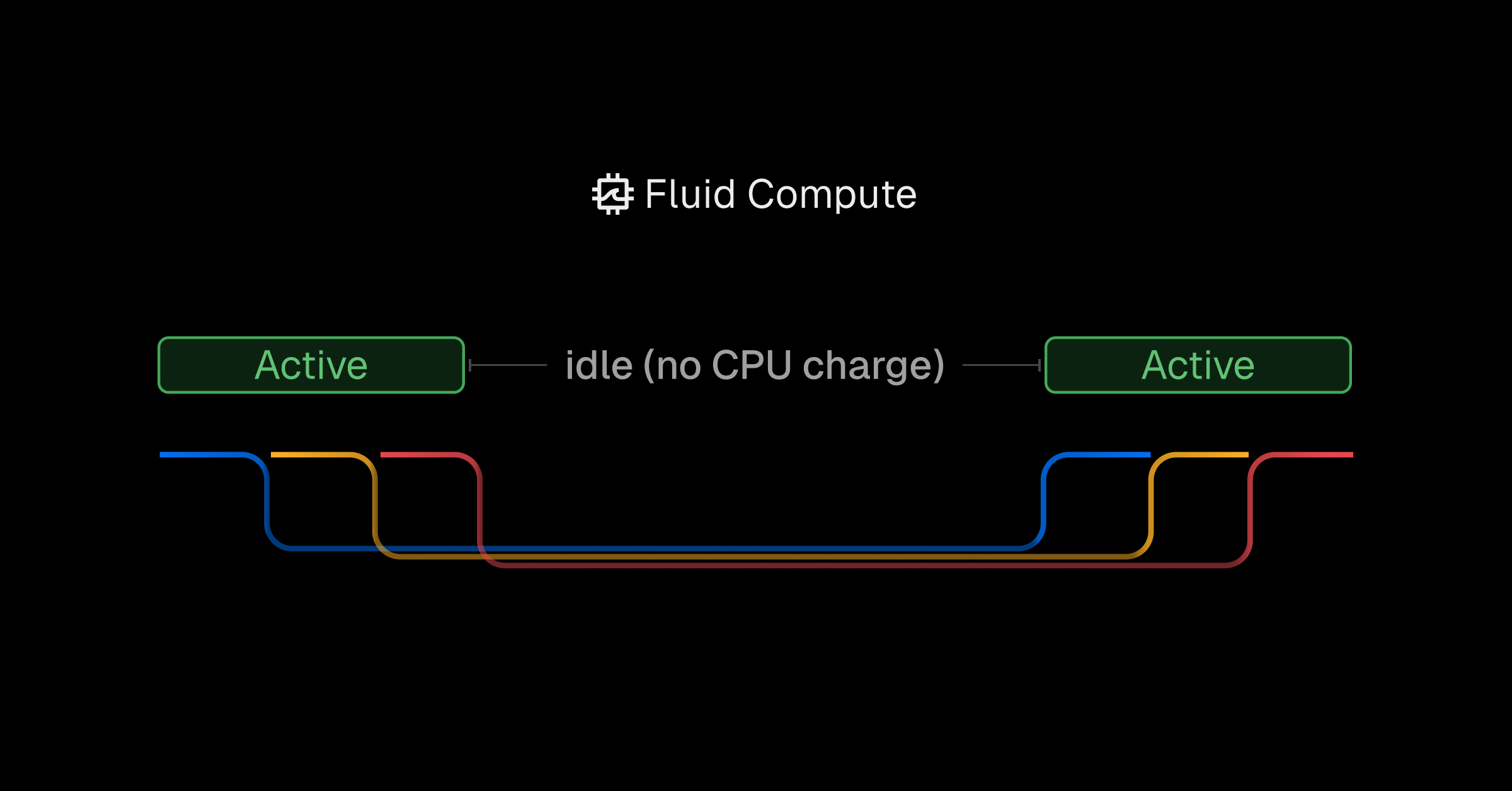

Fluid Compute的主动CPU定价降低了费用

Vercel News

·

Fluid Compute 现已支持 ISR 背景和按需重新验证

Vercel News

·

💰 使用AWS Compute Optimizer进行成本优化

DEV Community

·

掌握GSP313:在Google Cloud Compute Engine上实现负载均衡的逐步指南

DEV Community

·

Vercel Secure Compute 现在支持多种环境

Vercel News

·

如何防止Google Compute Engine中的性能瓶颈:CPU峰值、内存浪费和网络过载

engineering on Grafana Labs

·