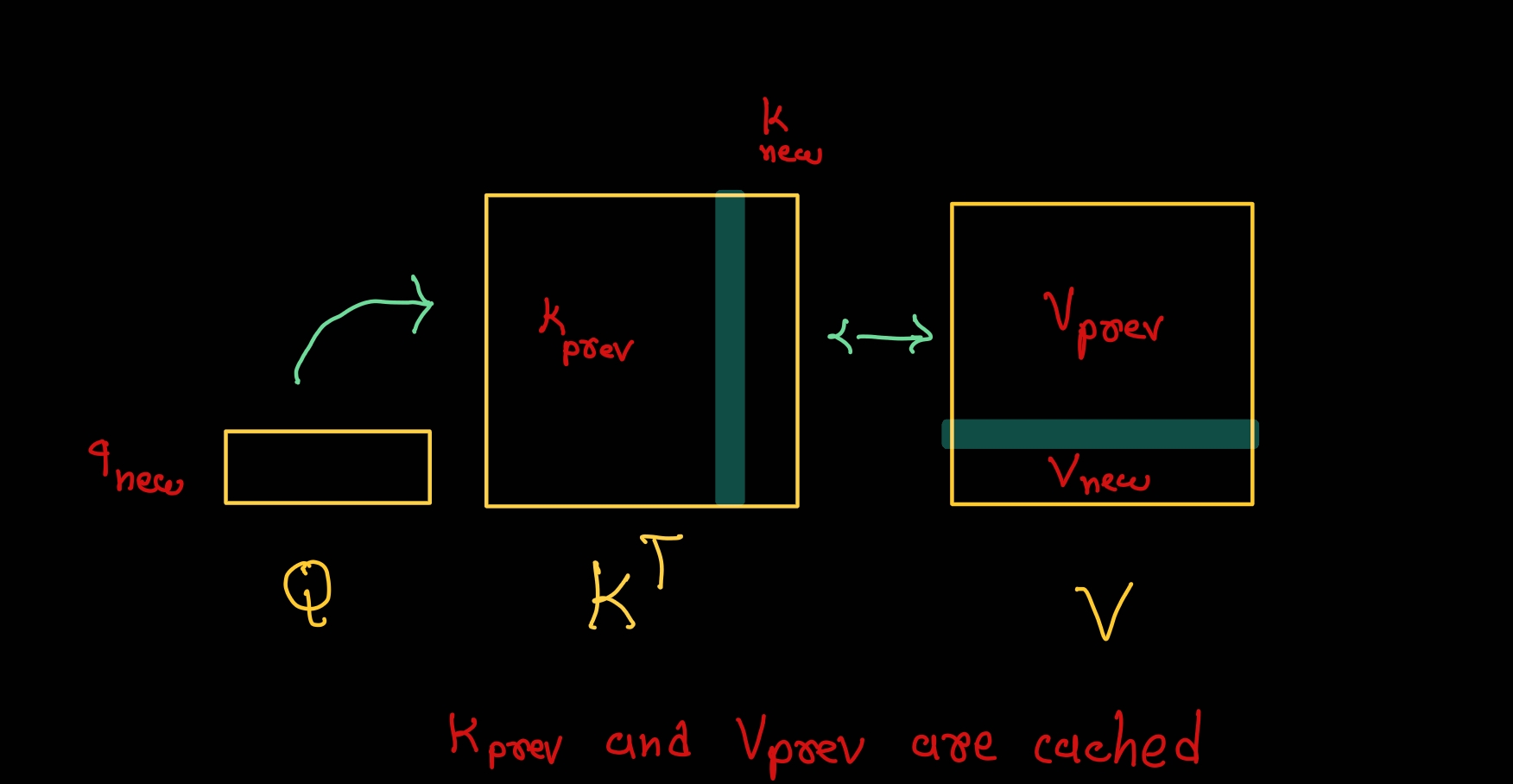

跑大模型,最贵的不是 GPU,是这个东西

迷途小书童

·

英特尔首款手持游戏芯片为Arc G3,Acer将率先使用

The Verge

·

基于 KEDA 的 Kubernetes GPU 自动扩展:构建外部扩展器

Cloud Native Computing Foundation

·

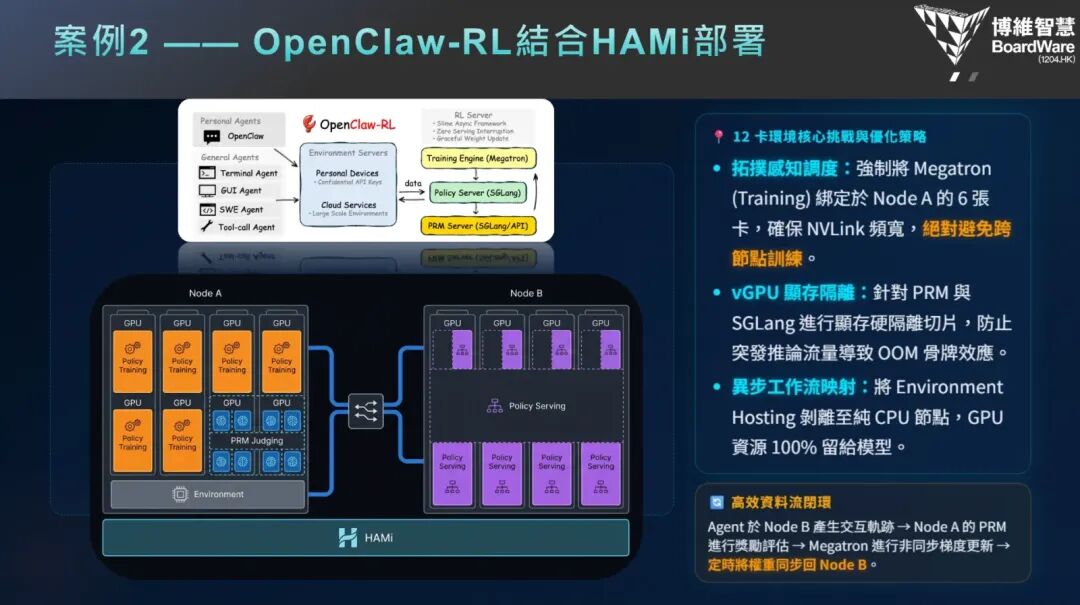

告别 GPU 独占时代:用 HAMi 实现训练推理一体化——博维智慧 GPU 虚拟化实战

dotNET跨平台

·

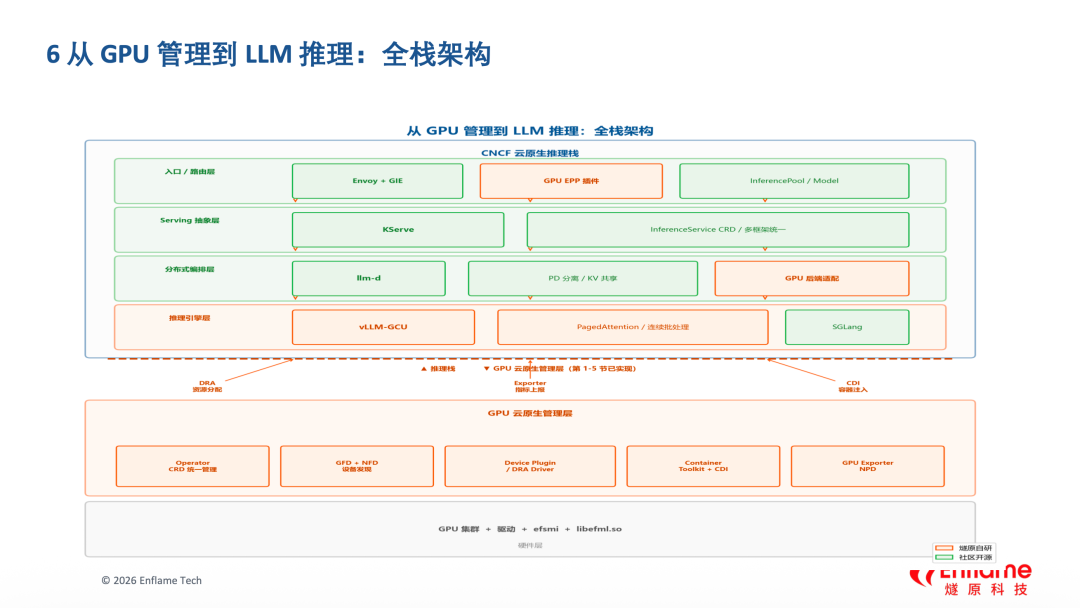

国产 GPU 如何丝滑融入 K8s?燧原科技的全栈云原生实践

dotNET跨平台

·