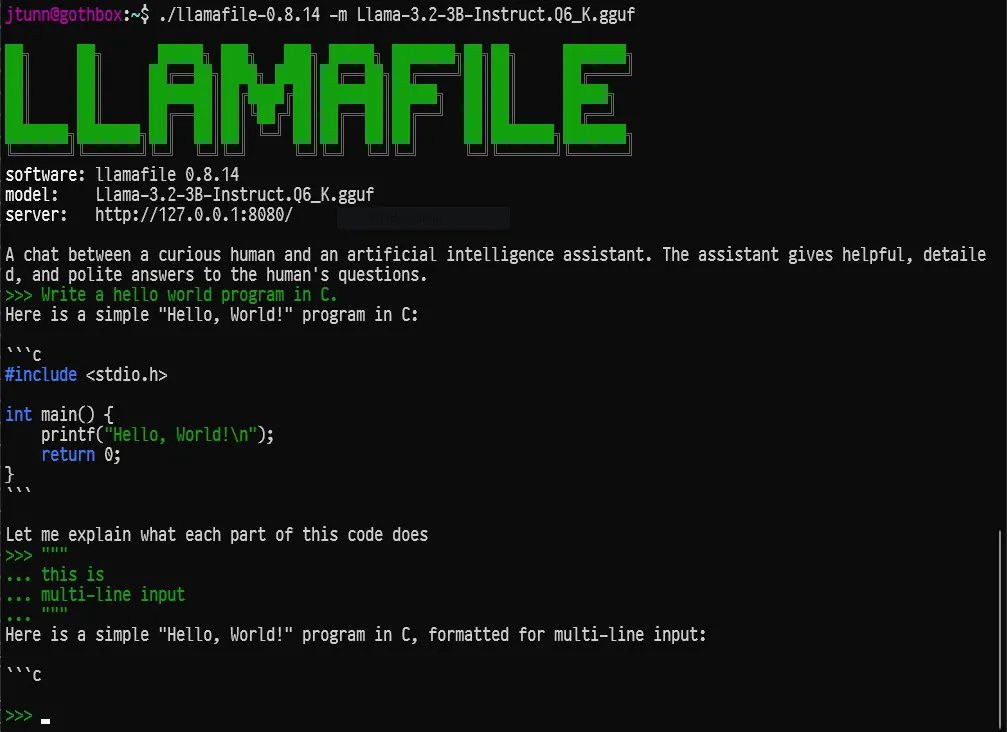

在 Supabase Edge Functions 中使用 Mozilla Llamafile

Blog - Supabase

·

使用LlamaIndex和llamafile构建本地私有研究助手

Blog on LlamaIndex

·

使用llamafile轻松分发和运行LLMs的五个简单步骤

KDnuggets

·