Databricks将GPT-5.5引入企业代理工作流

OpenAI

·

何恺明首个语言模型:不走GPT老路,105M参数干翻主流

dotNET跨平台

·

我测试了OpenAI关于GPT-5.5 Instant的三个说法,只有一个完全成立

The New Stack

·

人工智能论文评审:语言模型是无监督的多任务学习者(GPT-2)

freeCodeCamp.org

·

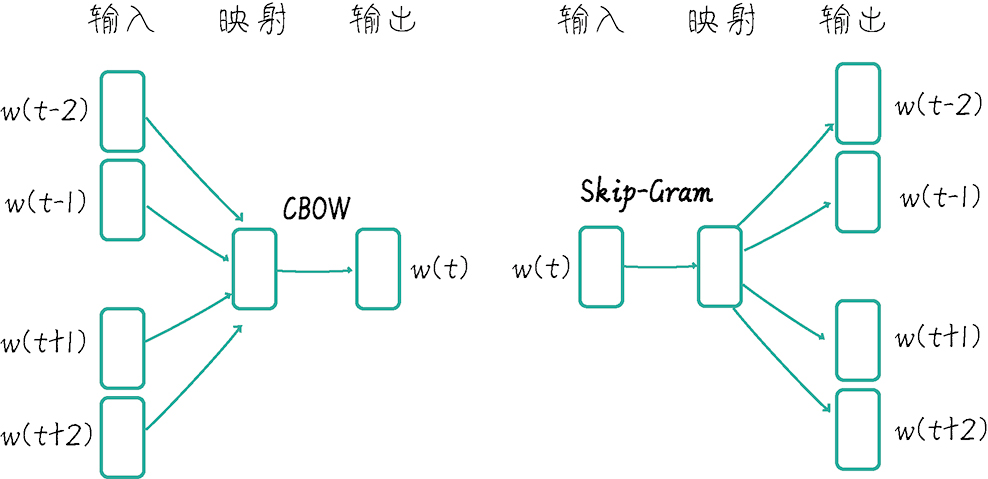

《GPT 图解》笔记:N-Gram、NPLM、LSTM

Ying’s Blog

·

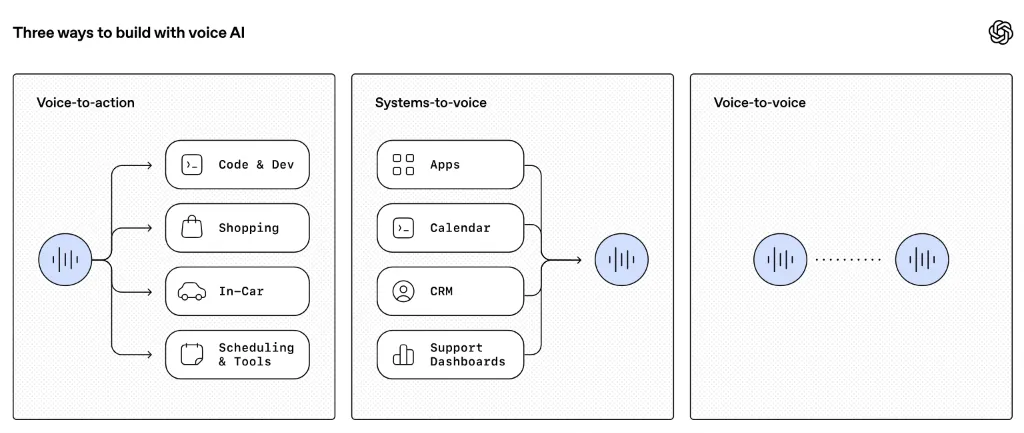

终于能听 GPT-5 给我说人话了

爱范儿

·

OpenAI将GPT-5级推理引入其语音模型

The New Stack

·

利用GPT-5.5和GPT-5.5-Cyber扩展网络安全的可信访问

OpenAI

·

AI论文评审:通过生成预训练(GPT-1)提升语言理解

freeCodeCamp.org

·