标签

llama

相关的文章:本列表汇集了关于Llama模型的最新研究与应用,包括Meta的防火墙突破、分布式训练技术及其在AI生态中的战略意义。

研究人员利用提示注入漏洞绕过Meta的Llama防火墙防护

Llama惨遭抛弃!Meta内部改用Claude写代码

使用 llama.cpp 构建 AI 代理

This guide will walk you through the entire process of setting up and running a llama.cpp server on your local machine, building a local AI agent, and testing it with a variety of prompts.

本文介绍了如何在本地设置和运行 llama.cpp 服务器,构建并测试 AI 代理。教程包括安装、配置和编译 llama.cpp,集成 Langchain,以及创建支持网络搜索和 Python REPL 的 ReAct 代理。尽管设置过程复杂,但其高效性和灵活性使本地 AI 成为可能。

在 Amazon EKS 上使用 DeepSpeed 进行 Llama 2 分布式训练

本篇成功地在 Amazon EKS 上使用 DeepSpeed 框架训练 LLama2 大语言模型,方案结合 Kubeflow 进行任务编排,DeepSpeed 的 ZeRO 优化器有效降低了内存占用, 利用 EFA 网络加速节点间通信,实现高效 GPU 资源调度和低延迟数据传输,为企业级模型训练提供可扩展解决方案。

近年来,深度学习模型日益复杂,单机训练效率低下。分布式训练技术可将负载分散到多台机器上,常用框架包括DeepSpeed和Horovod。本文介绍如何在亚马逊云上使用DeepSpeed进行Llama 2的分布式训练,涵盖环境搭建、Docker镜像构建及训练代码准备,以实现高效模型训练。

Meta为何砸下百亿重金投资而非直接收购AI数据标注巨头Scale AI?揭秘扎克伯格剑指AI生态霸权,欲借华人天才少年之力挽救Llama开源模型困局的深层战略与考量。

啊啊啊啊啊啊!家人们!Meta竟然砸了超百亿美金投资Scale AI,AI圈直接炸开锅了!我真的要尖叫了!这操作简直绝了!不允许有人不知道这件事,赶紧跟我一起冲,搞清楚这背后到底有多牛!🔥🔥🔥 先说重点!Scale AI是啥?它是全球最大的AI数据标注公司,简单来说就是给AI“大脑”喂数据的“幕后大佬”!没有高质量的数据,AI再聪明也白搭!而Meta这次大手笔投资,直接把Scale...

Meta投资Scale AI超过100亿美元,旨在获取数据标注服务以提升AI模型能力。Scale AI是全球最大的数据显示公司,客户包括微软和OpenAI。由于其特殊地位,Meta选择投资而非收购,以避免FTC的起诉。

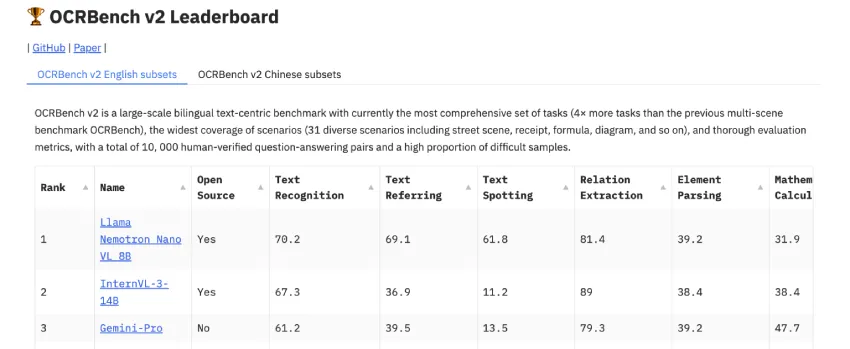

NVIDIA AI 发布 Llama Nemotron Nano VL:专为文档理解而优化的紧凑型视觉语言模型

Video-LLaMA:用于视频理解的指令调优音频-视觉语言模型

Video-LLaMAの論文 Architecture Vision-LLaMa is composed of two branches, the Vision-Language branch and the Audio-Language branch. Pre-training of the Vision-Language branch is conducted by...

Video-LLaMA架构包含视觉-语言和音频-语言两个分支。视觉-语言分支使用Webvid-2M数据集进行预训练,模型生成内容能力强,但指令遵循能力较弱,因此需要微调。第一阶段冻结视觉编码器,使用可训练的视频Q-Former处理帧输入。