💡

原文中文,约6000字,阅读约需15分钟。

📝

内容提要

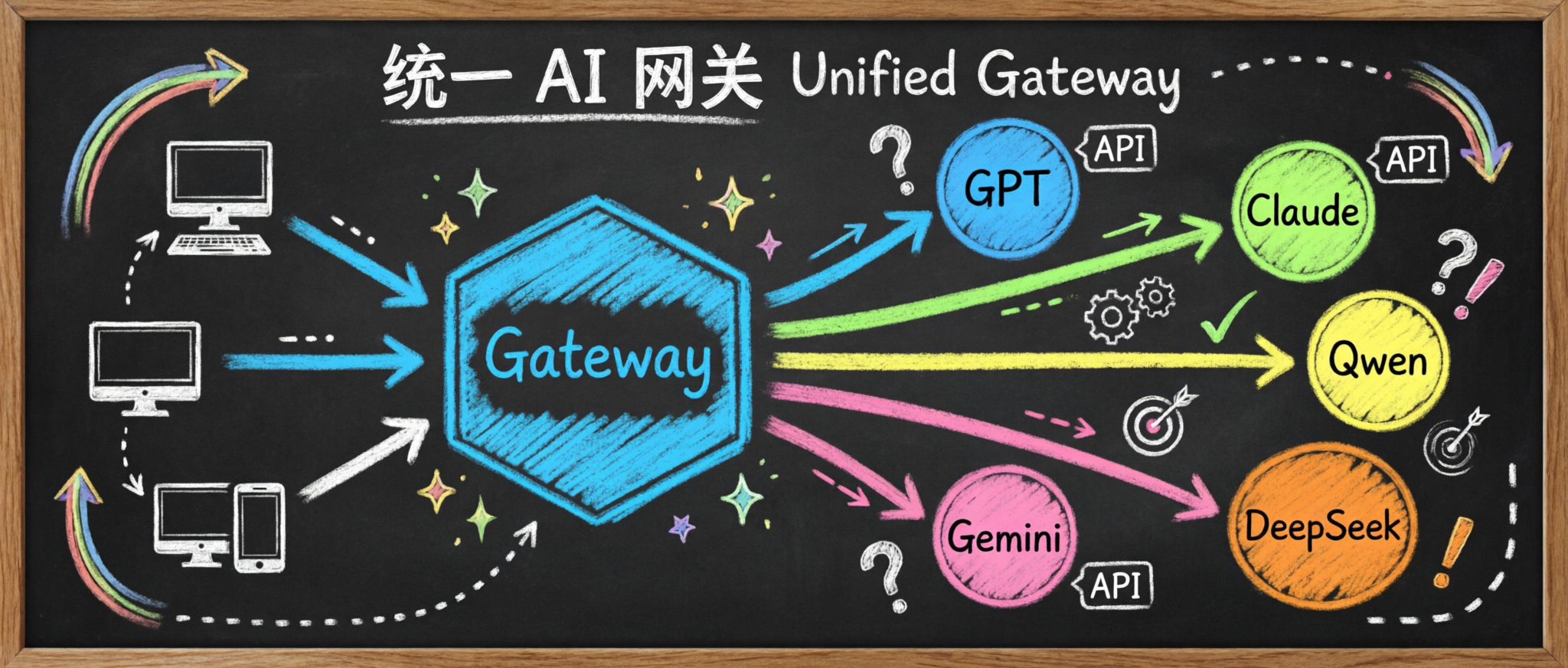

LiteLLM 是一个统一的 AI 网关,解决了多个 AI 模型 API 格式不一致和监控困难的问题。用户通过统一接口可轻松切换模型,并支持实时监控模型使用情况和成本,提供负载均衡和速率限制功能。本文介绍了在 Kubernetes 环境中部署 LiteLLM 的步骤,包括 PostgreSQL 数据库配置和模型请求示例。

🎯

关键要点

- LiteLLM 是一个统一的 AI 网关,解决了多个 AI 模型 API 格式不一致和监控困难的问题。

- 用户通过统一接口可轻松切换模型,只需修改 model 参数,无需改业务代码。

- LiteLLM 提供实时监控模型使用情况和成本的功能,支持负载均衡和速率限制。

- 在 Kubernetes 环境中部署 LiteLLM 需要配置 PostgreSQL 数据库。

- 部署步骤包括使用 LocalPathStorage 部署 PostgreSQL 和配置 LiteLLM 的相关文件。

- LiteLLM 提供 OpenAI API 格式的端点,支持自动路由到不同的后端模型。

- 用户可以通过 UI 界面实时查看不同模型的使用情况和成本统计。

❓

延伸问答

LiteLLM 的主要功能是什么?

LiteLLM 提供统一的 API 接口,支持多种 AI 模型的调用,实时监控使用情况和成本,并具备负载均衡和速率限制功能。

如何在 Kubernetes 环境中部署 LiteLLM?

在 Kubernetes 中部署 LiteLLM 需要配置 PostgreSQL 数据库,并按照步骤部署 LocalPathStorage 和 LiteLLM 的相关配置文件。

使用 LiteLLM 切换模型需要做哪些修改?

用户只需修改 model 参数,无需更改业务代码即可切换不同的 AI 模型。

LiteLLM 如何实现成本监控?

LiteLLM 提供实时监控功能,用户可以查看各模型的使用量和成本统计,帮助管理开支。

LiteLLM 支持哪些 AI 模型?

LiteLLM 支持多家模型的调用,包括 OpenAI、Azure、Anthropic 和 Google 等。

LiteLLM 的 UI 界面提供哪些功能?

LiteLLM 的 UI 界面允许用户实时查看不同模型的使用情况和成本统计,提供可视化监控。

🏷️

标签

➡️