💡

原文中文,约3700字,阅读约需9分钟。

📝

内容提要

本文介绍了如何在国产飞腾CPU上部署百度的文心大模型(ERNIE-4.5-0.3B),提供源码编译和预编译容器两种方法,适合不同用户需求。用户需准备飞腾CPU和银河麒麟系统,按照步骤安装依赖、编译模型,最后可通过命令行或图形界面与AI互动。

🎯

关键要点

- 本文介绍如何在国产飞腾CPU上部署百度的文心大模型(ERNIE-4.5-0.3B)。

- 用户需准备飞腾腾锐D3000 CPU、16G内存和银河麒麟V10桌面版 SP1 2503操作系统。

- 提供两种部署方法:源码编译和预编译容器,适合不同用户需求。

- 源码编译方法包括准备Linux环境、安装依赖、编译vLLM和启动服务。

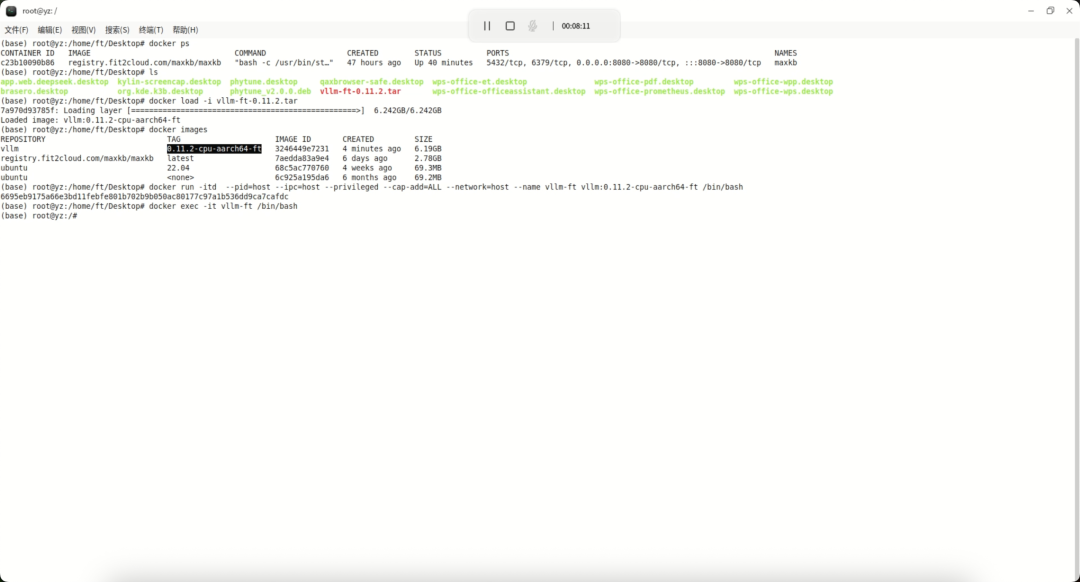

- 预编译容器方法适合不想敲代码的用户,只需导入镜像并启动容器。

- 模型部署后可以通过curl命令或MaxKB聊天界面与AI互动,测试其智能程度。

❓

延伸问答

如何在飞腾CPU上部署文心大模型?

可以通过源码编译或预编译容器两种方法进行部署,具体步骤包括准备环境、安装依赖和启动服务。

部署文心大模型需要哪些硬件和软件要求?

需要飞腾腾锐D3000 CPU、16G内存和银河麒麟V10桌面版 SP1 2503操作系统。

源码编译和预编译容器有什么区别?

源码编译适合喜欢折腾的用户,需要手动安装依赖;预编译容器适合不想敲代码的用户,只需导入镜像并启动。

如何通过命令行与部署的AI模型互动?

可以使用curl命令发送请求,例如询问食谱,命令格式为curl http://<IP>:8000/v1/completions -H 'Content-Type: application/json' -d '{...}'。

MaxKB是什么,它有什么用?

MaxKB是一个聊天界面工具,可以将部署的AI模型包装成用户友好的应用,方便与AI进行对话。

在部署过程中遇到问题该怎么办?

可以扫描文中二维码加入交流群,寻求帮助和解决方案。

➡️