💡

原文英文,约900词,阅读约需4分钟。

📝

内容提要

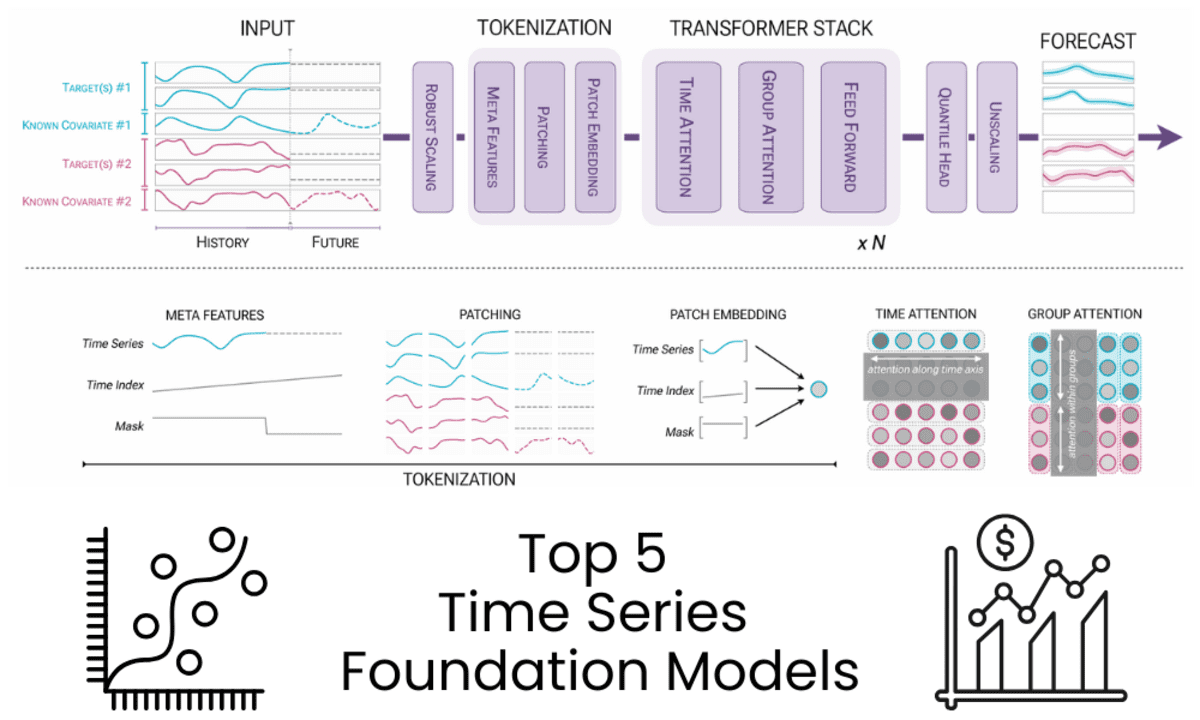

基础模型不仅限于ChatGPT,预训练模型在计算机视觉和自然语言处理领域已有应用。现在,这种方法正在重塑时间序列预测,通过在大规模时间数据上预训练,提供强大的零-shot预测能力。文章介绍了五种时间序列基础模型,包括Chronos-2、TiRex、TimesFM、IBM Granite TTM R2和Toto Open Base 1,强调它们在多变量预测中的优势和应用场景。

🎯

关键要点

- 基础模型不仅限于ChatGPT,预训练模型在计算机视觉和自然语言处理领域已有应用。

- 时间序列预测正在通过在大规模时间数据上预训练而重塑,提供强大的零-shot预测能力。

- 文章介绍了五种时间序列基础模型,包括Chronos-2、TiRex、TimesFM、IBM Granite TTM R2和Toto Open Base 1。

- Chronos-2是一个120M参数的编码器模型,支持单变量和多变量预测,提供准确的多步概率预测。

- TiRex是一个35M参数的预训练模型,基于xLSTM,适用于长短期零-shot预测。

- TimesFM是一个由Google Research开发的500M参数解码器模型,专注于单变量预测,支持长历史上下文。

- IBM Granite TTM R2是一个紧凑的预训练模型系列,适用于多变量预测,模型大小从1M开始。

- Toto Open Base 1是一个解码器模型,专为多变量预测而设计,优化高维稀疏数据的处理。

- 文章总结了这些模型的核心特征,包括模型大小、架构和预测能力。

➡️