💡

原文英文,约700词,阅读约需3分钟。

📝

内容提要

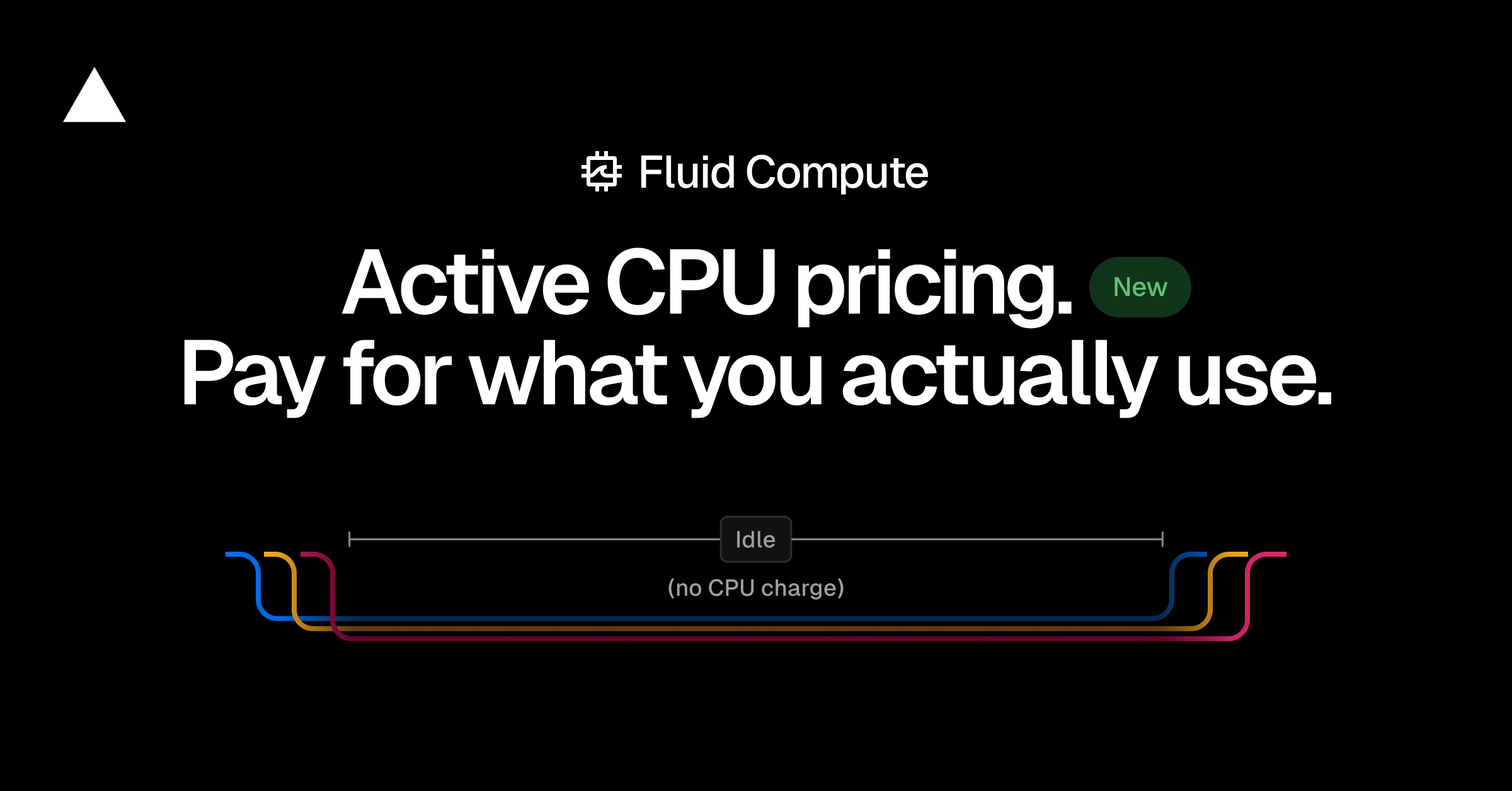

Fluid计算模型为I/O密集型任务提供高效解决方案,通过智能资源共享降低成本,采用按需计费的CPU模式,仅在实际使用时收费,优化云资源使用,减少浪费,提升性能。

🎯

关键要点

- Fluid计算模型为I/O密集型任务提供高效解决方案,适用于AI推理、代理、MCP服务器等需要即时扩展的工作负载。

- Fluid计算模型帮助团队通过优化实现高达85%的成本节省,成为Vercel的默认计算模型。

- 新的按需计费模式仅在代码实际使用CPU时收费,优化云资源使用,减少浪费。

- Fluid计算打破传统的无服务器模型,通过智能调度计算资源,消除冷启动和重复开销。

- Fluid计算在Vercel上支持超过一万亿次调用,团队通过智能共享计算实现高达90%的成本节省。

- 新的定价模型基于实际资源使用,Active CPU仅在代码实际执行时计费,内存和调用次数也纳入定价。

- Fluid计算平台支持标准运行时如Node.js、Python和Go,简化云基础设施,同时保持灵活性和性能。

- Active CPU定价模式默认启用,适用于所有Hobby、Pro和新Enterprise团队,帮助自动优化成本。

❓

延伸问答

Fluid计算模型的主要优势是什么?

Fluid计算模型为I/O密集型任务提供高效解决方案,帮助团队通过优化实现高达85%的成本节省。

什么是主动CPU定价模式?

主动CPU定价模式仅在代码实际使用CPU时收费,优化云资源使用,减少浪费。

Fluid计算如何提高性能和降低成本?

Fluid计算通过智能调度计算资源,消除冷启动和重复开销,实现高达90%的成本节省。

Fluid计算支持哪些编程语言?

Fluid计算平台支持标准运行时如Node.js、Python和Go。

Fluid计算如何处理资源的闲置时间?

Fluid计算智能地调度计算资源,允许多个并发请求共享相同的底层资源,从而消除闲置时间的浪费。

Fluid计算的定价模型是如何计算的?

Fluid计算的定价基于三个关键指标:主动CPU、配置内存和调用次数,反映实际资源使用情况。

➡️