💡

原文中文,约2600字,阅读约需6分钟。

📝

内容提要

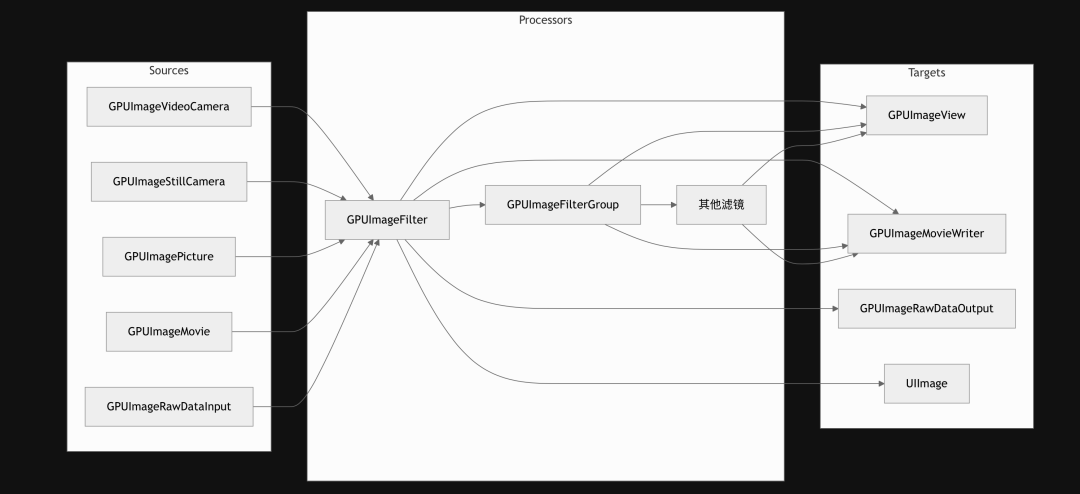

本文介绍了基于OpenGL ES 2.0的GPUImage音视频技术架构,核心角色包括生成、处理和输出。主要组件有Sources、Processing和Targets,支持实时视频处理和自定义滤镜,具备高性能、模块化和跨平台特性,适合音视频开发学习。

🎯

关键要点

- 本文介绍了基于OpenGL ES 2.0的GPUImage音视频技术架构。

- GPUImage架构将生成、处理和输出拆分为三大核心角色。

- Sources组件负责产生图像帧,包括摄像头、图片、视频等。

- Processing组件使用Shader对纹理进行像素级运算。

- Targets组件负责消费处理结果,如显示和保存。

- GPUImageContext管理OpenGL上下文和Framebuffer池。

- GPUImageOutput是所有Source的基类,负责注册和通知新帧。

- Sources类包括实时摄像头视频、拍照、静态图片和本地视频文件。

- Processing类功能包括管理片段着色器和多个滤镜的串联。

- Targets类功能包括将纹理画到屏幕和编码为视频文件。

- 处理管线包括帧生成、纹理上传和Shader处理。

- GPUImageFramebuffer封装纹理和FBO,GPUImageFramebufferCache复用FBO。

- 自定义滤镜只需继承GPUImageFilter并提供GLSL片段着色器。

- iOS和macOS在摄像头和视图集成上存在差异。

- GPUImage支持高性能的并行计算和异步处理。

- 模块化设计使得Source、Filter和Target可以自由组合。

- 理解架构后可轻松扩展GPUImage以满足不同需求。

❓

延伸问答

GPUImage的架构主要包括哪些核心角色?

GPUImage的架构主要包括Sources、Processing和Targets三个核心角色。

Sources组件的功能是什么?

Sources组件负责产生图像帧,包括摄像头、图片、视频等。

Processing组件如何处理图像数据?

Processing组件使用Shader对纹理进行像素级运算。

Targets组件的作用是什么?

Targets组件负责消费处理结果,如显示和保存。

如何自定义滤镜?

自定义滤镜只需继承GPUImageFilter并提供GLSL片段着色器。

GPUImage在iOS和macOS上有什么平台差异?

iOS使用GPUImageVideoCamera和GPUImageStillCamera,而macOS使用GPUImageAVCamera,视图集成也有所不同。

🏷️

标签

➡️