💡

原文中文,约2000字,阅读约需5分钟。

📝

内容提要

本文介绍了如何使用McCloudS/subgen项目实现本地AI视频字幕生成和翻译。作者扩展了“转录后翻译”功能,并结合Jellyfin自动生成双语字幕。通过GPU机器进行转录和翻译,优化了家庭局域网的媒体管理与播放,整体效果令人满意。

🎯

关键要点

- 使用McCloudS/subgen项目实现本地AI视频字幕生成和翻译。

- 扩展了“转录后翻译”功能,结合Jellyfin自动生成双语字幕。

- 在GPU机器上进行转录和翻译,优化家庭局域网的媒体管理与播放。

- 配置Jellyfin与Subgen的互通,确保媒体文件路径一致。

- 实现了“存储在NAS、计算在GPU机器”的分工。

- 不同模型的使用体验差异明显,medium模型效果一般,large-v3-turbo模型处理能力有限。

- GPU利用率不高,转录和翻译过程仍需CPU参与。

- 在线免费服务在字幕翻译和合并方面速度和质量更优。

❓

延伸问答

如何使用McCloudS/subgen项目生成视频字幕?

可以通过在本地部署McCloudS/subgen项目,结合Jellyfin实现视频的自动转录和字幕生成。

转录后翻译功能是如何扩展的?

在原项目基础上,通过增加转录后翻译能力,使用Hugging Face的翻译模型实现翻译功能。

在家庭局域网中如何优化媒体管理与播放?

通过将NAS与GPU机器的媒体文件路径保持一致,利用Jellyfin管理媒体,GPU机器负责转录和翻译。

不同模型在转录和翻译中的表现如何?

medium模型效果一般,large-v3-turbo模型处理能力有限,distil-large-v3仅支持英文,效果差异明显。

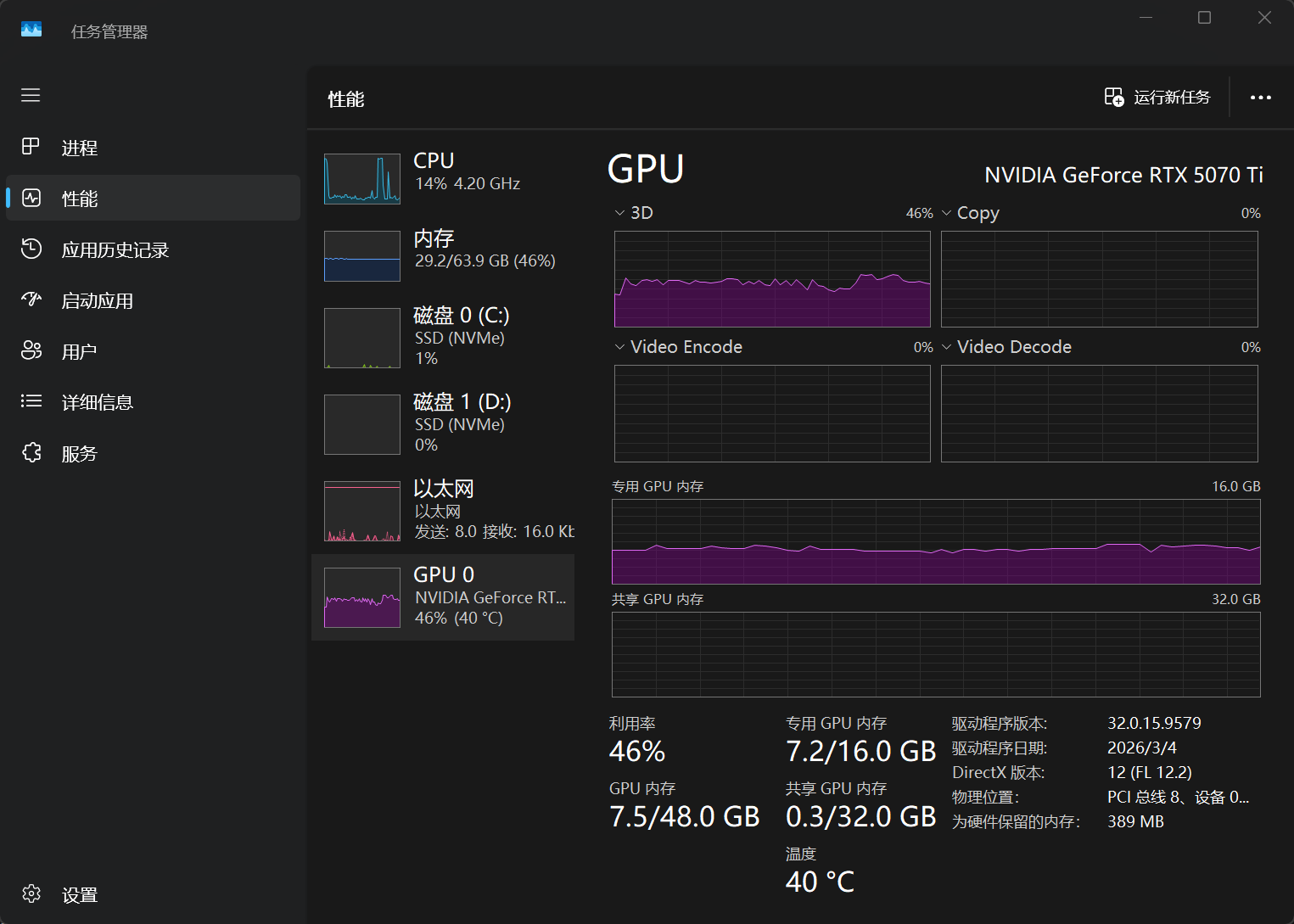

转录和翻译过程中GPU的利用率如何?

转录和翻译过程中GPU利用率不高,通常只有40%,且仍需CPU参与处理。

是否有更好的在线字幕翻译服务?

有很多在线免费服务在字幕翻译和合并方面速度和质量更优,偶尔使用这些服务更好。

➡️