💡

原文英文,约400词,阅读约需2分钟。

📝

内容提要

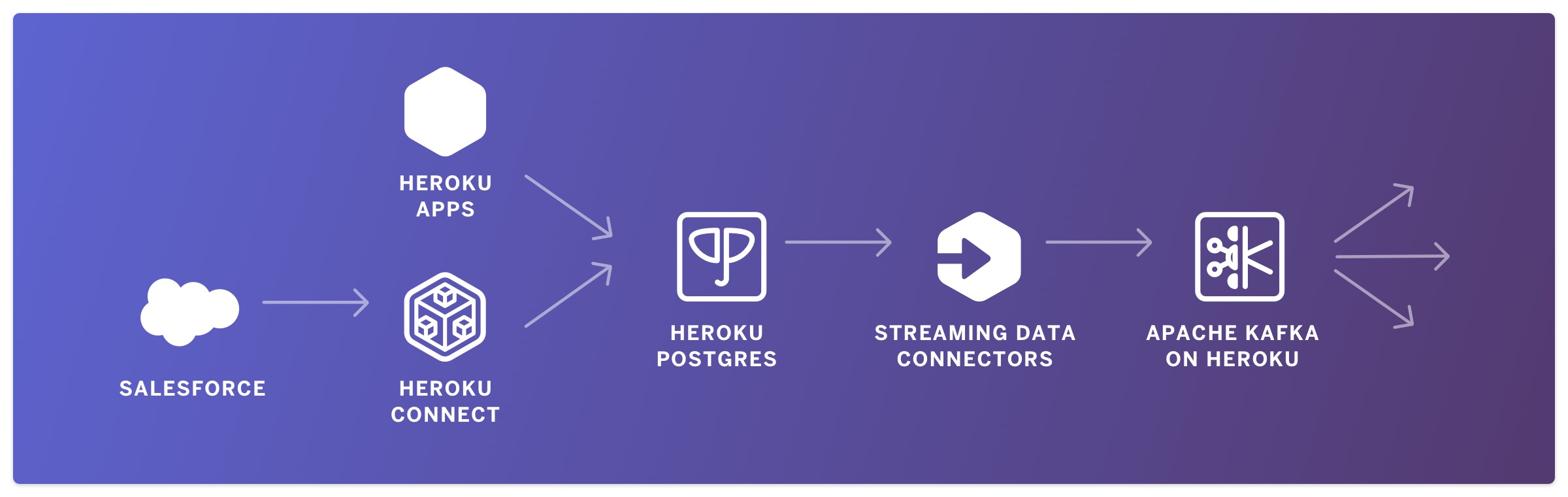

今夏,我们推出了Heroku Postgres与Apache Kafka之间的流数据连接器测试版,简化了变更数据捕获(CDC)的实现。拥有私人或Shield空间的用户可免费使用这些连接器,构建流数据管道,整合Salesforce与外部存储。同时,我们改进了产品,防止Postgres维护期间丢失事件,并更新了Debezium至最新版本。

🎯

关键要点

- 今夏推出了Heroku Postgres与Apache Kafka之间的流数据连接器测试版。

- 这些连接器简化了变更数据捕获(CDC)的实现,用户可免费使用。

- 用户可以构建流数据管道,整合Salesforce与外部存储,如Snowflake数据湖或AWS Kinesis队列。

- 连接器支持将单体应用重构为微服务,实施基于事件的架构,归档数据到低成本存储服务等。

- 用户可以从多个Salesforce和Work.com组织构建统一的事件流,提供基于Kafka的事件总线。

- 改进了产品以防止Postgres维护期间丢失事件,并在Postgres故障转移场景中最小化丢失事件。

- 新增了更新命令以便在初始配置后更改表或列,并将Debezium更新至最新版本1.3。

- 用户可以通过命令行轻松创建连接器,需确保使用最新的CLI插件。

- 欢迎反馈,期待客户利用流数据连接器进行数据驱动的开发。

❓

延伸问答

Heroku流数据连接器的主要功能是什么?

Heroku流数据连接器简化了变更数据捕获(CDC)的实现,允许用户在Heroku上构建流数据管道。

使用Heroku流数据连接器需要满足哪些条件?

用户需要拥有私人或Shield空间,并在该空间中安装Postgres和Apache Kafka附加组件。

如何创建Heroku流数据连接器?

用户可以通过命令行使用命令 'heroku data:connectors:create' 来创建连接器,需指定Postgres源和Kafka存储的名称。

Heroku流数据连接器支持哪些数据集成?

它支持将Salesforce与外部存储(如Snowflake数据湖或AWS Kinesis队列)进行集成。

流数据连接器如何帮助重构应用?

用户可以利用连接器将单体应用重构为微服务,并实施基于事件的架构。

在Postgres维护期间,流数据连接器如何防止事件丢失?

产品进行了改进,以防止在Postgres维护期间丢失事件,并在故障转移场景中最小化丢失事件。

➡️