💡

原文中文,约8800字,阅读约需21分钟。

📝

内容提要

AI 技术已渗透日常生活,包括智能助手和推荐系统。文章介绍了机器学习、深度学习和大模型等核心概念,帮助读者理解 AI 的基本逻辑和实际价值。

🎯

关键要点

- AI 技术已渗透日常生活,包括智能助手和推荐系统。

- AI 本质是让机器像人一样思考和工作,不再需要人逐条指挥。

- 机器学习、深度学习和强化学习是 AI 的核心方法论。

- 机器学习是基础学习法,深度学习是高级版,强化学习是训练技巧。

- 神经网络是深度学习的核心骨架,模仿人脑神经元的连接方式。

- 深度学习通过多层网络提取数据的深层规律,适合复杂任务。

- 预训练是给大模型打基础,用海量数据学习通用知识。

- 大模型(LLM)使用超大神经网络学习海量文字数据,具备强大语言理解和生成能力。

- 多模态大模型能同时处理多种信息类型,如文字、图片、语音等。

- Transformer 架构是现代大模型的基础,采用并行计算和自注意力机制。

- 位置编码帮助机器理解文字的先后顺序,解决语序混乱问题。

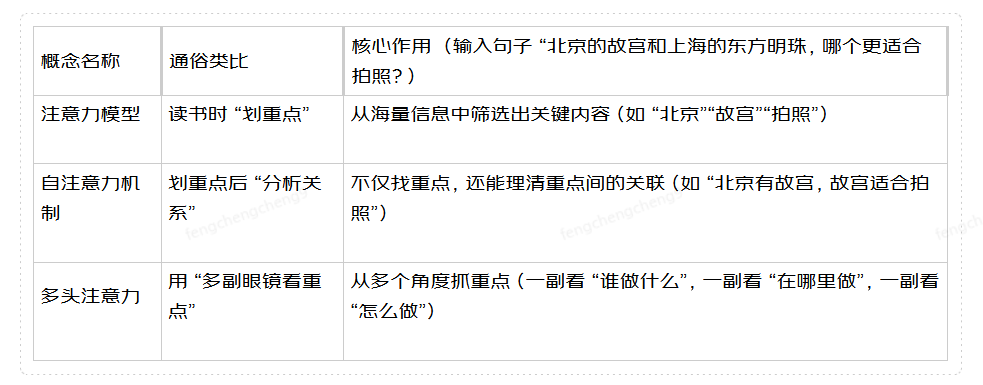

- 注意力机制让机器抓重点、理关系,是 Transformer 的核心能力。

- MOE 混合专家架构通过激活相关专家模块提高效率,节省算力。

- 数据并行、模型并行和张量并行是大模型的分工训练方式。

- 量化、知识蒸馏和剪枝是给模型瘦身的技术,适应普通设备。

- 微调是给预训练模型进行专项培训,适应具体任务。

- 领域自适应让大模型适配特定行业,提升专业能力。

- RLHF 通过人类反馈优化模型输出,符合人类偏好。

- RAG 和 KAG 解决大模型知识过时的问题,增强生成能力。

- 对齐和安全护栏确保模型输出符合人类价值观,避免有害内容。

- 主流大模型包括通用大模型和垂直领域大模型,适应不同任务。

- DeepSeek 的创新点在于高效、低成本和高适配性,推动大模型普及。

- 提示工程通过优化输入指令提高 AI 输出的准确性。

- 少样本和零样本提示是提示工程的进阶技巧,提升 AI 学习能力。

- 高频术语如 Token、标签、批次等是理解 AI 文档的关键词。

- AI 技术的核心逻辑是从数据找规律到落地实用的递进过程。

❓

延伸问答

什么是人工智能的本质?

人工智能的本质是让机器像人一样思考和工作,不再需要人逐条指挥。

机器学习、深度学习和强化学习有什么区别?

机器学习是基础学习法,深度学习是其高级版,强化学习则是通过奖励和惩罚进行训练的技巧。

什么是大语言模型(LLM)?

大语言模型是用超大神经网络学习海量文字数据,具备强大语言理解和生成能力的模型。

Transformer架构的核心创新是什么?

Transformer架构的核心创新是并行计算和自注意力机制,使得模型能高效捕捉数据间的关联关系。

如何通过微调提升预训练模型的能力?

微调是通过少量专项数据对预训练模型进行培训,使其适应具体任务。

什么是提示工程(Prompt Engineering)?

提示工程是通过优化输入指令来提高AI输出的准确性和符合预期的结果。

➡️