💡

原文中文,约3400字,阅读约需8分钟。

📝

内容提要

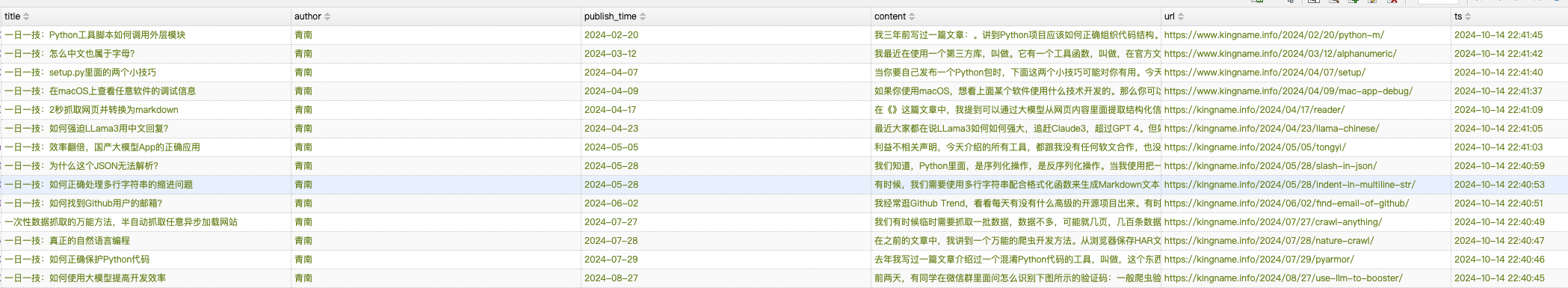

文章介绍了如何使用大模型实现全自动爬虫。通过输入起始URL,爬虫能自动抓取博客的标题、正文、作者和发布时间。使用httpx库,无需模拟浏览器。解析逻辑包括提取详情页URL和分页链接,利用GLM-4-Plus完成。未来计划引入模拟浏览器应对反爬虫和滚动加载问题。

🎯

关键要点

- 文章介绍了如何使用大模型实现全自动爬虫。

- 只需输入起始URL,爬虫能自动抓取博客的标题、正文、作者和发布时间。

- 使用httpx库,无需模拟浏览器。

- 爬虫自动抓取前三页所有博客文章,无需手动指定XPath。

- 代码分为多个模块,包括llm.py、utils.py、constants.py、parser.py和main.py。

- parser.py中包含字段解析与翻页的核心逻辑。

- 使用GLM-4-Plus大模型进行数据提取。

- 列表页直接提取URL,详情页生成XPath以节省输出Token。

- 爬虫流程通过while循环实现递归操作。

- 未来计划引入模拟浏览器以应对反爬虫和滚动加载问题。

🏷️

标签

➡️