💡

原文中文,约7400字,阅读约需18分钟。

📝

内容提要

人工智能技术迅速发展,带来安全风险。研究团队分析了Tensorflow的安全漏洞,发现模型可能被植入恶意操作,用户需提高警惕。Google已采取措施提升安全意识,建议在沙箱环境中运行不可信模型。

🎯

关键要点

- 人工智能技术迅速发展,带来安全风险。

- 研究团队分析了Tensorflow的安全漏洞,发现模型可能被植入恶意操作。

- 用户需提高警惕,Google已采取措施提升安全意识。

- 建议在沙箱环境中运行不可信模型。

- AI系统由算法模型、AI支撑系统和业务逻辑组成,存在多种潜在攻击面。

- Tensorflow是一个流行的机器学习框架,但其安全性未得到足够关注。

- 发现Tensorflow模型处理机制中的严重安全风险。

- 攻击者可以在Tensorflow模型中插入恶意操作而不被察觉。

- Tensorflow团队认为该问题是高危安全风险,用户需对执行不明模型的风险有认知。

- 发现多个传统安全漏洞,涉及Tensorflow的图片解析处理等功能。

- 推动Tensorflow建立漏洞处理流程,改善安全问题的上报和处理机制。

- Google建议用户将Tensorflow模型视作可执行程序,并在沙箱环境中执行不可信模型。

- AI安全将持续升级,基础设施软件安全需受到关注。

❓

延伸问答

Tensorflow存在哪些安全风险?

Tensorflow存在模型被植入恶意操作的风险,攻击者可以在模型中插入不被察觉的恶意代码。

用户如何提高对Tensorflow模型的安全意识?

用户应将Tensorflow模型视作可执行程序,并在沙箱环境中运行不可信模型。

Google对Tensorflow的安全问题采取了哪些措施?

Google已发布安全公告,建立漏洞处理流程,并建议用户提高安全意识。

Tensorflow模型的攻击面有哪些?

攻击面包括输入文件解析逻辑、模型处理逻辑和机器学习算法逻辑等。

Tensorflow模型中如何插入恶意操作?

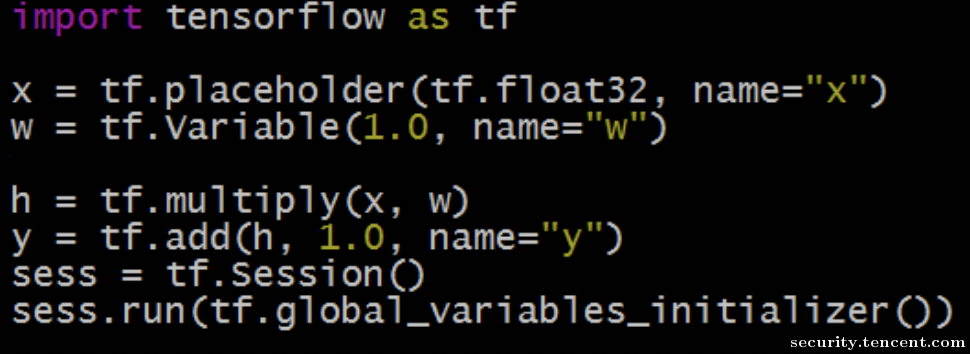

攻击者可以在数据流图中插入恶意操作,利用Tensorflow的API执行这些操作而不被察觉。

Tensorflow的安全漏洞是如何被发现的?

通过对Tensorflow的功能和架构进行详细分析,研究团队发现了多个安全漏洞。

➡️