ChatGPT的模型训练

原文中文,约10800字,阅读约需26分钟。发表于:。作为一个一直对AI技术很感兴趣的软件开发工程师,早在深度学习开始火起来的15、16年,我也开始了相关技术的学习。当时还组织了公司内部同样有兴趣的同学一起研究,最终的成果汇集成几次社区中的分享以及几篇学习文章(见这里)。 从去年OpenAI发布ChatGPT以来,AI的能力再次惊艳了世人。在这样的一个时间节点,重新去学习相关技术显得很有必要。 ChatGPT的内容很多,我计划采用一个系列,多篇...

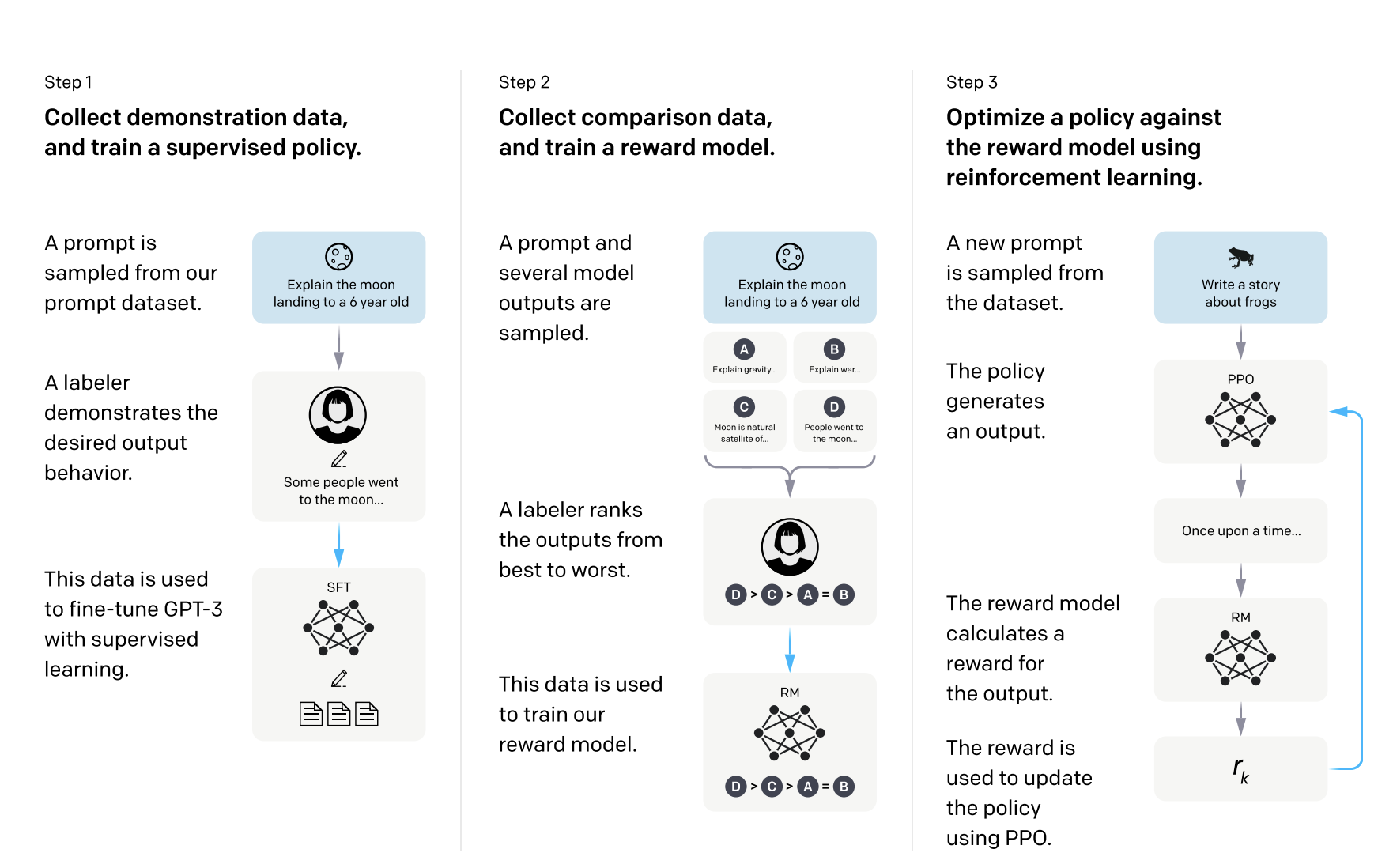

本文介绍了ChatGPT模型的训练过程,包括无监督预训练、监督微调和指令微调。还介绍了Alpaca、Vicuna和ColossalChat的训练过程和代码。训练代码包括定义模型结构、损失函数和准备训练数据。奖励模型和强化学习模型的训练将在下一篇文章中介绍。