💡

原文中文,约2300字,阅读约需6分钟。

📝

内容提要

文章探讨了深度学习的多个主题,包括dropout与cos的结合、Radam与adamW的区别、Xavier参数初始化的有效性,以及DEBERTA模型的改进。重点关注训练与预测阶段的一致性、学习率动态调整、参数初始化的几何视角,以及在NLP任务中对抗样本的处理。

🎯

关键要点

-

在孪生网络中,dropout层用于cos计算相似度时,训练和预测阶段的输出值不一致。

-

Radam通过动态调整学习率解决了adam算法的局部最优解问题,而adamW则结合了L2正则化。

-

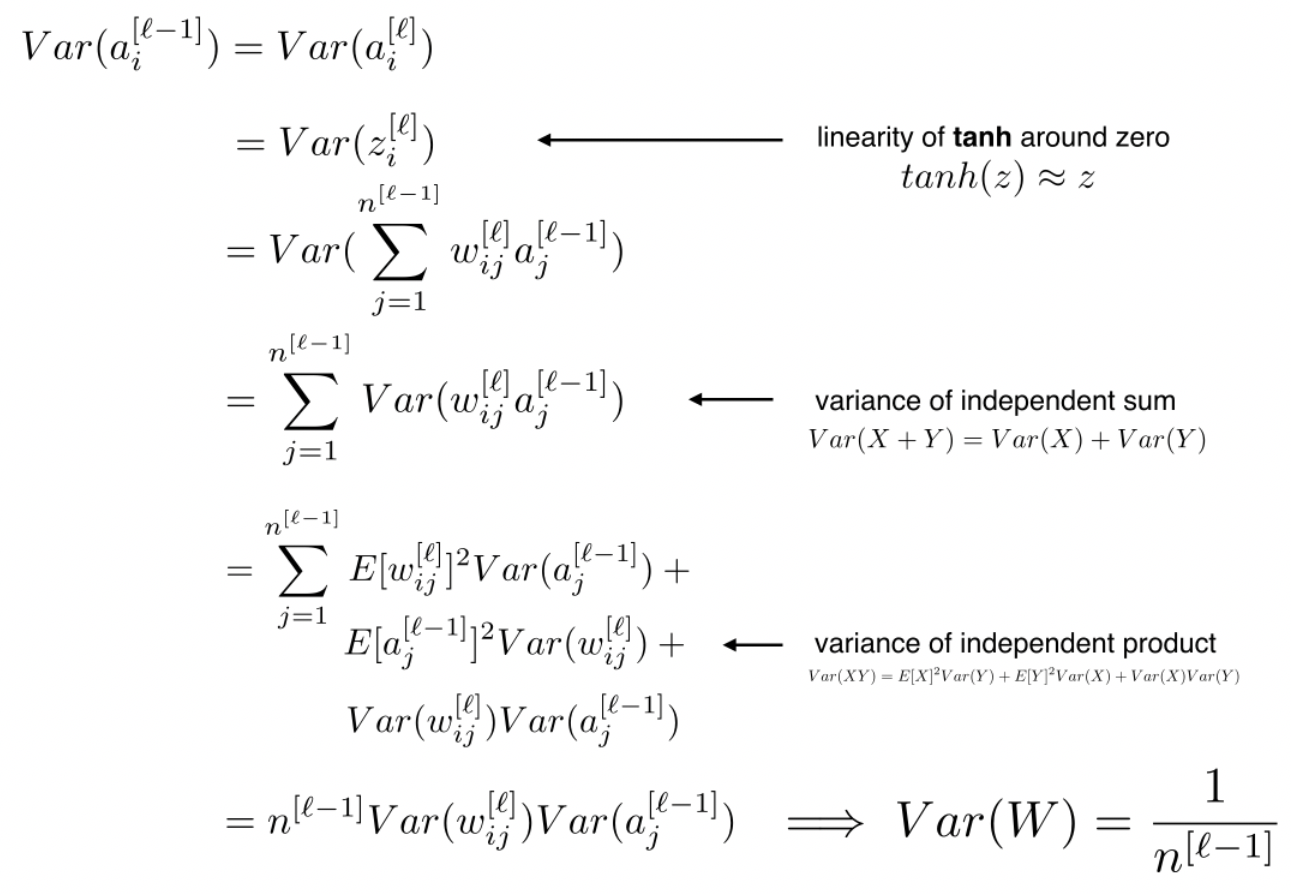

Xavier参数初始化确保神经网络输入层和输出层的方差一致,从而使梯度更加稳定。

-

从几何角度看,Xavier初始化策略保证了向量模长不变,证明了其有效性。

-

DEBERTA模型通过分开计算上下文关系和相对位置关系来增强自注意力机制,并在embedding层进行Layer Normalization后加入干扰以提升模型效果。

❓

延伸问答

dropout在孪生网络中的作用是什么?

dropout在孪生网络中用于计算cos相似度,但在训练和预测阶段的输出值不一致,预测阶段的输出值会更大。

Radam和adamW有什么区别?

Radam通过动态调整学习率解决局部最优解问题,而adamW则结合了L2正则化。

Xavier参数初始化的主要优点是什么?

Xavier参数初始化确保神经网络输入层和输出层的方差一致,从而使梯度更加稳定。

DEBERTA模型是如何增强自注意力机制的?

DEBERTA模型通过分开计算上下文关系和相对位置关系来增强自注意力机制,并在embedding层进行Layer Normalization后加入干扰。

Xavier初始化的几何视角是什么?

从几何角度看,Xavier初始化保证了向量模长不变,证明了其有效性。

在NLP任务中如何处理对抗样本?

在NLP任务中,通过微调embedding层而不是输入样本来处理对抗样本干扰。

➡️