💡

原文中文,约400字,阅读约需1分钟。

📝

内容提要

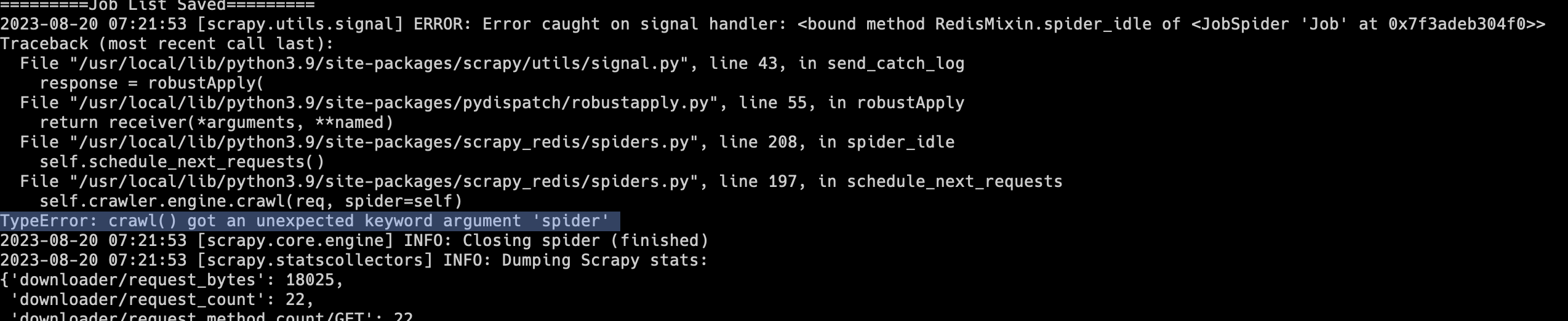

有同学在写爬虫时使用Scrapy + scrapy_redis实现分布式爬虫,但scrapy_redis更新较少,无法跟上Scrapy的更新。安装最新版Scrapy和scrapy_redis后会出现报错,解决方法是不安装最新版Scrapy,使用指定版本安装。

🎯

关键要点

- 许多同学使用Scrapy + scrapy_redis实现分布式爬虫。

- scrapy_redis更新较少,无法跟上Scrapy的更新。

- 安装Scrapy时,如果不指定版本,会默认安装最新版。

- 安装最新版Scrapy和scrapy_redis后可能会出现报错。

- 解决方法是不要安装Scrapy最新版,指定版本进行安装。

➡️