💡

原文中文,约2700字,阅读约需7分钟。

📝

内容提要

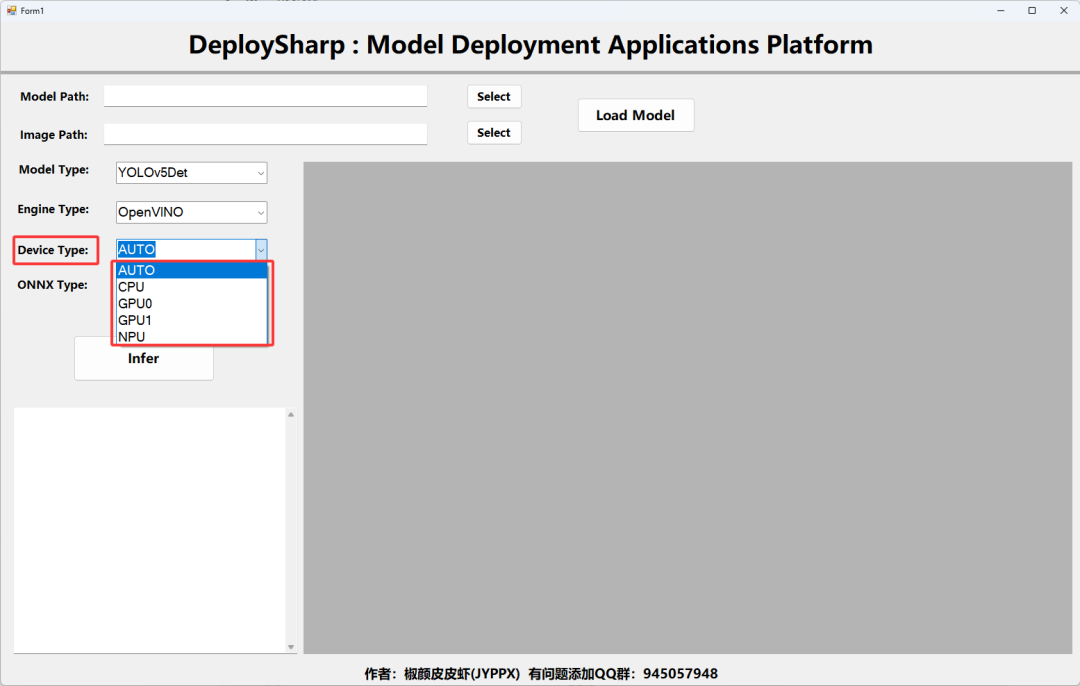

基于DeploySharp的深度学习模型部署测试平台,支持YOLO系列模型及多种推理引擎(如OpenVINO、ONNX Runtime),用户可选择不同设备进行推理,并提供详细的安装与使用教程,便于开发者快速上手。

🎯

关键要点

- 基于DeploySharp开发的深度学习模型部署测试平台支持YOLO系列模型,包括YOLOv5~v13。

- 平台支持多种推理引擎,如OpenVINO和ONNX Runtime,支持CPU、IGPU和GPU设备推理。

- 用户可以通过QQ技术交流群或GitHub下载平台,提供详细的安装与使用教程。

- 支持的模型路径和模型类型需保持一致,以避免程序运行错误。

- ONNX Runtime推理支持多种加速方式,用户需自行构建代码。

- 用户可选择不同的推理设备,包括AUTO、CPU、GPU0、GPU1和NPU。

- 提供了OpenVINO和ONNX Runtime的推理示例,包含不同框架的使用注意事项。

- 在使用ONNX Runtime推理时,默认只能使用CPU推理,需安装额外依赖库以实现加速。

- 开发者在使用过程中如有问题可联系作者,提供支持与帮助。

❓

延伸问答

DeploySharp支持哪些深度学习模型?

DeploySharp支持YOLO系列模型,包括YOLOv5到YOLOv13。

如何下载和安装基于DeploySharp的深度学习模型部署平台?

用户可以通过QQ技术交流群或GitHub下载,使用git clone命令获取项目。

DeploySharp平台支持哪些推理引擎?

平台支持OpenVINO和ONNX Runtime推理引擎。

在使用ONNX Runtime时需要注意什么?

默认情况下,ONNX Runtime只能使用CPU推理,需安装额外依赖库以实现加速。

用户可以选择哪些推理设备进行模型推理?

用户可以选择AUTO、CPU、GPU0、GPU1和NPU等推理设备。

如果在使用中遇到问题,用户该如何处理?

开发者可以联系作者以获得支持与帮助。

➡️