💡

原文中文,约15500字,阅读约需37分钟。

📝

内容提要

AgentEval是José Luis Latorre Millas开发的.NET工具包,专注于AI智能体评估,填补了.NET生态中评估工具的空白。它采用C#语言,支持多代理协作评估,强调开发者体验,简化AI评估过程。通过引入“任务效用”概念,AgentEval实现了多维度评估,提高了评估的准确性和适应性。

🎯

关键要点

- AgentEval是由José Luis Latorre Millas开发的.NET工具包,专注于AI智能体评估。

- 该框架是.NET生态中首个原生AI智能体评估工具包,填补了Python主导的评估工具空白。

- AgentEval采用C#语言,强调开发者体验,简化AI评估过程。

- 引入“任务效用”概念,实现多维度评估,提高评估的准确性和适应性。

- AgentEval的设计目标是为.NET开发者提供与Python工具相似的评估能力。

- 框架支持多代理协作评估,动态生成针对特定任务的评估标准。

- AgentEval与Microsoft Agent Framework和Microsoft.Extensions.AI深度集成,提供一等公民支持。

- 设计哲学优先考虑开发者体验,降低AI评估的认知门槛与工程成本。

- AgentEval支持企业级部署,具备异步执行、可观测性和安全合规特性。

- 引入多维评估,超越单一指标,形成对智能体能力的立体画像。

- 核心架构采用多代理协作评估范式,提升评估能力的动态性和自适应性。

- CriticAgent负责自动生成评估标准,QuantifierAgent负责将标准转化为定量评分。

- VerifierAgent实现评估过程的元级验证,确保评估标准的有效性和评分的可靠性。

- AgentEval的评估流程分为标准生成和标准量化两个阶段,形成清晰的责任边界。

- 工具调用验证模块系统化评估智能体的工具调用能力,确保调用的正确性和性能。

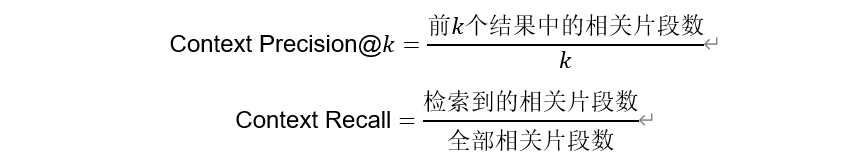

- AgentEval提供RAG质量指标体系,专门优化评估RAG管道的性能。

- 支持随机评估机制,系统化应对LLM的随机性,确保评估结果的可靠性。

- AgentEval的模型比较模块支持多模型评估和成本-质量分析,帮助企业做出决策。

- 与Microsoft技术栈的深度集成使得AgentEval能够在统一的技术栈中完成智能体的开发、评估和部署。

❓

延伸问答

AgentEval的主要功能是什么?

AgentEval是一个专注于AI智能体评估的.NET工具包,支持多代理协作评估,简化评估过程并提高准确性。

AgentEval如何提高评估的准确性和适应性?

通过引入“任务效用”概念和多维度评估,AgentEval能够动态生成评估标准,从而提高评估的准确性和适应性。

AgentEval与Python评估工具相比有什么优势?

AgentEval是.NET生态中首个原生AI评估工具,消除了对Python运行时的依赖,降低了技术复杂度和集成成本。

AgentEval的设计哲学是什么?

AgentEval的设计哲学优先考虑开发者体验,旨在降低AI评估的认知门槛与工程成本。

AgentEval如何支持企业级部署?

AgentEval支持异步执行、可观测性和安全合规特性,满足企业级部署的需求。

AgentEval的评估流程是怎样的?

AgentEval的评估流程分为标准生成和标准量化两个阶段,形成清晰的责任边界。

➡️