💡

原文中文,约1600字,阅读约需4分钟。

📝

内容提要

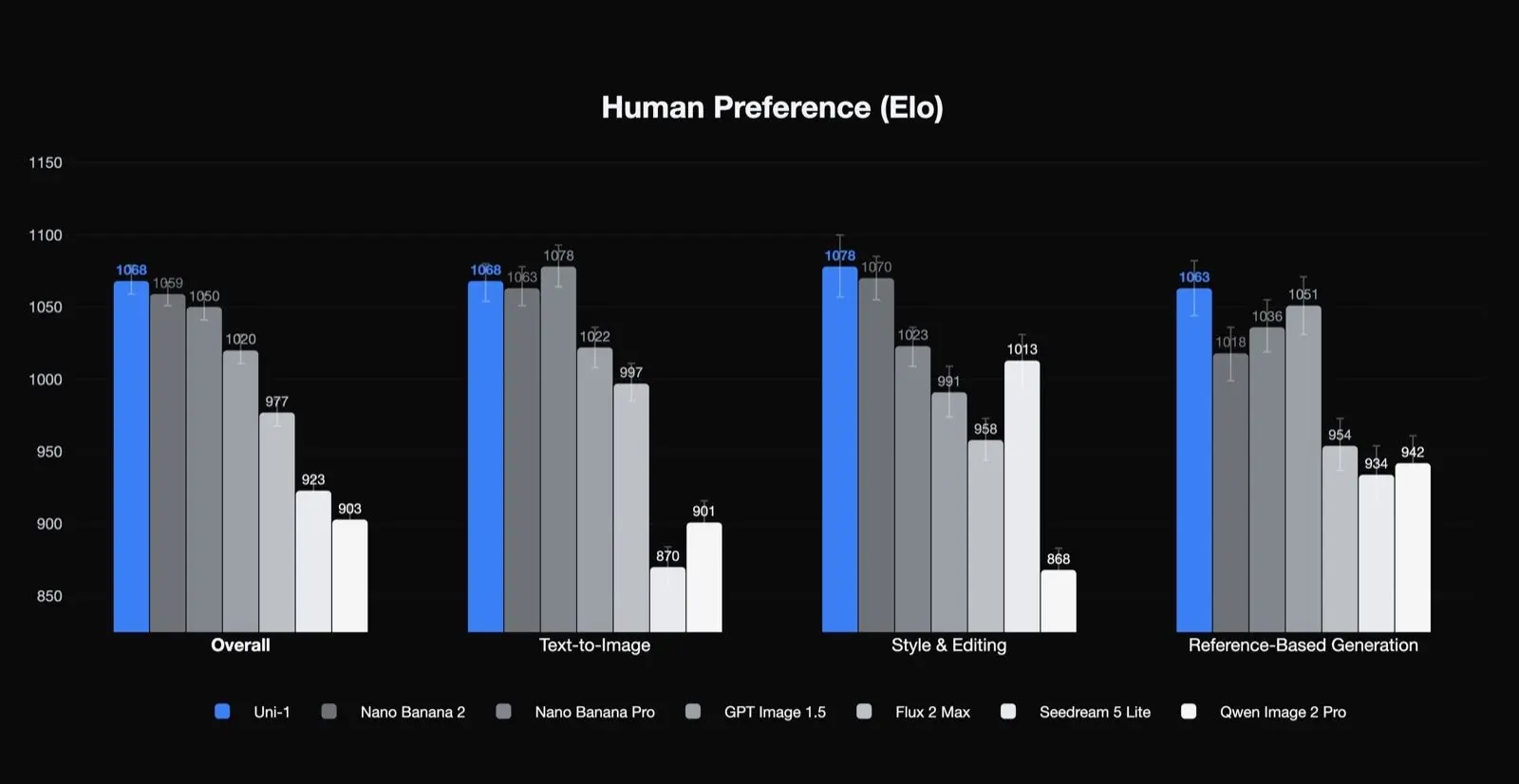

Luma Labs推出的Uni-1是一种自回归Transformer架构的图像模型,能够在生成前进行推理,提升文本与图像的理解与生成能力。该模型在RISEBench和ODinW-13基准测试中表现优异,展现出在视觉认知和空间逻辑处理方面的优势。Uni-1支持简单英语指令,定价约为每张0.10美元,未来将推出API接口。

🎯

关键要点

-

Luma Labs推出的Uni-1是一种自回归Transformer架构的图像模型,能够在生成前进行推理。

-

Uni-1旨在解决标准扩散流程中的“意图鸿沟”,将工作流程从“提示工程”转变为“指令执行”。

-

该模型采用仅解码器的自回归Transformer架构,使文本和图像视为交错的标记序列。

-

Uni-1在同一次前向传递中同时执行理解和生成操作,具有更高的上下文感知能力。

-

在RISEBench和ODinW-13基准测试中,Uni-1表现优异,领先于Flux Max和Gemini。

-

Uni-1能够通过简单的英语指令进行推理,用户体验设计旨在减少对即时工程的需求。

-

该模型的定价约为每张0.10美元,未来将推出API接口,方便开发者集成其功能。

🏷️

标签

➡️