💡

原文中文,约10900字,阅读约需26分钟。

📝

内容提要

新年寄语指出,过去一年GenAI技术迅速发展,强调在开发中需解决长任务与无状态Web服务的矛盾。通过引入“后台模式”和状态持久化机制,利用ContinuationToken将长任务拆分为短请求,以确保任务可恢复执行。这种方法适合处理长时间运行的AI任务,值得开发者深入理解和应用。

🎯

关键要点

- 新年寄语强调GenAI技术的快速发展和开发中的挑战。

- 开发者需解决长任务与无状态Web服务的矛盾。

- 引入后台模式和状态持久化机制,利用ContinuationToken将长任务拆分为短请求。

- 这种方法适合处理长时间运行的AI任务,值得深入理解和应用。

- 无状态Web服务在长任务AI中面临上下文丢失的问题。

- Agent Framework提供了便捷的处理方式,允许Agent在后台运行。

- 通过轮询和存盘机制,将长任务拆解为可恢复的执行过程。

- 状态持久化机制确保任务在中断后可以继续执行。

- Responses API支持对话管理和长时间运行的Agent过程,推荐用于构建现代AI应用。

- 解决长时间运行AI任务的关键在于将执行拆开,而非拉长请求。

❓

延伸问答

如何解决长任务与无状态Web服务的矛盾?

通过引入后台模式和状态持久化机制,利用ContinuationToken将长任务拆分为短请求,以确保任务可恢复执行。

什么是ContinuationToken,它的作用是什么?

ContinuationToken是用于将长任务拆分为短请求的标识符,确保任务在中断后可以继续执行。

Agent Framework如何支持后台运行?

Agent Framework通过设置AllowBackgroundResponses为true,允许Agent在后台持续运行,处理长时间的AI任务。

在处理长时间运行的AI任务时,如何实现状态持久化?

通过PersistAgentState和RestoreAgentState机制,将当前线程状态和令牌存储,以便在任务中断后恢复执行。

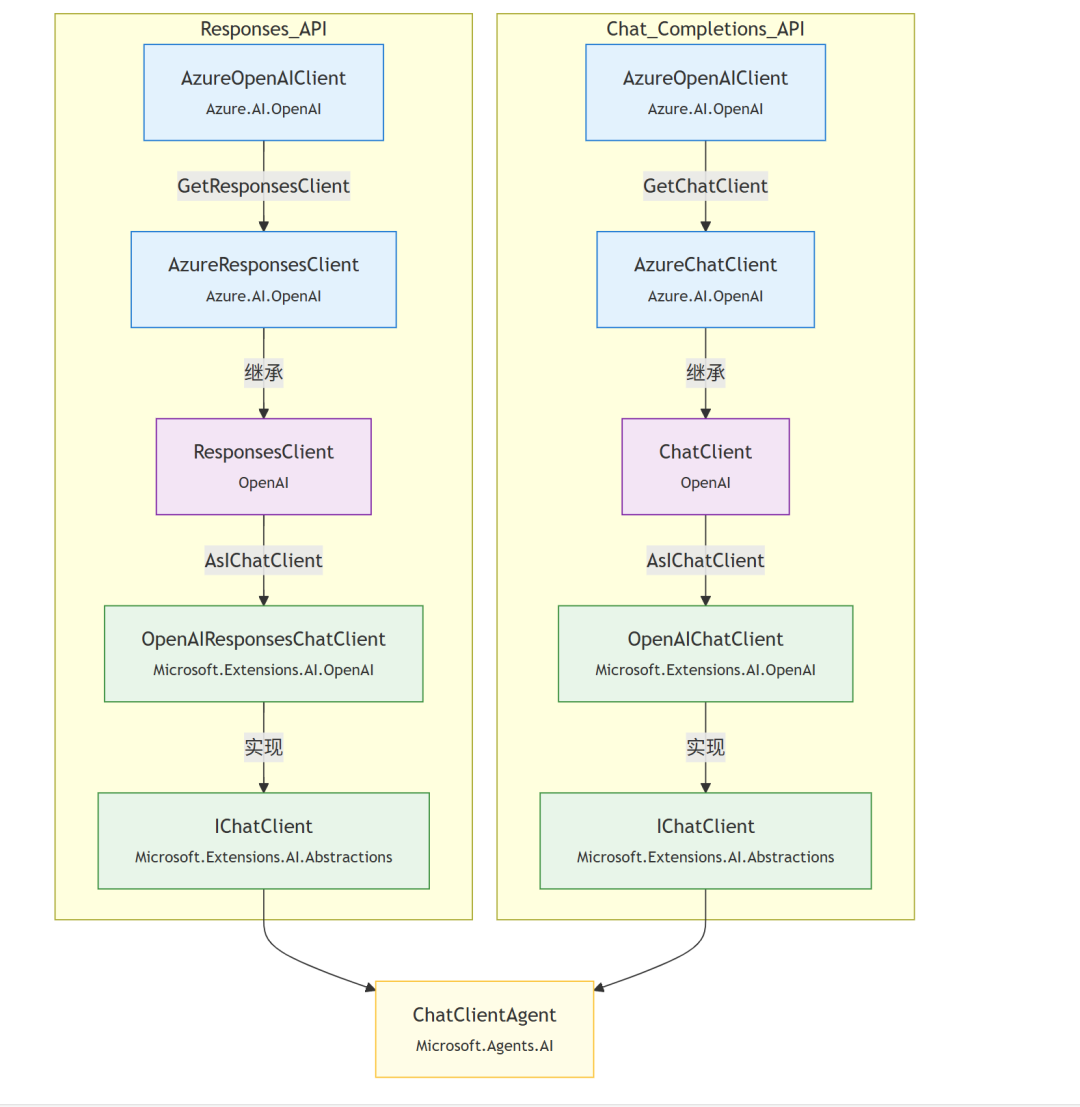

Responses API与Chat Completions API有什么区别?

Responses API支持对话管理和长时间运行的Agent过程,而Chat Completions API则是无状态的请求/响应格式,适用于简单交互。

为什么传统的HTTP请求模型在长任务中失效?

因为传统的HTTP请求模型是无状态的,无法保持长时间运行任务的上下文,导致超时和断连问题。

➡️