2026年值得关注的图神经网络五大突破

KDnuggets

·

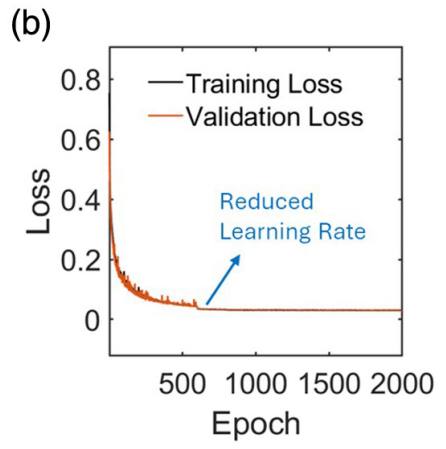

神经网络的工作原理 – 通过直线方程 y = ax + b 进行解释

freeCodeCamp.org

·

指导学习使“不可训练”的神经网络实现其潜力

MIT News - Computer Science and Artificial Intelligence Laboratory (CSAIL)

·

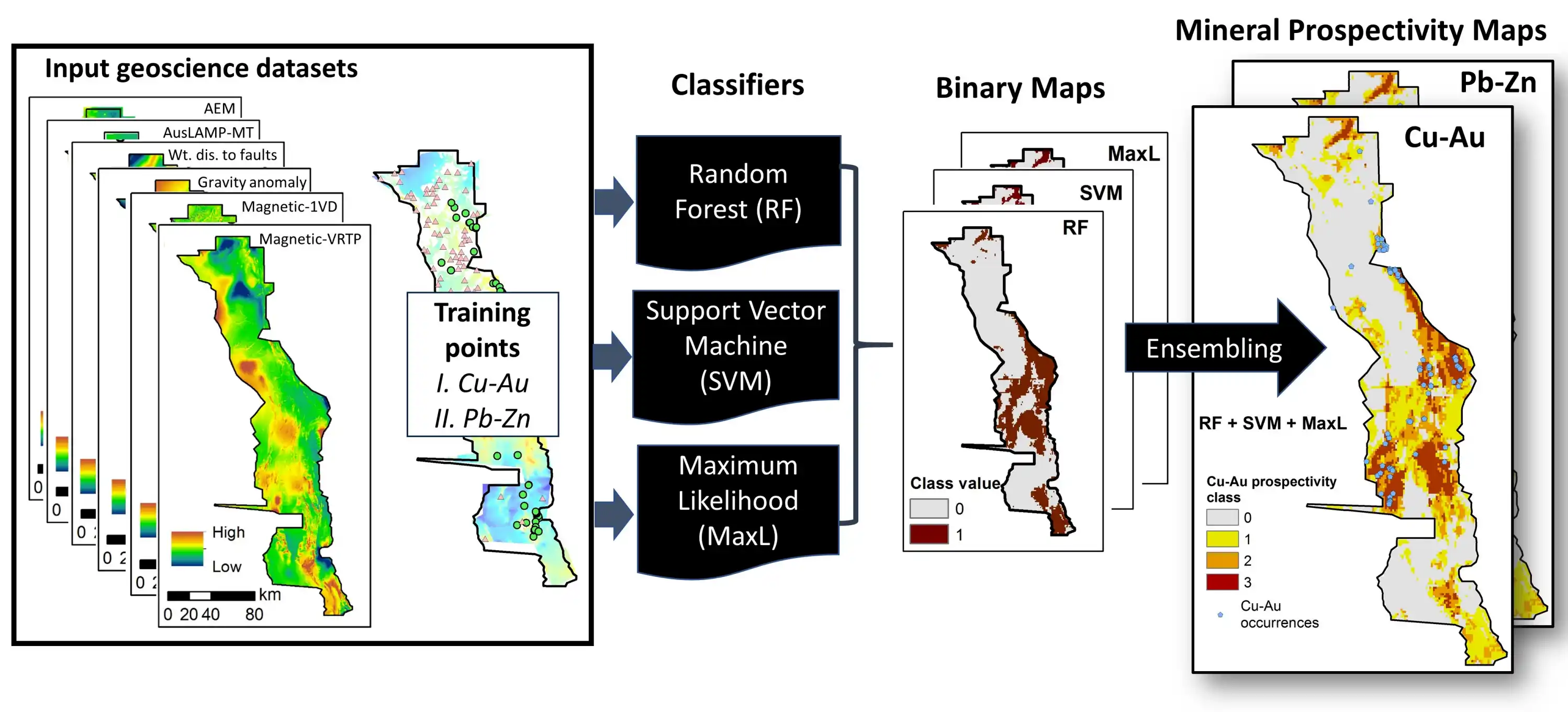

大数据成矿预测系列(五) | 告别特征工程:卷积神经网络(CNN)如何实现“端到端”成矿预测

Seraphineの小窝

·

AI 论文周报丨递归推理方法/轻量级解码器架构/深度卷积神经网络架构……多领域前沿动态一览

HyperAI超神经

·

香港科技大学提出融合神经网络框架,高效预测蛋白质序列的多金属结合位点

HyperAI超神经

·

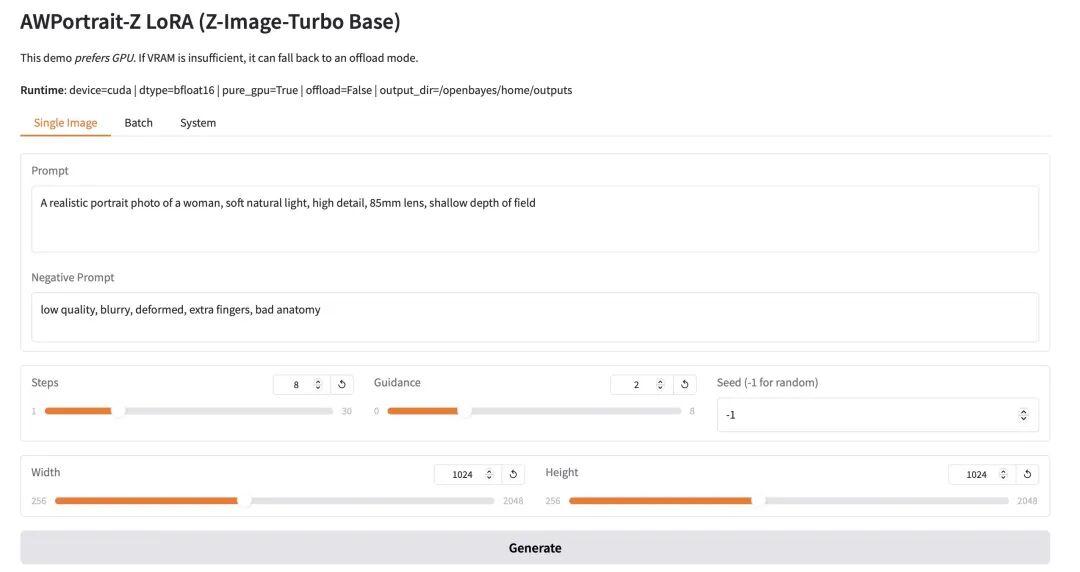

如何利用神经网络增强图像

freeCodeCamp.org

·

![[实验性] 有开发者破解苹果ANE神经网络引擎 原来M4芯片也能直接训练小模型](https://img.lancdn.com/landian/2026/03/111996.png)