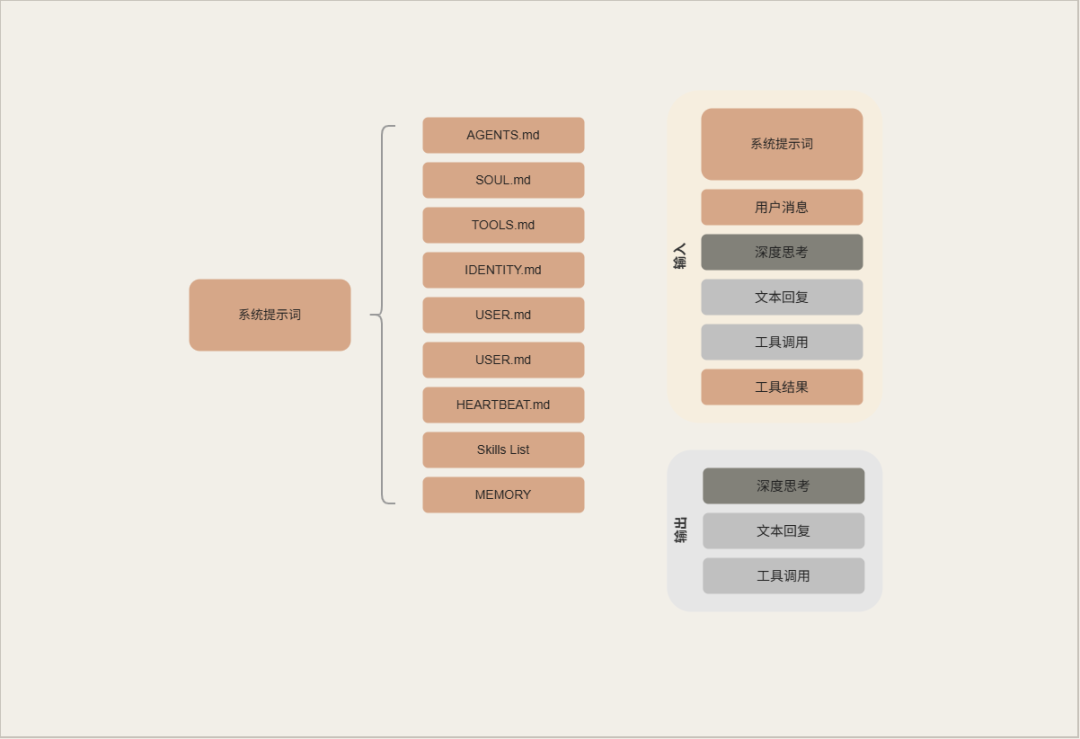

使用 Claude Code:会话管理与 100 万 上下文

宝玉的分享

·

为什么 AI 不能有无限记忆?到底什么是上下文窗口限制?

dotNET跨平台

·

Modular:零日发布:Gemma 4在NVIDIA和AMD上的最快性能

Modular Blog

·

Anthropic对Claude的最长提示进行了重要的定价调整

The New Stack

·

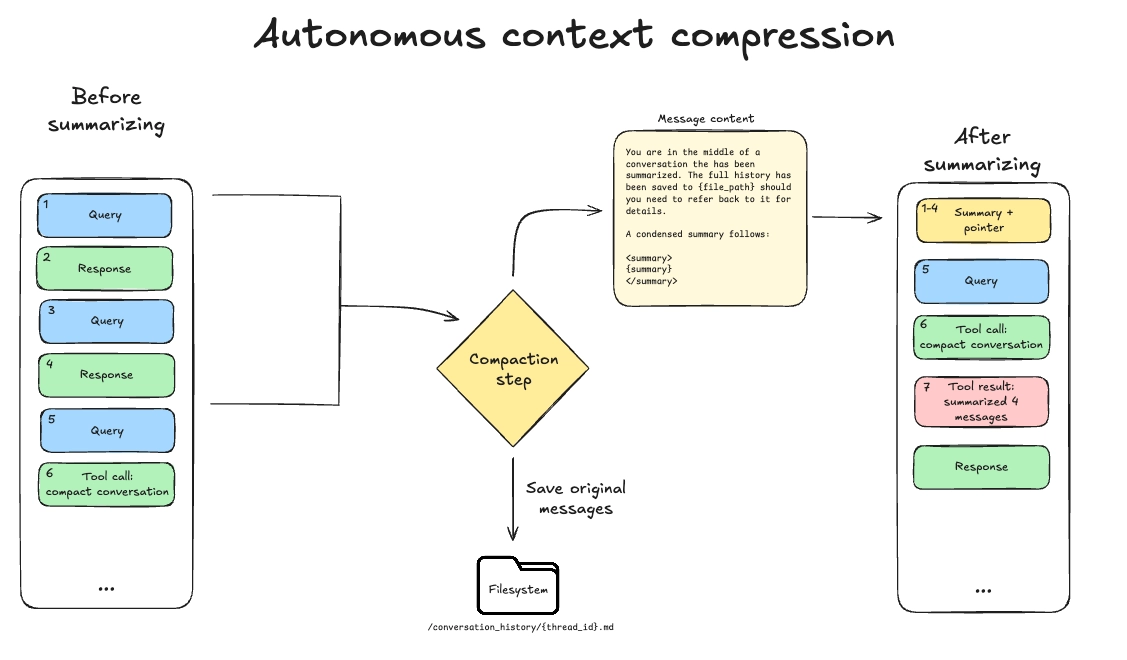

自主上下文压缩

LangChain Blog

·

Claude Sonnet 4.6已在AI Gateway上线

Vercel News

·

LLM应用的上下文窗口管理:速度与成本优化

Redis Blog

·

Qwen 3.5 Plus已上线AI Gateway

Vercel News

·

在AI Gateway上使用Claude Opus 4.6

Vercel News

·

Spring AI代理模式(第4部分):子代理编排

Spring

·

LLM上下文窗口:理解与优化工作记忆

Redis Blog

·

![[更新] Codex使用GPT-5.4支持1M上下文 超过272K将按照2X计算倍率](https://img.lancdn.com/landian/2026/02/111836.png)