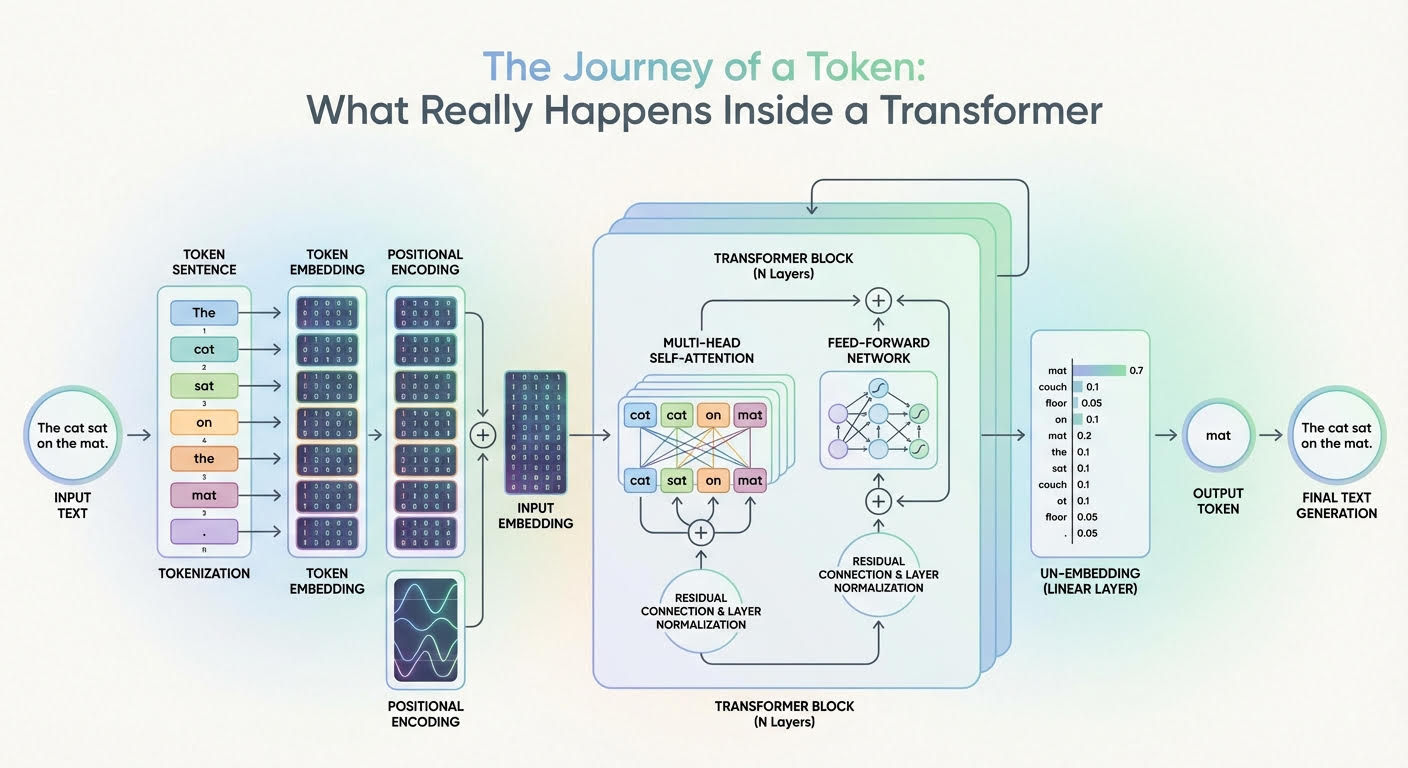

标记的旅程:变换器内部究竟发生了什么

MachineLearningMastery.com

·

使用PyTorch从零开始构建变换器模型(10天迷你课程)

MachineLearningMastery.com

·

使用变换器进行实时手势识别

freeCodeCamp.org

·

构建类似于Llama-2和Llama-3的仅解码器变换器模型

MachineLearningMastery.com

·

变换器模型中的跳跃连接

MachineLearningMastery.com

·

变换器模型中的混合专家架构

MachineLearningMastery.com

·

变换器模型中的线性层和激活函数

MachineLearningMastery.com

·

变换器模型中的LayerNorm和RMS Norm

MachineLearningMastery.com

·

变换器模型中的位置编码

MachineLearningMastery.com

·

变换器模型中的编码器和解码器

MachineLearningMastery.com

·

4o图像生成 - 扩散/变换器交叉趋势?

DEV Community

·

高效流式音视频主动说话者检测系统

Apple Machine Learning Research

·