大型语言模型是否有英语口音?评估和改善多语言大型语言模型的自然性

Apple Machine Learning Research

·

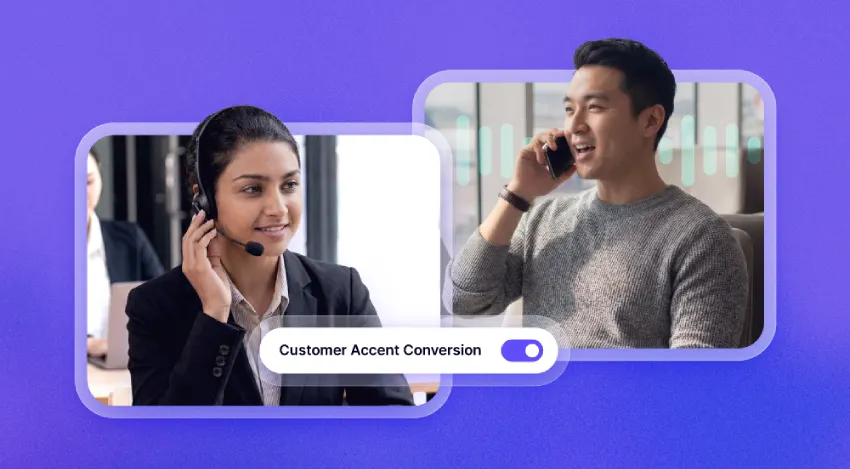

这家公司正在利用AI帮助人们获得美式口音

The Verge

·

拥抱你的声音

DEV Community

·

Pi 你的个人聊天 AI。不,你的私人英语听力老师

小众软件

·

/cdn.vox-cdn.com/uploads/chorus_asset/file/25462046/STK155_OPEN_AI_CVirginia_2_C.jpg)