大语言模型推理三难问题:吞吐量、延迟与成本

The DigitalOcean Blog

·

优化吞吐量的Redis用于L2 KV缓存重用

Redis Blog

·

Postgres性能:为何峰值吞吐量基准测试忽视了真正的问题

Timescale Blog

·

.png)

优化用于推理的DigitalOcean Gradient™ AI GPU Droplets:在降低成本的同时提高吞吐量

The DigitalOcean Blog

·

GB300上的DeepSeek-V3.2:性能突破

vLLM Blog

·

Workflow 4.1 Beta:事件源架构

Vercel News

·

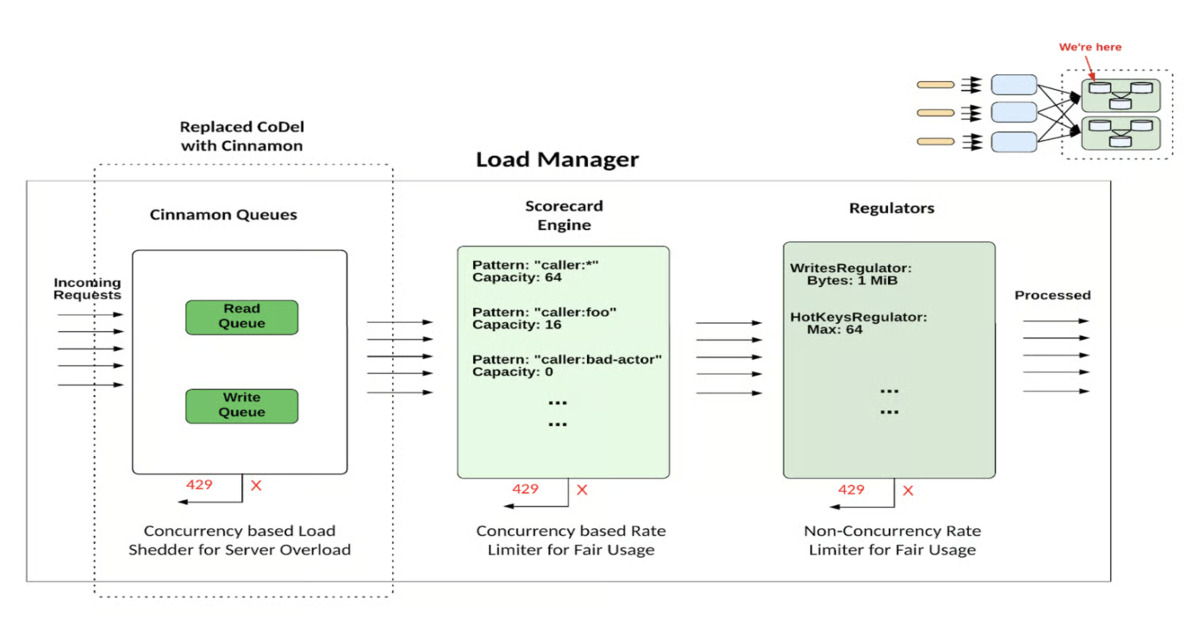

Uber从静态限制转向优先级感知的分布式存储负载控制

InfoQ

·

.png)