ParaRNN:大规模非线性递归神经网络,可并行训练

Apple Machine Learning Research

·

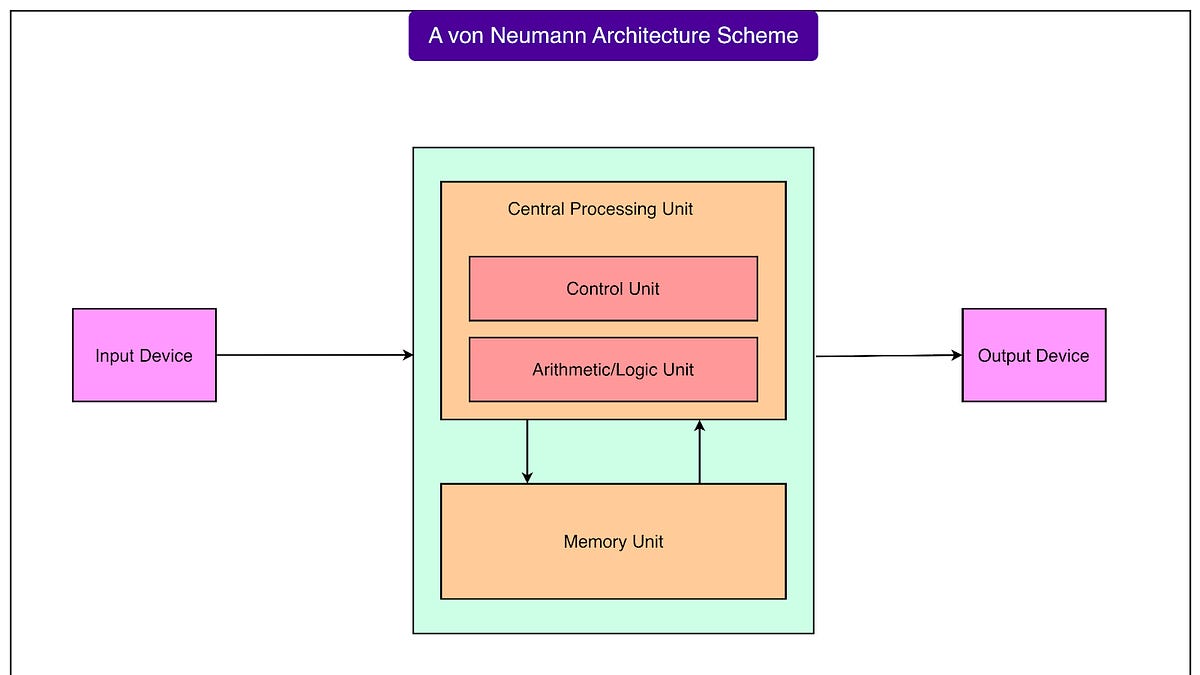

GPU 计算的起源

Tony Bai

·

为什么AI需要GPU和TPU:大型语言模型背后的硬件

ByteByteGo Newsletter

·

如何在Python中使用Polars库进行数据分析

freeCodeCamp.org

·

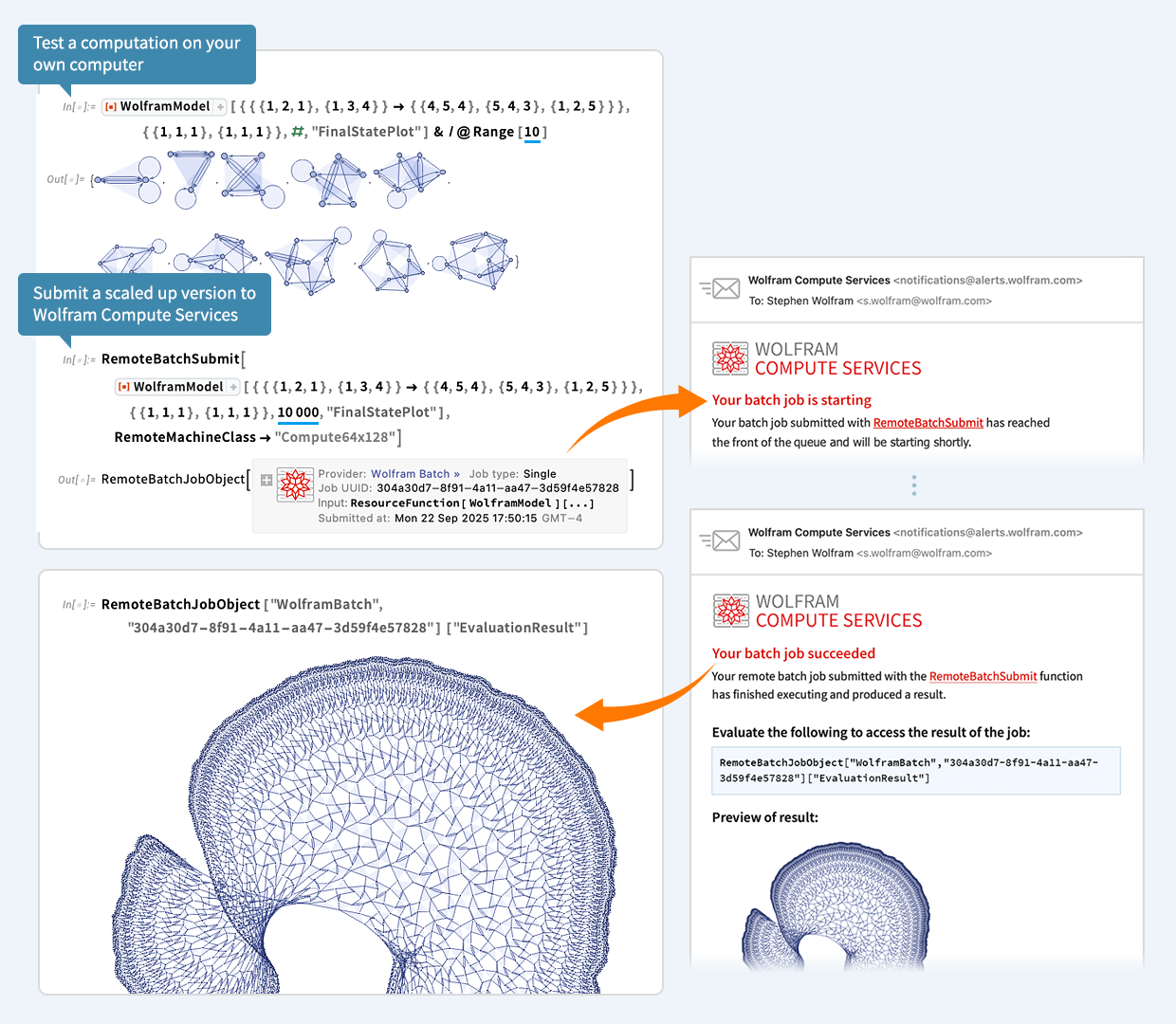

超级增强AI模型构建:使用Ray和Databricks的数据与任务并行

Databricks

·

使用Numba和CUDA在Python中编写您的第一个GPU内核

KDnuggets

·

一、并行编程导论与CUDA入门

张小凯的博客

·

除了真正的并行处理和大数据,esProc SPL 的简洁性让 Python 相形见绌

DEV Community

·

单线程 JavaScript:过去、现在与多线程执行的未来可能性

DEV Community

·