💡

原文英文,约1700词,阅读约需7分钟。

📝

内容提要

Granola是一款AI笔记工具,帮助用户在会议中保持专注,将对话转化为实际进展。它支持生成任务、搜索项目对话和创建自定义提示,适用于多种会议应用。文章还讨论了GPU和TPU在现代大语言模型中的重要性,强调并行计算和内存带宽对AI性能的影响。

🎯

关键要点

- Granola是一款AI笔记工具,帮助用户在会议中保持专注,将对话转化为实际进展。

- Granola支持生成任务、搜索项目对话和创建自定义提示,适用于多种会议应用。

- GPU和TPU在现代大语言模型中扮演重要角色,强调并行计算和内存带宽对AI性能的影响。

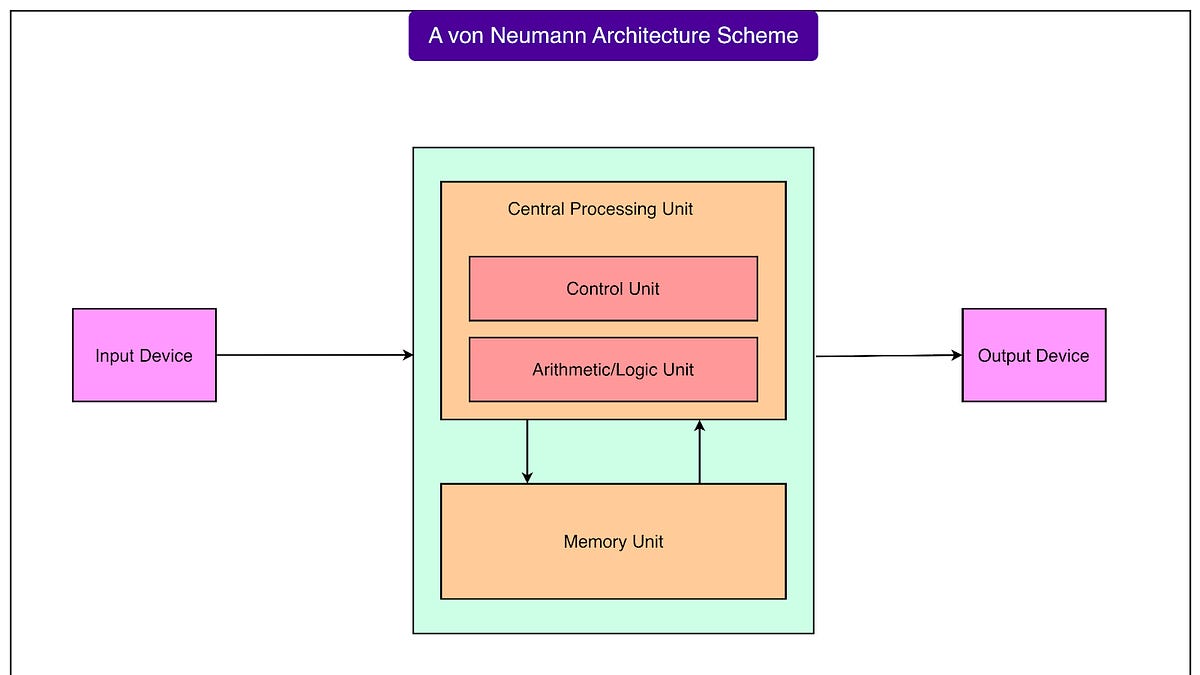

- 每个神经网络的核心操作是矩阵乘法,涉及数十亿次的运算。

- 深度学习需要线性代数、大规模并行处理和概率运算,CPU无法满足这些需求。

- CPU在复杂逻辑和分支决策方面表现出色,但在神经网络的可预测操作中效率低下。

- 内存带宽是影响大语言模型性能的关键因素,而非计算能力。

- GPU通过大规模并行计算和高带宽内存解决了计算瓶颈,适合AI工作负载。

- TPU是谷歌为提高效率而设计的专用处理单元,采用了系统阵列架构。

- 训练和推理对硬件的需求不同,推理对资源的要求相对宽松。

- GPU和TPU的转变代表了计算哲学的根本变化,专注于数据转换和概率运算。

❓

延伸问答

Granola是什么,它有什么功能?

Granola是一款AI笔记工具,帮助用户在会议中保持专注,将对话转化为实际进展,支持生成任务、搜索项目对话和创建自定义提示。

为什么GPU和TPU对大型语言模型如此重要?

GPU和TPU通过并行计算和高带宽内存解决了计算瓶颈,显著提高了AI性能,尤其是在处理大规模矩阵运算时。

CPU在深度学习中的局限性是什么?

CPU在处理复杂逻辑和分支决策方面表现出色,但在神经网络的可预测操作中效率低下,且面临内存带宽瓶颈。

GPU是如何提高AI计算效率的?

GPU通过大规模并行计算和高带宽内存,使用SIMT架构和Tensor Cores来加速矩阵运算,从而提高AI计算效率。

TPU与GPU相比有什么独特之处?

TPU采用系统阵列架构,专为矩阵运算优化,具有更高的能效比,适合处理特定的AI任务,但不支持通用代码。

训练和推理对硬件的需求有什么不同?

训练需要存储参数和梯度,资源需求较高,而推理对资源的要求相对宽松,可以在较低配置的硬件上运行。

➡️