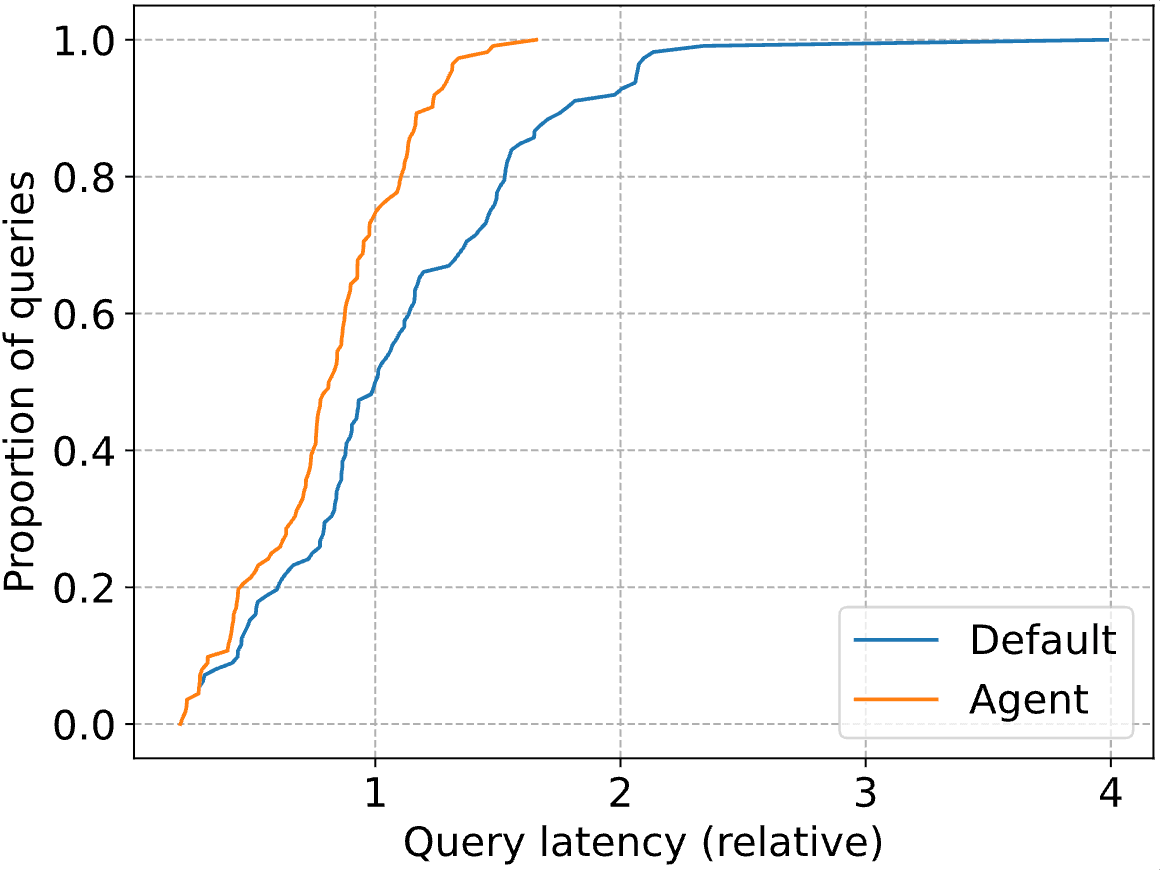

大型语言模型代理在连接顺序优化方面表现如何?

Databricks

·

大型语言模型能理解上下文吗?

Apple Machine Learning Research

·

LinkedIn如何利用大型语言模型(LLM)为13亿用户提供服务

ByteByteGo Newsletter

·

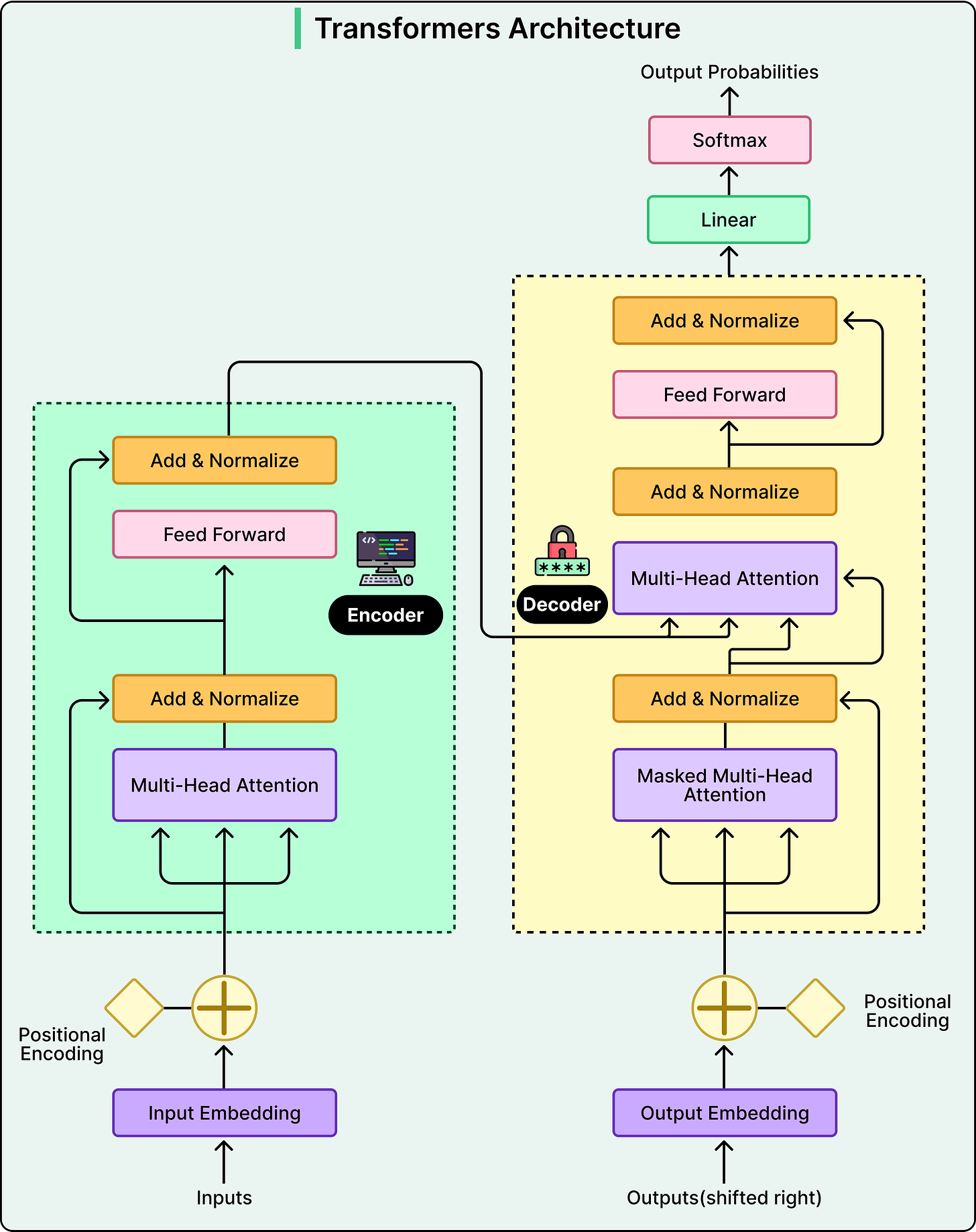

人工智能基础

OpenAI

·

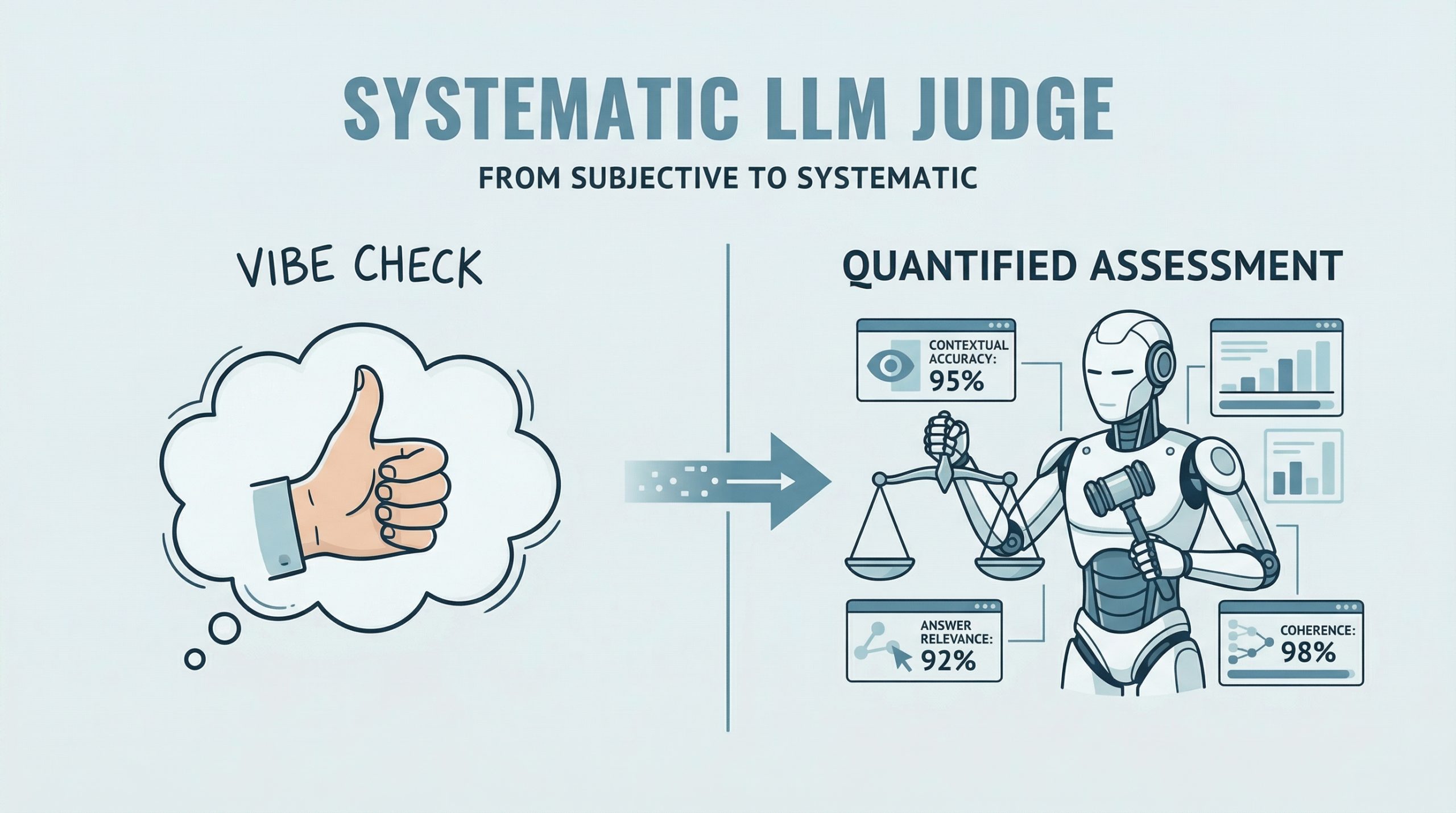

使用RAGAs和G-Eval测试智能体的实践指南

MachineLearningMastery.com

·

甲骨文 ARM 实例部署 Gemma 4 模型

Dejavu's Blog

·

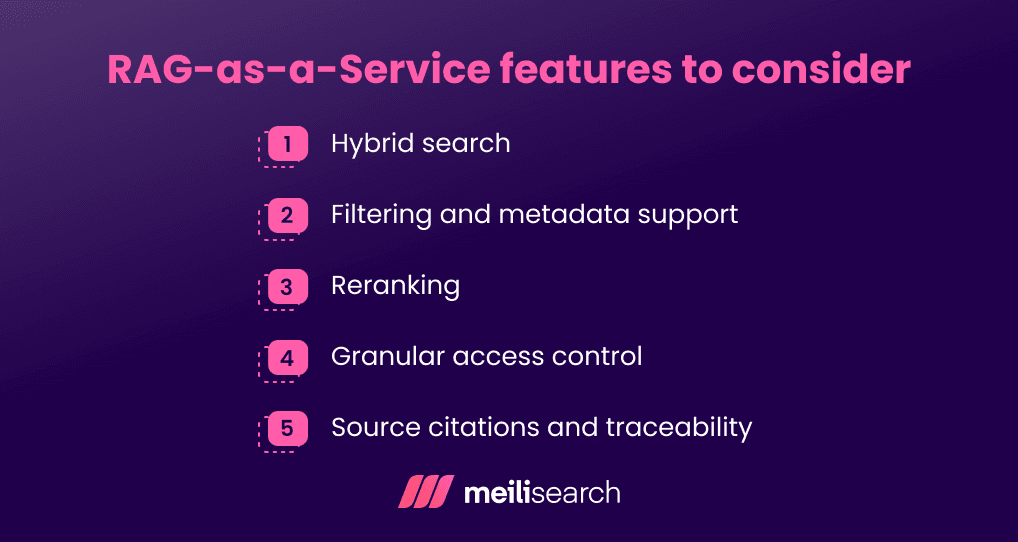

检索增强生成即服务:概念、应用案例、提供商及更多

meilisearch blog

·

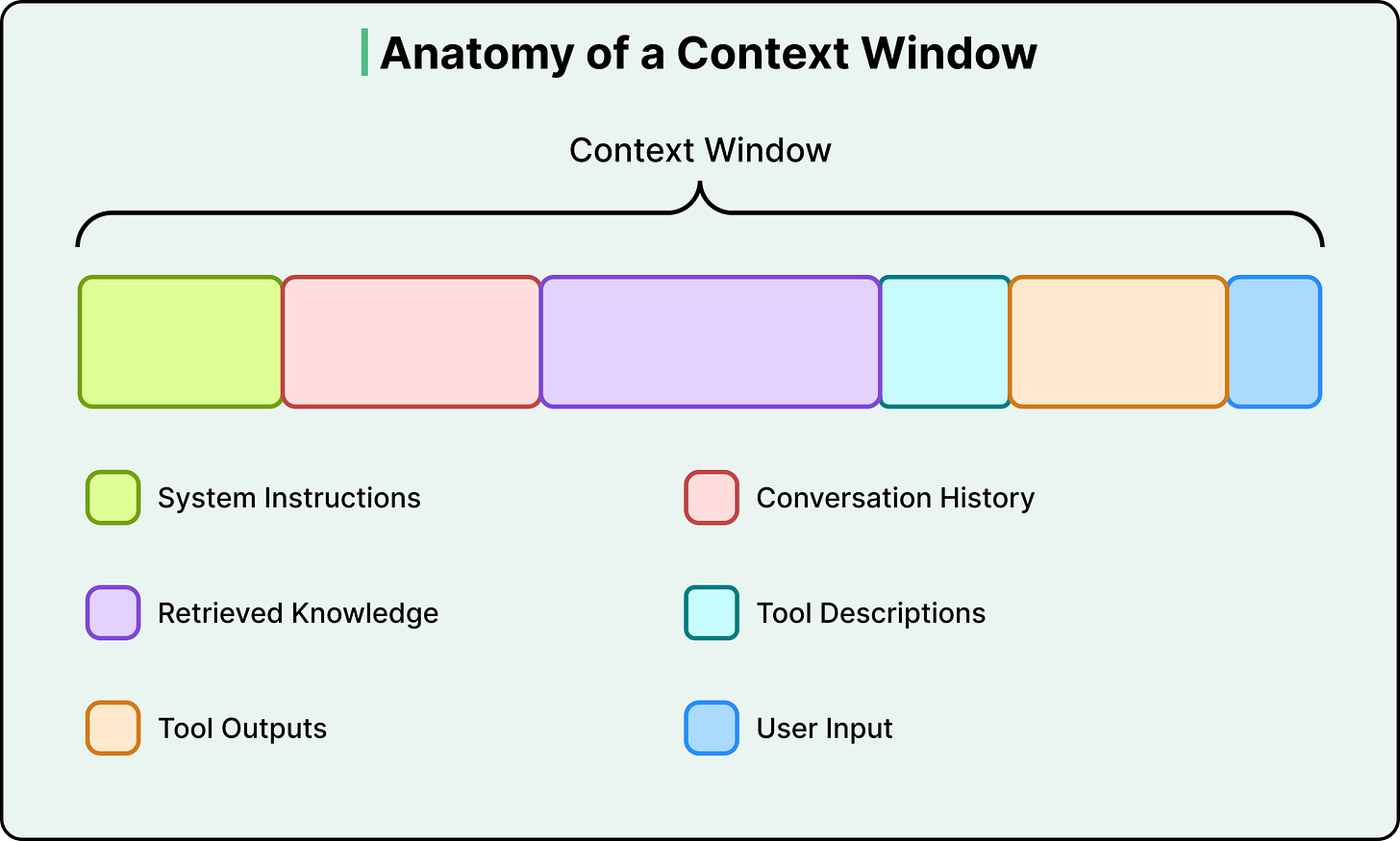

大型语言模型的上下文工程指南

ByteByteGo Newsletter

·