💡

原文英文,约1400词,阅读约需5分钟。

📝

内容提要

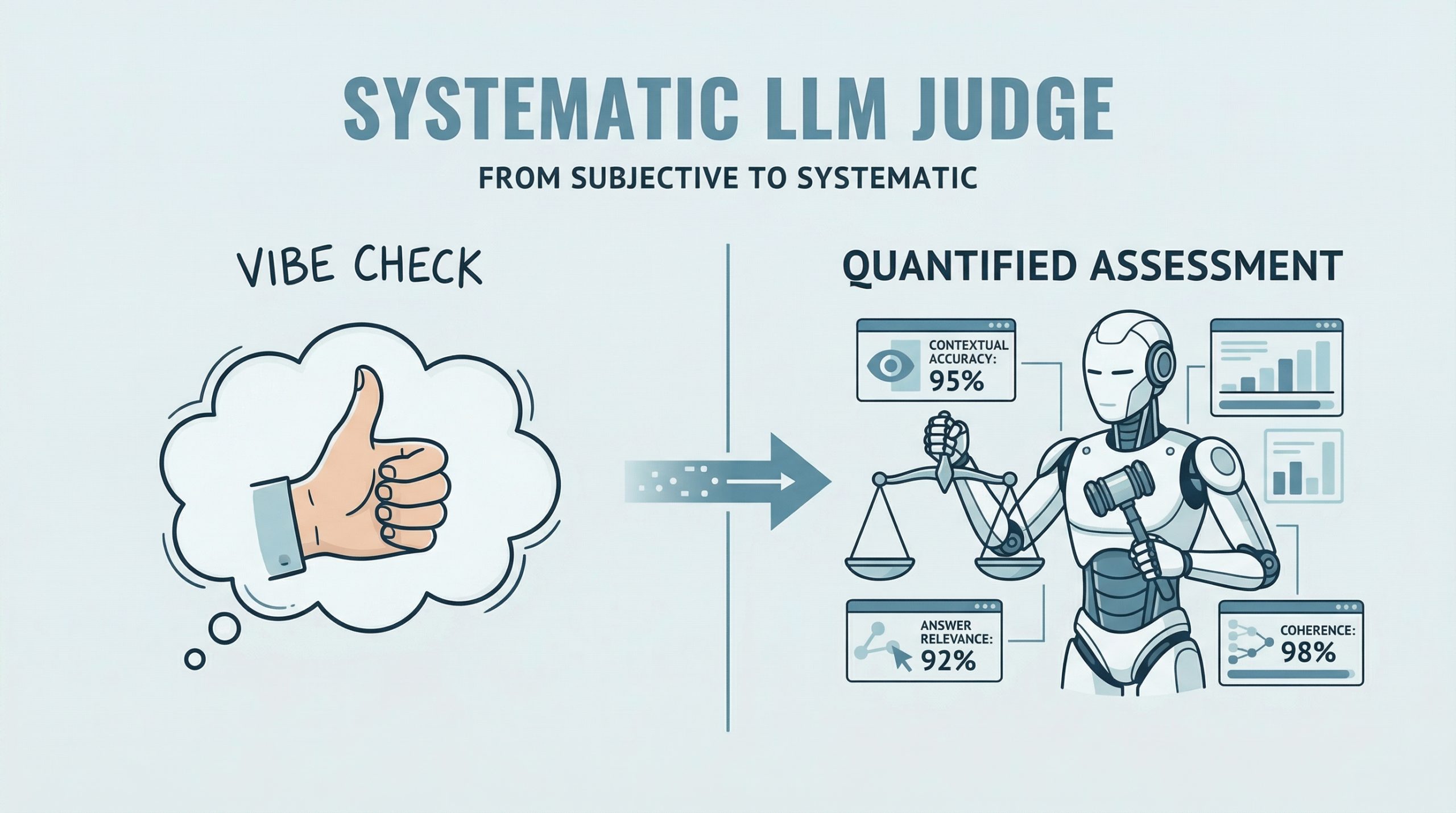

本文介绍了如何使用RAGAs和G-Eval框架评估大型语言模型应用。RAGAs是一个开源评估框架,旨在量化检索增强生成系统的质量,重点关注上下文准确性和答案相关性。文章提供了构建评估数据集、集成测试管道及使用DeepEval评估生成内容连贯性的实践指南。通过结合结构化指标和定性评估,可以建立更全面的AI系统评估流程。

🎯

关键要点

-

RAGAs(检索增强生成评估)是一个开源评估框架,旨在量化检索增强生成系统的质量,重点关注上下文准确性和答案相关性。

-

文章提供了构建评估数据集、集成测试管道及使用DeepEval评估生成内容连贯性的实践指南。

-

通过结合结构化指标(如忠实度和相关性)与定性评估(如连贯性),可以建立更全面的AI系统评估流程。

-

DeepEval作为定性评估层,使用推理和评分方法来评估生成内容的连贯性、清晰度和专业性。

❓

延伸问答

RAGAs框架的主要功能是什么?

RAGAs框架旨在量化检索增强生成系统的质量,重点关注上下文准确性和答案相关性。

如何构建评估数据集以使用RAGAs进行测试?

可以通过定义问题、答案和上下文的结构化数据集来构建评估数据集。

DeepEval在评估中起什么作用?

DeepEval作为定性评估层,使用推理和评分方法来评估生成内容的连贯性、清晰度和专业性。

如何使用G-Eval进行生成内容的评估?

可以定义自定义评估指标,并创建测试用例来运行G-Eval评估生成内容的质量。

RAGAs和G-Eval的结合如何提高评估的全面性?

通过结合结构化指标(如忠实度和相关性)与定性评估(如连贯性),可以建立更全面的AI系统评估流程。

在评估大型语言模型时需要注意哪些API配置?

在运行评估之前,需要确保API密钥已正确配置,并且有足够的API配额。

➡️