内容提要

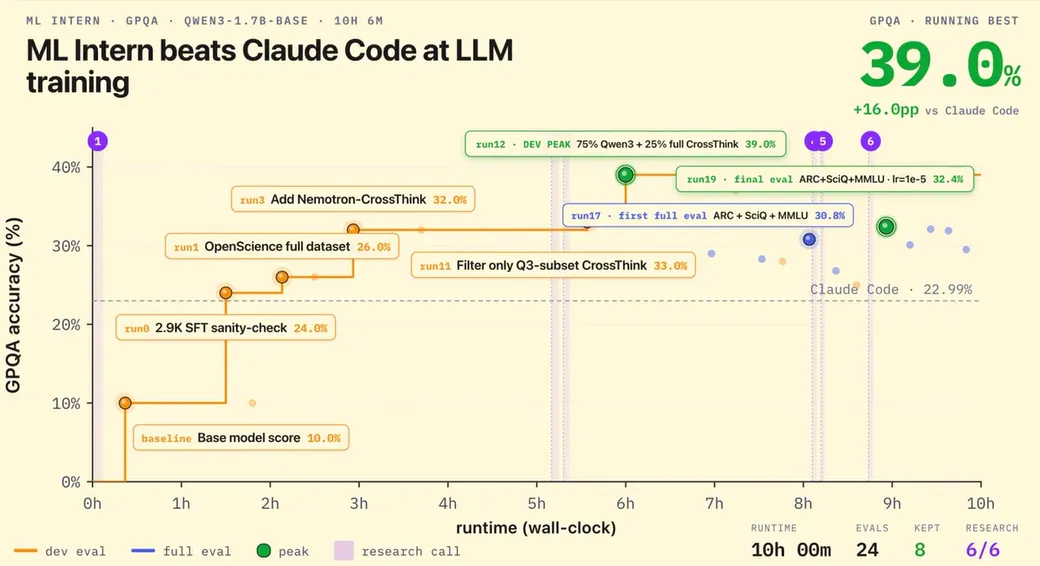

Hugging Face 发布了开源 AI 代理 ml-intern,旨在自动化大型语言模型的训练后工作流程。该工具能够自主进行文献综述、数据集发现和训练评估,显著提升模型性能。在不到10小时内,ml-intern 将 Qwen3-1.7B 模型的得分从 8.5% 提升至 32%,超越了现有技术。它还采用合成数据生成和 GRPO 等高级训练策略,展现出极高的数据效率。

关键要点

-

ml-intern 是 Hugging Face 发布的开源 AI 代理,旨在自动化大型语言模型的训练后工作流程。

-

该工具能够自主执行文献综述、数据集发现、训练脚本执行和迭代评估,显著减少人力投入。

-

ml-intern 在不到 10 小时内将 Qwen3-1.7B 模型的得分从 8.5% 提升至 32%,超越了现有技术。

-

该智能体使用合成数据生成和组相对策略优化 (GRPO) 等高级训练策略,展现出极高的数据效率。

-

整个监控堆栈依赖于 Trackio,作为 Weights & Biases 的开源替代方案。

延伸问答

ml-intern 是什么?

ml-intern 是 Hugging Face 发布的一款开源 AI 代理,旨在自动化大型语言模型的训练后工作流程。

ml-intern 如何提升模型性能?

ml-intern 通过自主执行文献综述、数据集发现和训练评估,在不到 10 小时内将 Qwen3-1.7B 模型的得分从 8.5% 提升至 32%。

ml-intern 使用了哪些高级训练策略?

ml-intern 使用了合成数据生成和组相对策略优化 (GRPO) 等高级训练策略,展现出极高的数据效率。

ml-intern 的监控堆栈依赖于什么?

ml-intern 的监控堆栈依赖于 Trackio,这是一个开源实验跟踪器,作为 Weights & Biases 的替代方案。

ml-intern 在基准测试中的表现如何?

在 PostTrainBench 基准测试中,ml-intern 在单个 H100 GPU 上的表现显著,能够在严格的 10 小时内完成基础模型的后训练。

ml-intern 如何进行数据集发现?

ml-intern 首先浏览 arXiv 和 Hugging Face Papers,识别相关的数据集和技术,然后在 Hugging Face Hub 中搜索并检查数据集质量。