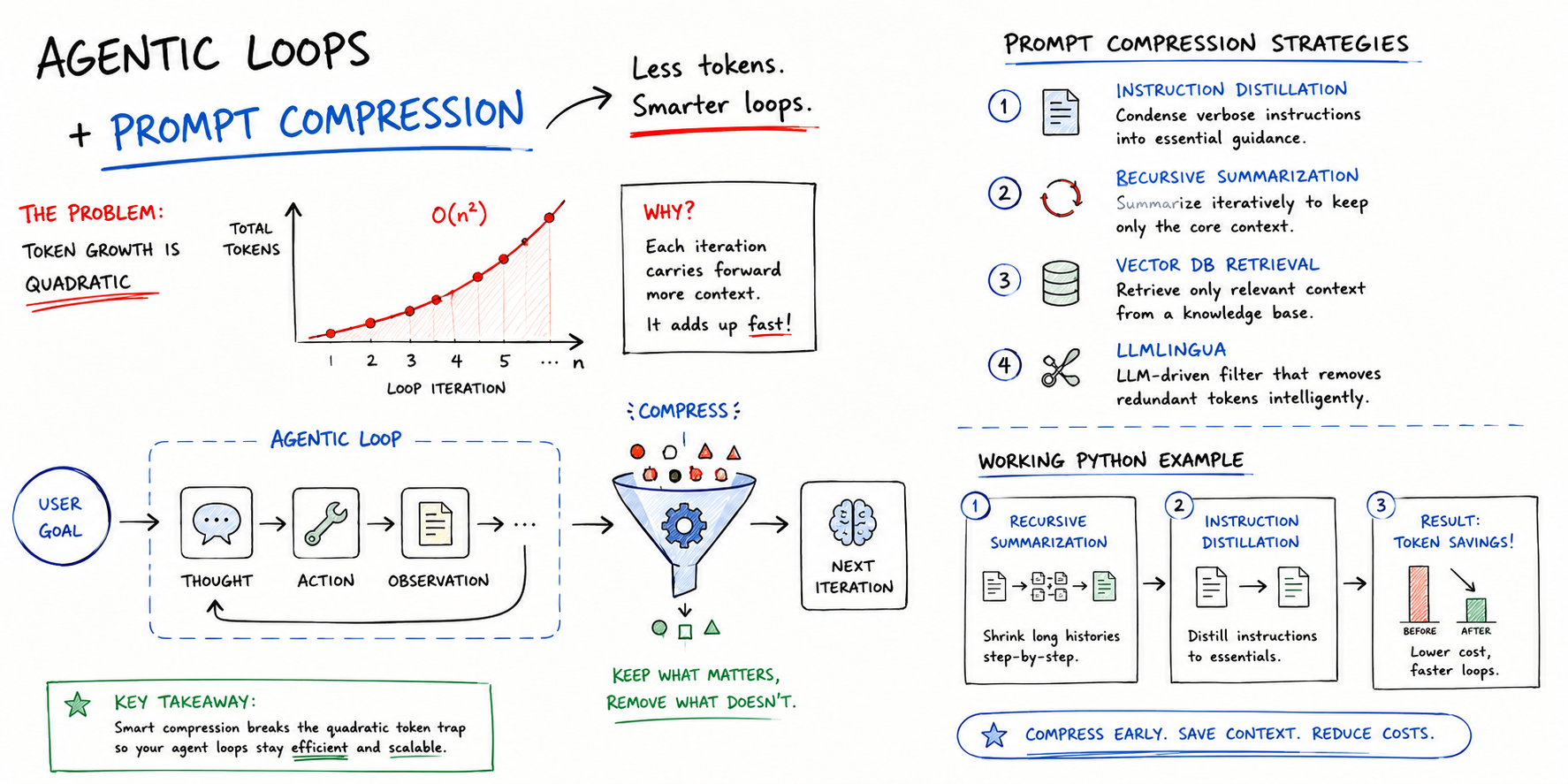

实施提示压缩以降低代理循环成本

MachineLearningMastery.com

·

上下文修剪:在不损失质量的情况下减少LLM令牌

Redis Blog

·

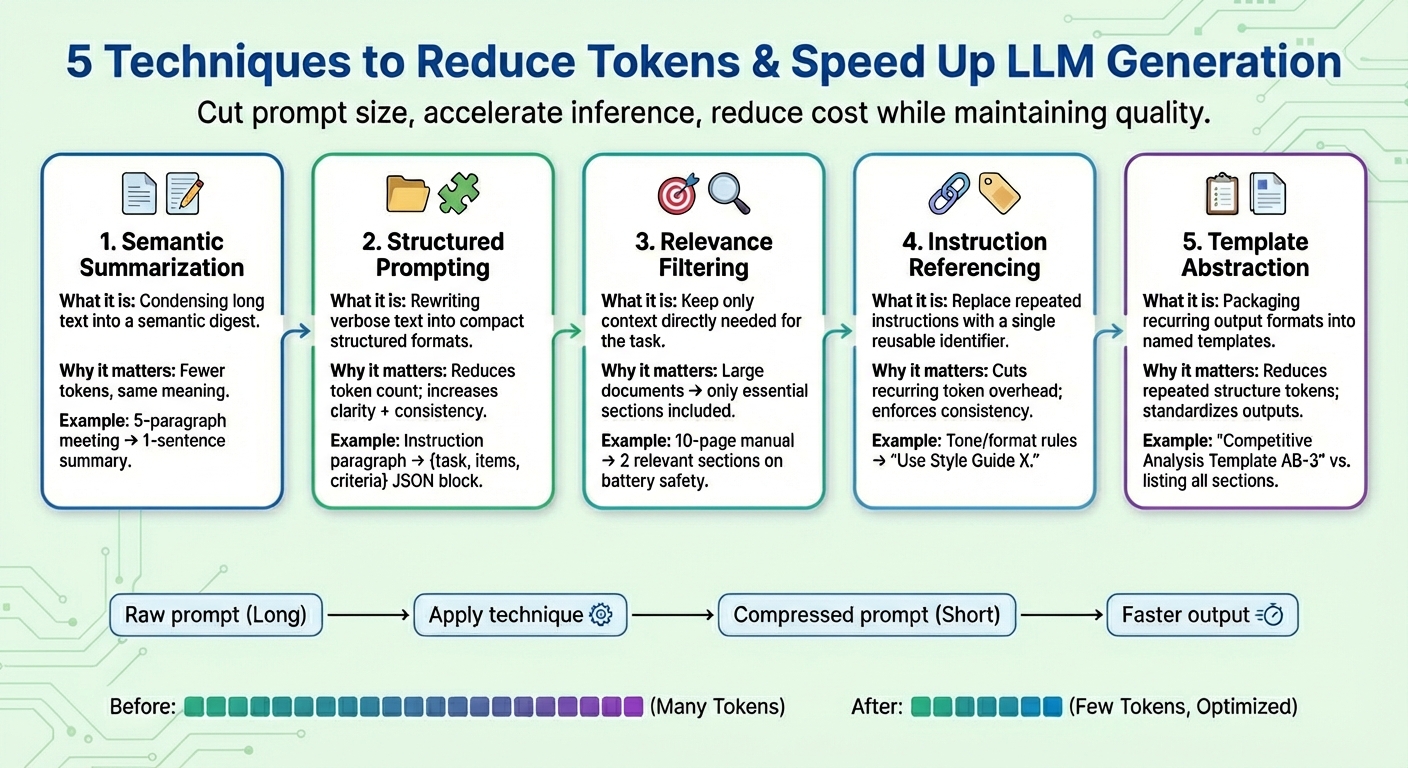

大型语言模型生成优化与成本降低的提示压缩

MachineLearningMastery.com

·

如何构建一个提示压缩器,在不失去意义的情况下降低LLM令牌成本

DEV Community

·

使用此技术将大型语言模型成本降低超过50%

DEV Community

·