通过MLflow和Databricks学习MLOps

freeCodeCamp.org

·

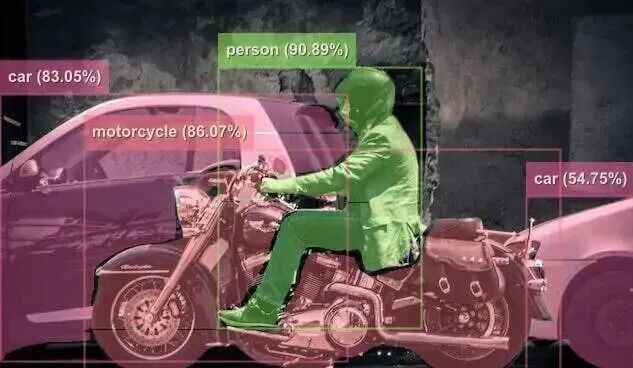

多模型智能识别平台还能这么玩?.NET 10 + YOLO + AI 解锁工业级视觉应用新姿势

dotNET跨平台

·

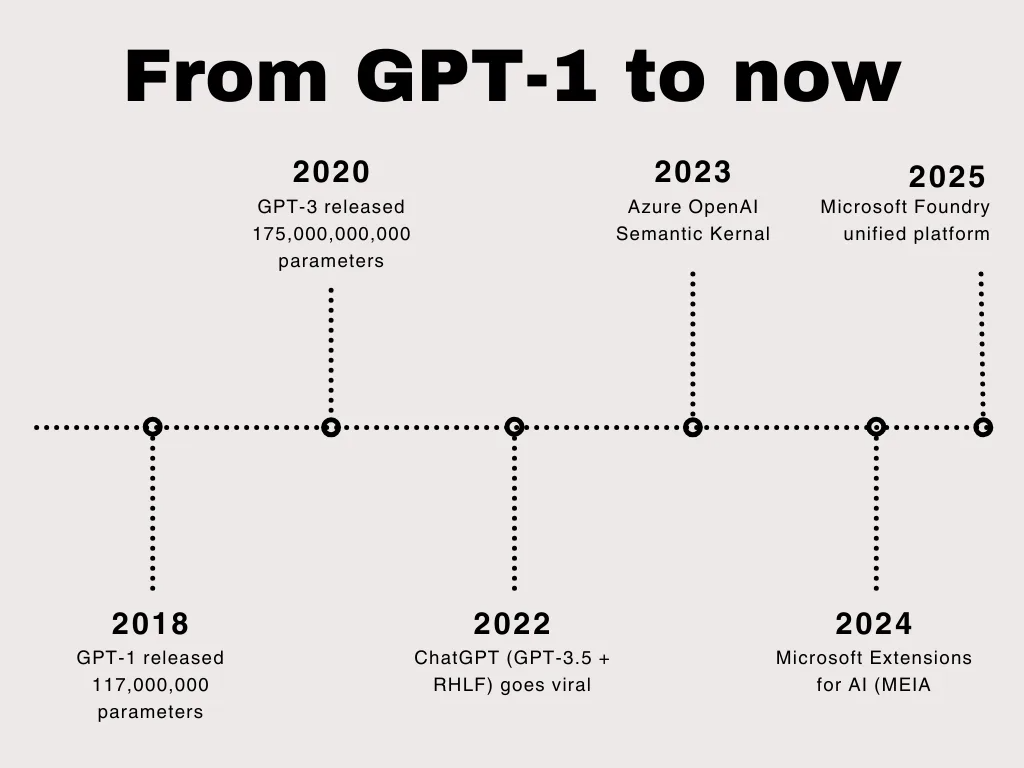

2026 年在 C# 中使用大型语言模型进行生成式 AI

dotNET跨平台

·

什么是AI PaaS?人工智能开发的未来指南

The New Stack

·

【TVM 教程】设置 RPC 系统

HyperAI超神经

·

LinkedIn重新设计边缘构建系统以支持多样化的推理工作流

InfoQ

·

如何在单台服务器上使用Llama-Swap本地运行多个大型语言模型

KDnuggets

·

MLFlow 精通:实验跟踪与模型管理的完整指南

KDnuggets

·

构建可扩展的自主智能平台:技术深度探讨 - 第二部分

DEV Community

·

在无网络连接的情况下运行Ollama容器

DEV Community

·

KitOps 1.0 发布——在生产环境中验证,展望CNCF

Cloud Native Computing Foundation

·