参数与FLOPs:混合专家语言模型的最佳稀疏性扩展规律

Apple Machine Learning Research

·

稠密专家混合模型的泛化误差分析:初步研究

BriefGPT - AI 论文速递

·

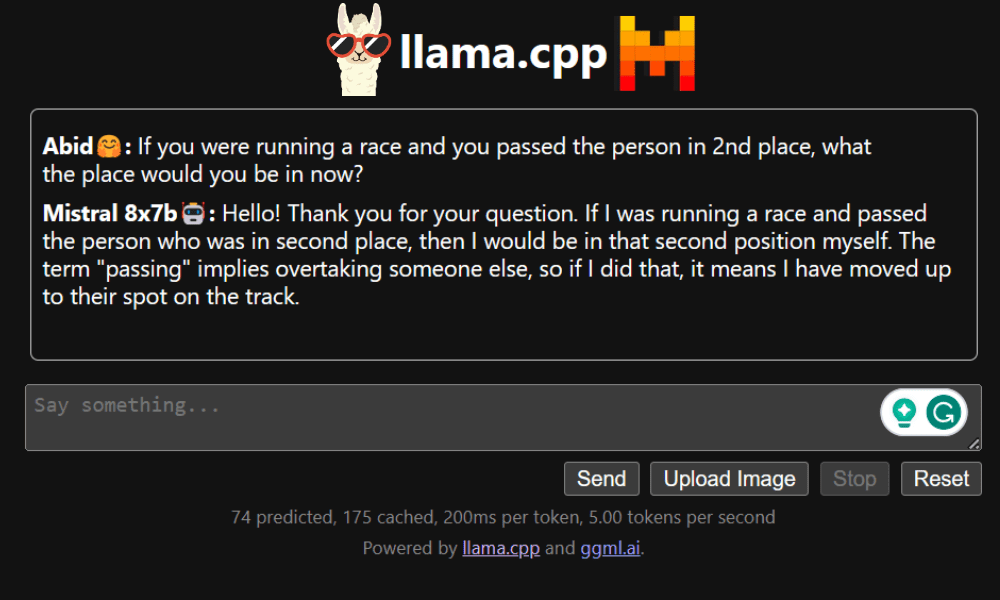

在Google Colab上免费运行Mixtral 8x7b

KDnuggets

·