生成AI系统的隐性技术债务

Databricks

·

软件测试中的人工智能:革命还是演变?

DEV Community

·

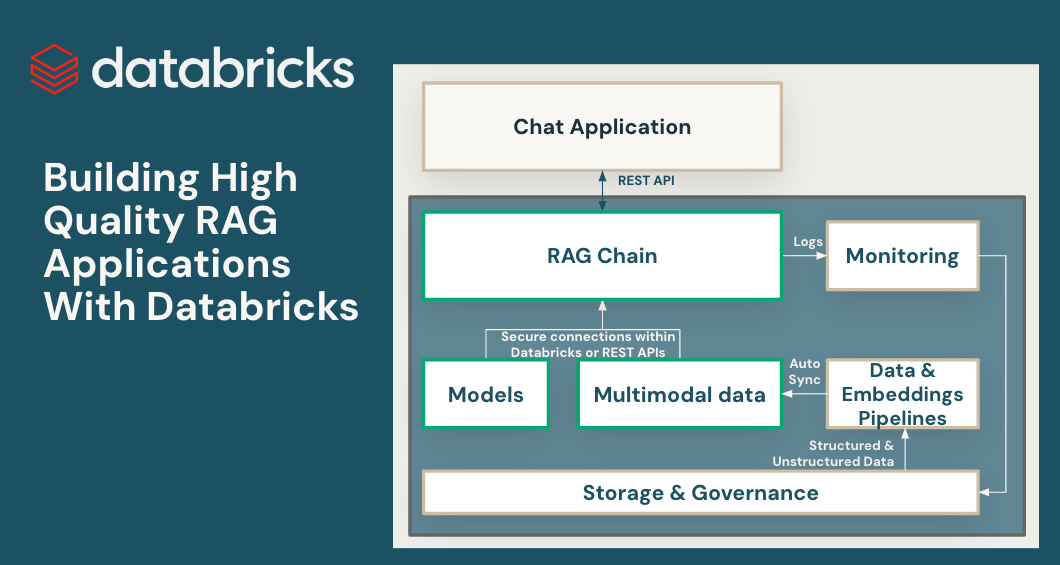

使用Databricks创建高质量的RAG应用程序

Databricks

·

使用 Lakehouse AI 简化生产 MLOps

Databricks

·