7个提升预测模型准确性的XGBoost技巧

KDnuggets

·

超越网格搜索的三种超参数调优技术

KDnuggets

·

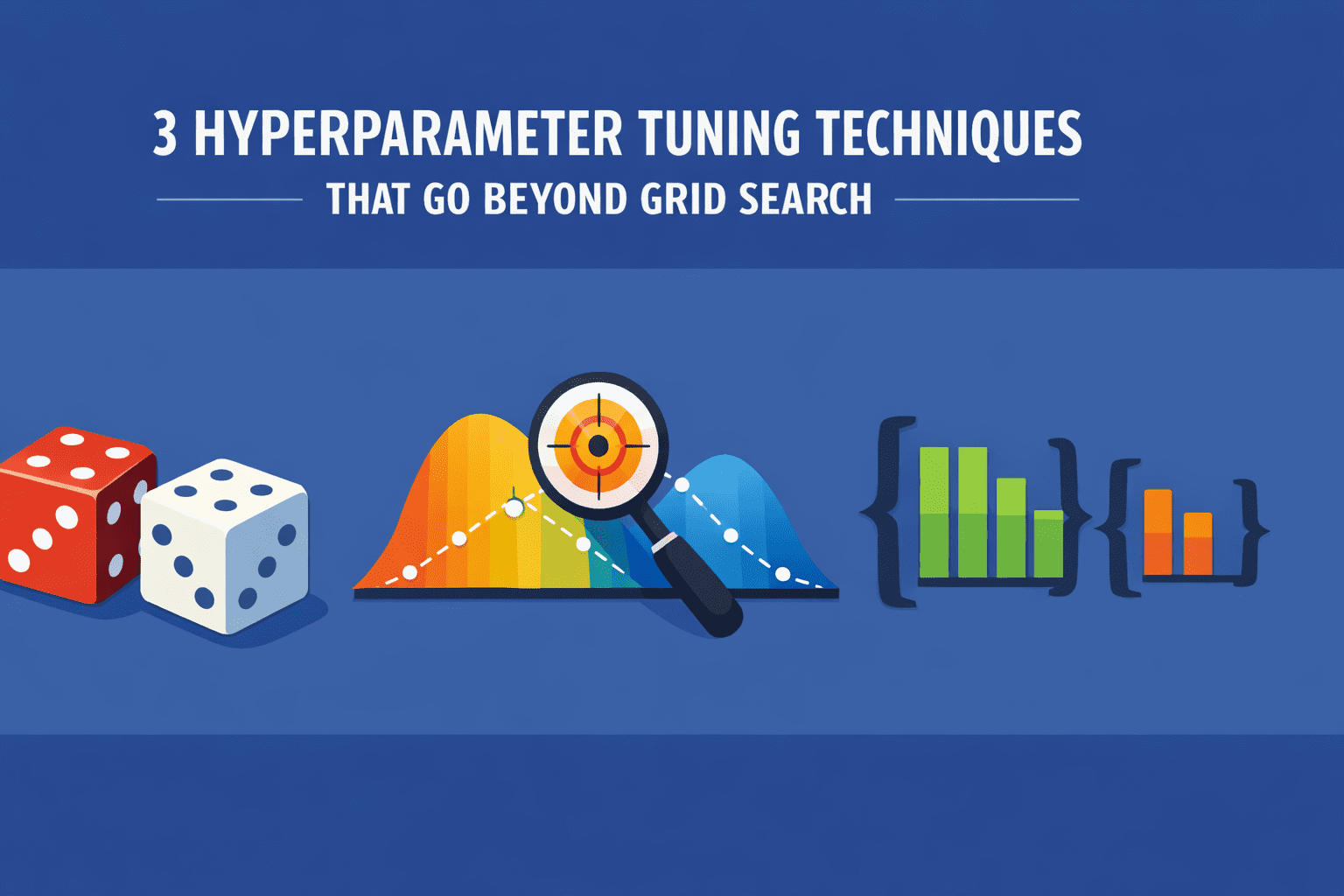

检索优化器:贝叶斯优化

Redis Blog

·

大型语言模型微调经验

informal

·

斯坦福CS336:从零开始的语言建模 | 2025年春季 | 架构与超参数

Josherich的博客

·

学习率

DEV Community

·