探索HuggingFace与构建AI考试题目生成器

DEV Community

·

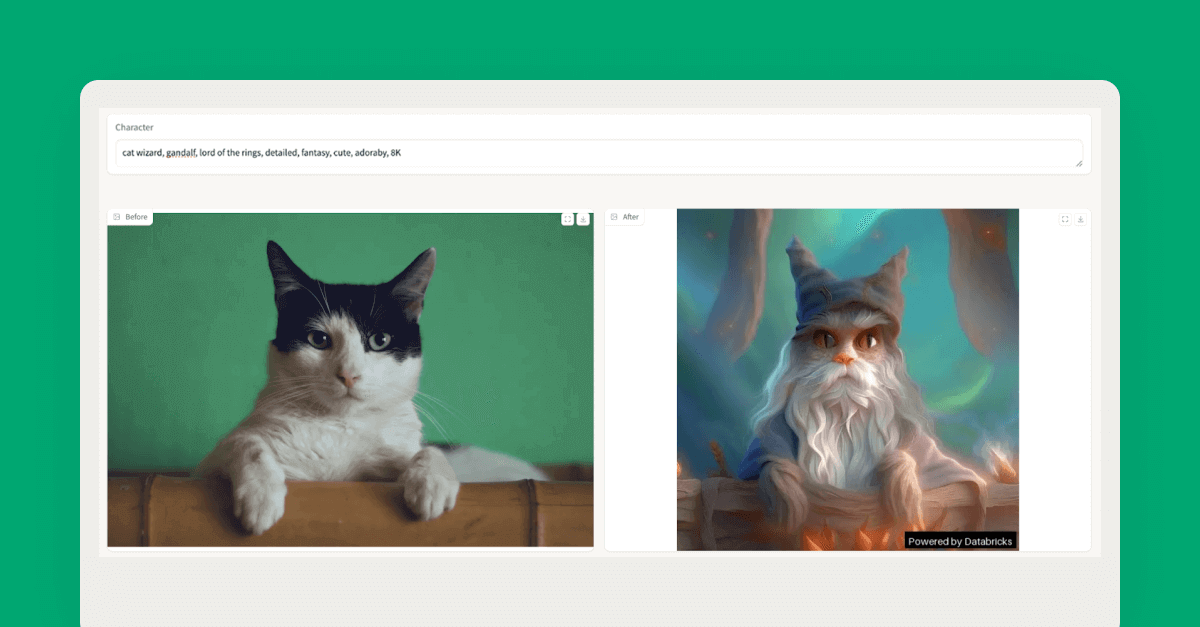

如何在Google Colab上运行stable-diffusion-3.5-large-turbo

DEV Community

·

在大陆下载huggingface模型

DEV Community

·

Stability AI在Huggingface上发布的Stable-Diffusion-Xl-Base-1.0模型初学者指南

DEV Community

·

Compvis在Huggingface上发布的Stable-Diffusion-V1-4模型初学者指南

DEV Community

·