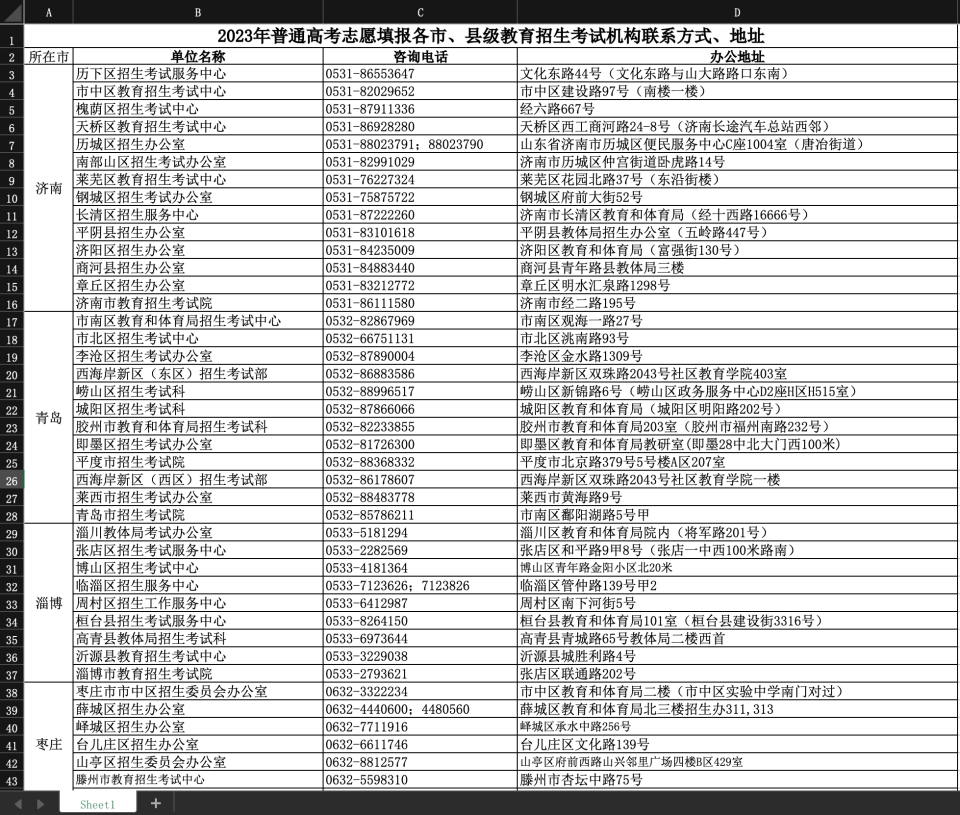

优化Hugging Face Transformer管道的5个技巧

KDnuggets

·

使用Hugging Face Transformers微调和部署GPT模型

The JetBrains Blog

·

关注并不是我们所需的一切;我们还需要拥有权

Stack Overflow Blog

·

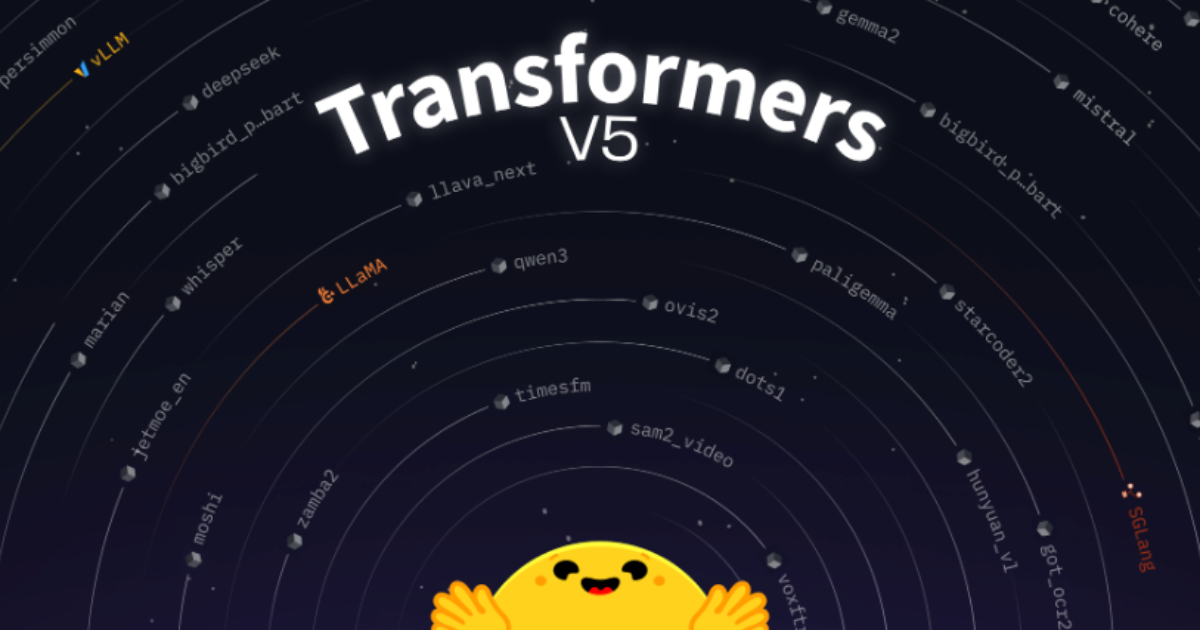

使用Ollama、vLLM或Transformers本地安装DeepSeek-R1-0528的逐步指南

DEV Community

·