💡

原文中文,约9600字,阅读约需23分钟。

📝

内容提要

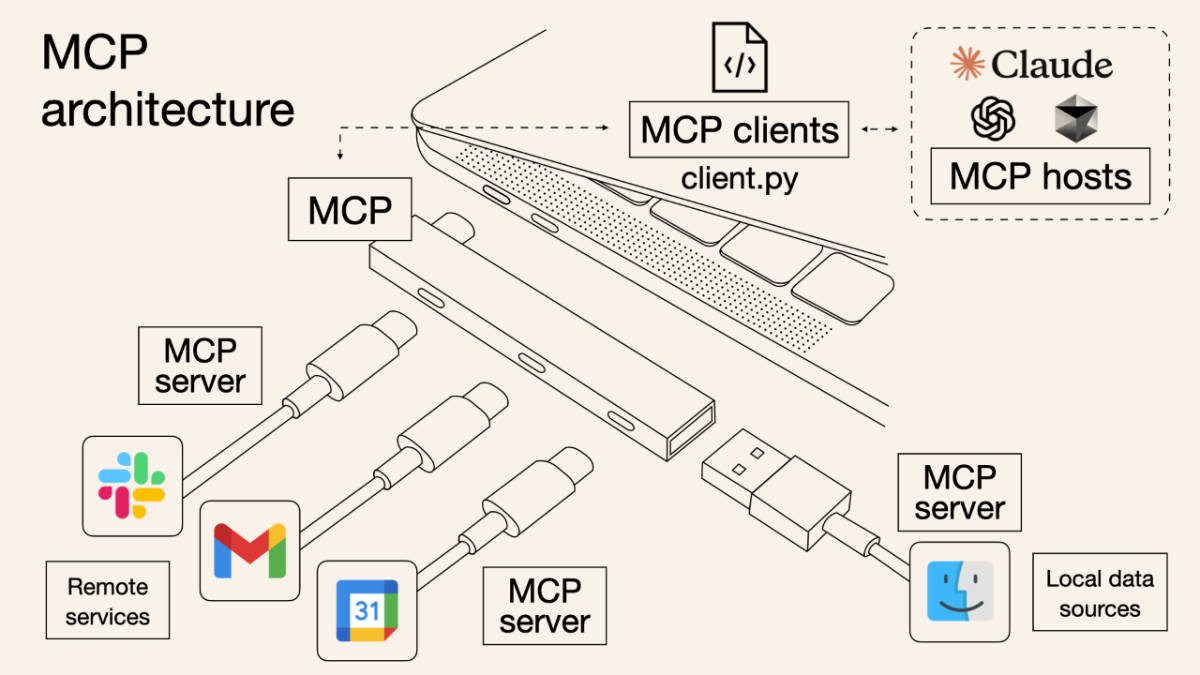

本文总结了模型上下文协议(MCP)的起源、核心概念及生态发展。MCP旨在通过标准化协议解决大模型知识更新问题,增强AI应用与外部工具的交互能力。其架构包括主机、客户端和服务器,支持实时更新和工具调用,逐渐成为行业标准,推动AI应用的实际价值。

🎯

关键要点

- MCP(模型上下文协议)旨在通过标准化协议解决大模型知识更新问题,增强AI应用与外部工具的交互能力。

- MCP的架构包括主机、客户端和服务器,支持实时更新和工具调用,逐渐成为行业标准。

- 大语言模型(LLM)如ChatGPT的强大能力改变了人们获取知识的方式,但其知识更新受限于训练数据。

- 为了解决大模型知识更新问题,行业采用了模型微调和补充上下文两种方案。

- RAG(检索增强生成)技术允许大模型结合外部知识库,但存在检索速度和准确率的挑战。

- OpenAI推出的函数调用机制扩展了大模型的能力,但缺乏统一的行业标准。

- Anthropic推出的MCP是一个开放标准,旨在安全、方便地连接大模型与外部数据和工具。

- MCP协议的核心概念包括工具、资源和提示词,定义了客户端和服务器之间的交互。

- MCP支持实时更新,允许服务器主动通知客户端变化,提升交互效率。

- MCP生态逐渐形成,包含配套工具、应用市场和企业级解决方案,推动行业发展。

❓

延伸问答

MCP的主要目标是什么?

MCP旨在通过标准化协议解决大模型知识更新问题,增强AI应用与外部工具的交互能力。

MCP的架构包含哪些角色?

MCP的架构包括主机、客户端和服务器。

MCP如何支持实时更新?

MCP允许服务器主动通知客户端变化,从而提升交互效率。

RAG技术在MCP中有什么作用?

RAG技术允许大模型结合外部知识库,增强模型的回答能力,但面临检索速度和准确率的挑战。

MCP与OpenAI的函数调用机制有什么区别?

MCP是一个开放标准,旨在统一大模型与外部数据的连接,而函数调用机制缺乏统一标准,存在实现差异。

MCP的生态系统是怎样发展的?

MCP生态逐渐形成,包含配套工具、应用市场和企业级解决方案,推动行业发展。

➡️