💡

原文中文,约23900字,阅读约需57分钟。

📝

内容提要

本文介绍了Rust与AI系列的第二篇,主要讲解了LLM的基本架构和参数,包括Token的分词和映射过程,生成过程的采样方法,以及LLaMA模型的结构和参数。最后,文章介绍了LLaMA在Rust中的实现。

🎯

关键要点

- 本文是《Rust与AI》系列的第二篇,介绍LLM的基本架构,以LLaMA模型为例。

- LLM中的Token是语言的基本单位,输入和输出都是Token。

- Token化过程将自然语言文本转化为数字索引,映射到稠密向量表示语义。

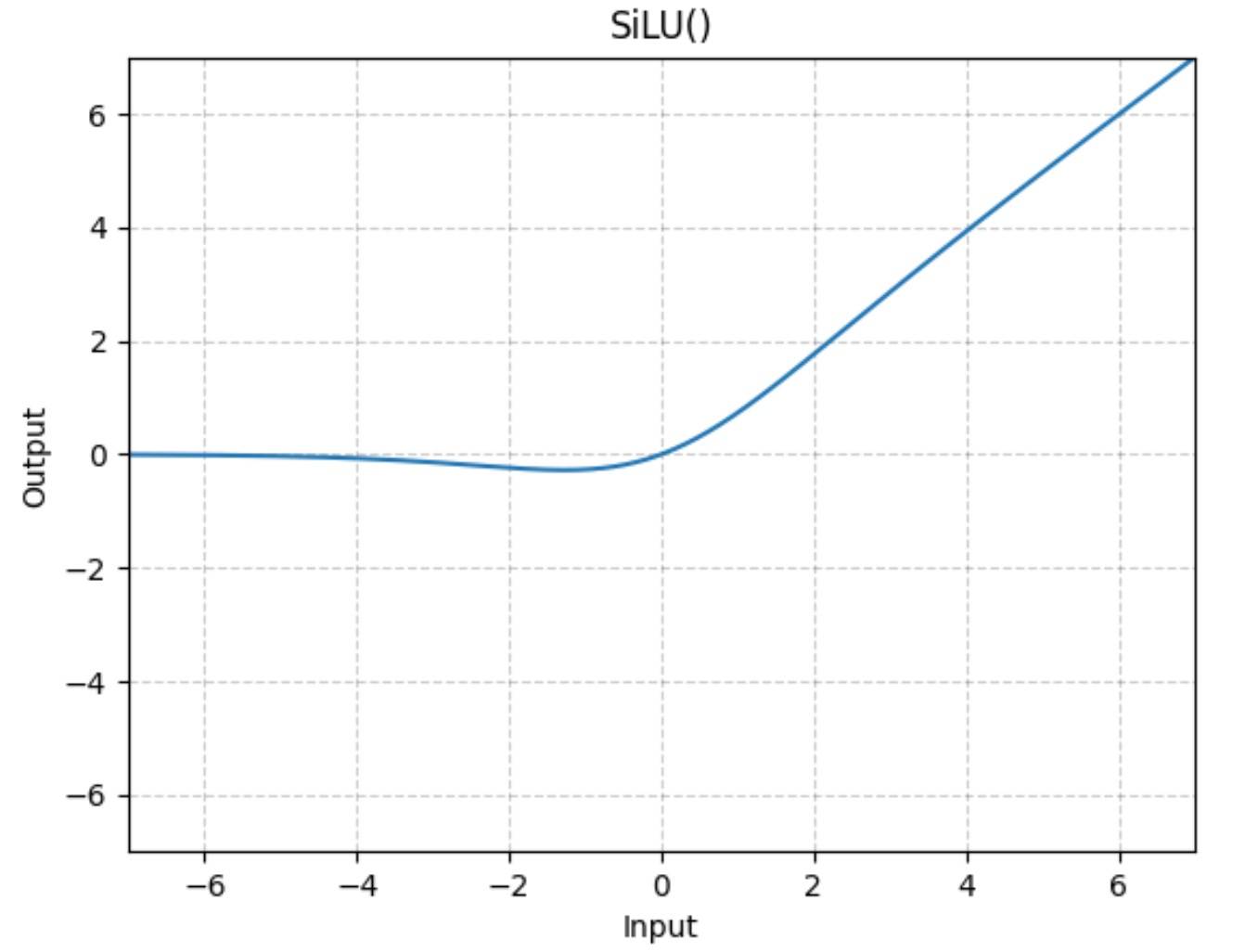

- 生成过程通过概率分布采样下一个Token ID,常用方法包括Greedy Search和top_p/top_k采样。

- LLaMA模型的结构相对简单,主要包括MHA和FFN模块,使用残差连接和归一化。

- LLaMA的参数规模通常为7B、13B、20B,涉及大量矩阵运算。

- Rust实现LLaMA模型需要配置模型参数,包括维度、层数、头数等。

- Tokenizer负责将文本转为ID列表和反向操作。

- 模型参数包括Token嵌入表、权重矩阵、位置编码等。

- 模型推理过程包括取Embedding、逐层计算、Normalization和映射到词表大小的logits。

- 生成过程通过填充KV缓存和采样生成新Token,temperature参数影响生成的多样性。

- 本文讨论了LLM的背景、Token和生成过程,LLaMA模型的结构和参数,以及Rust的实现细节。

➡️