💡

原文英文,约6400词,阅读约需24分钟。

📝

内容提要

本文介绍了使用MMS Adapter训练优化多语言ASR模型的方法,包括数据预处理、模型训练等。需要注意的是,在训练模型之前进行数据预处理非常重要。

🎯

关键要点

- 本文介绍了使用MMS Adapter训练优化多语言ASR模型的方法。

- 数据预处理在训练模型之前非常重要。

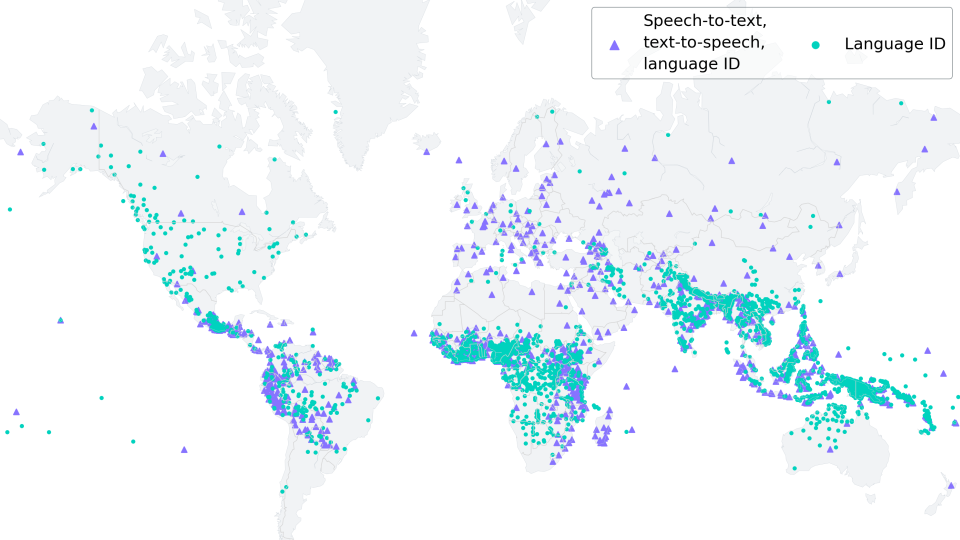

- MMS模型能够识别、转录和生成1100多种语言的语音。

- 对于低资源语言,建议使用MMS的Adapter训练,而不是微调整个模型。

- MMS的Adapter训练在内存效率和性能上优于微调整个模型。

- MMS能够帮助保护濒危语言,促进语言多样性。

- Adapter层作为语言之间的桥梁,帮助模型理解不同语言的特征。

- MMS的无监督检查点在1400多种语言上预训练,具有300百万到10亿个参数。

- 训练过程中使用Connectionist Temporal Classification (CTC)算法。

- 数据预处理包括创建特征提取器和分词器。

- 在训练过程中,使用动态填充以提高效率。

- 训练过程中使用字错误率(WER)作为评估指标。

- MMS的Adapter权重训练显著提高了低资源语言的性能。

- 训练完成后,可以将Adapter权重上传到Hugging Face Hub。

- 通过简单的修改,可以为不同语言训练新的Adapter层。

➡️