💡

原文中文,约7600字,阅读约需18分钟。

📝

内容提要

AIGC技术推动大模型应用,但面临算力成本高和通信调度复杂等挑战。火山引擎推出RocketMQ For AI解决方案,通过轻量化通信和智能调度,提升系统稳定性和算力利用率,支持企业级大模型落地。新特性如LiteTopic和优先级消息优化了消息处理,满足AI场景需求。

🎯

关键要点

-

AIGC技术推动大模型应用,但面临算力成本高和通信调度复杂等挑战。

-

火山引擎推出RocketMQ For AI解决方案,核心在于轻量化通信和智能调度。

-

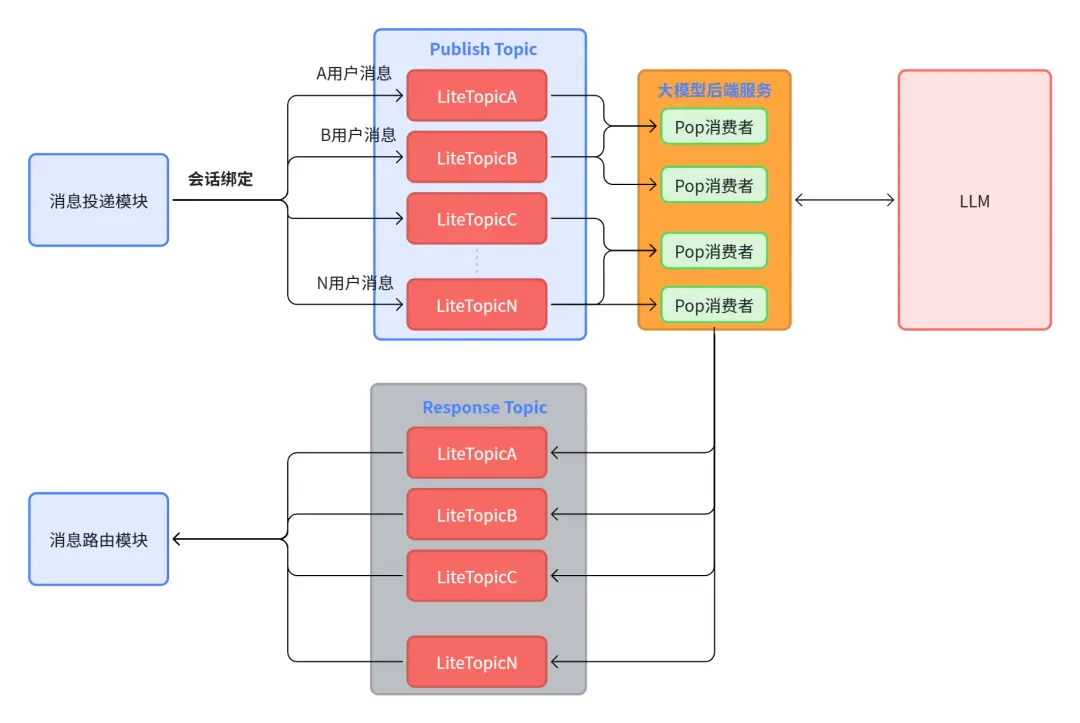

新特性LiteTopic允许创建上百万个主题,解决传统队列数量限制问题。

-

优先级消息功能提供灵活的消息处理,支持不同优先级的任务调度。

-

RocketMQ通过LiteTopic和优先级消息优化了消息处理,满足AI场景需求。

-

新架构支持长会话链路和多智能体协作,提高系统的并发能力和可靠性。

-

未来MQ将转变为AI系统中的事件总线,支持Serverless化以应对突发流量需求。

❓

延伸问答

RocketMQ For AI 解决方案的核心特点是什么?

RocketMQ For AI 解决方案的核心特点是轻量化通信、智能化调度和企业级可靠性,旨在提升系统稳定性和算力利用率。

LiteTopic 如何解决传统队列数量限制的问题?

LiteTopic 允许创建上百万个主题,避免了传统队列数量限制带来的问题,支持更高效的消息处理。

优先级消息功能如何优化任务调度?

优先级消息功能通过将不同优先级的消息映射到专属的ConsumeQueue,实现灵活的消息处理和任务调度。

RocketMQ 在 AI 场景中如何支持多智能体协作?

RocketMQ 通过 LiteTopic 和优先级消息特性,支持多智能体的任务分发和结果回收,提高并发能力和可靠性。

RocketMQ For AI 解决方案如何应对算力成本高的问题?

该解决方案通过优化通信和调度,提高算力利用率,从而降低算力成本。

未来MQ在AI系统中的角色将如何变化?

未来MQ将转变为AI系统中的事件总线,支持Serverless化,以应对突发流量需求。

➡️