💡

原文英文,约1300词,阅读约需5分钟。

📝

内容提要

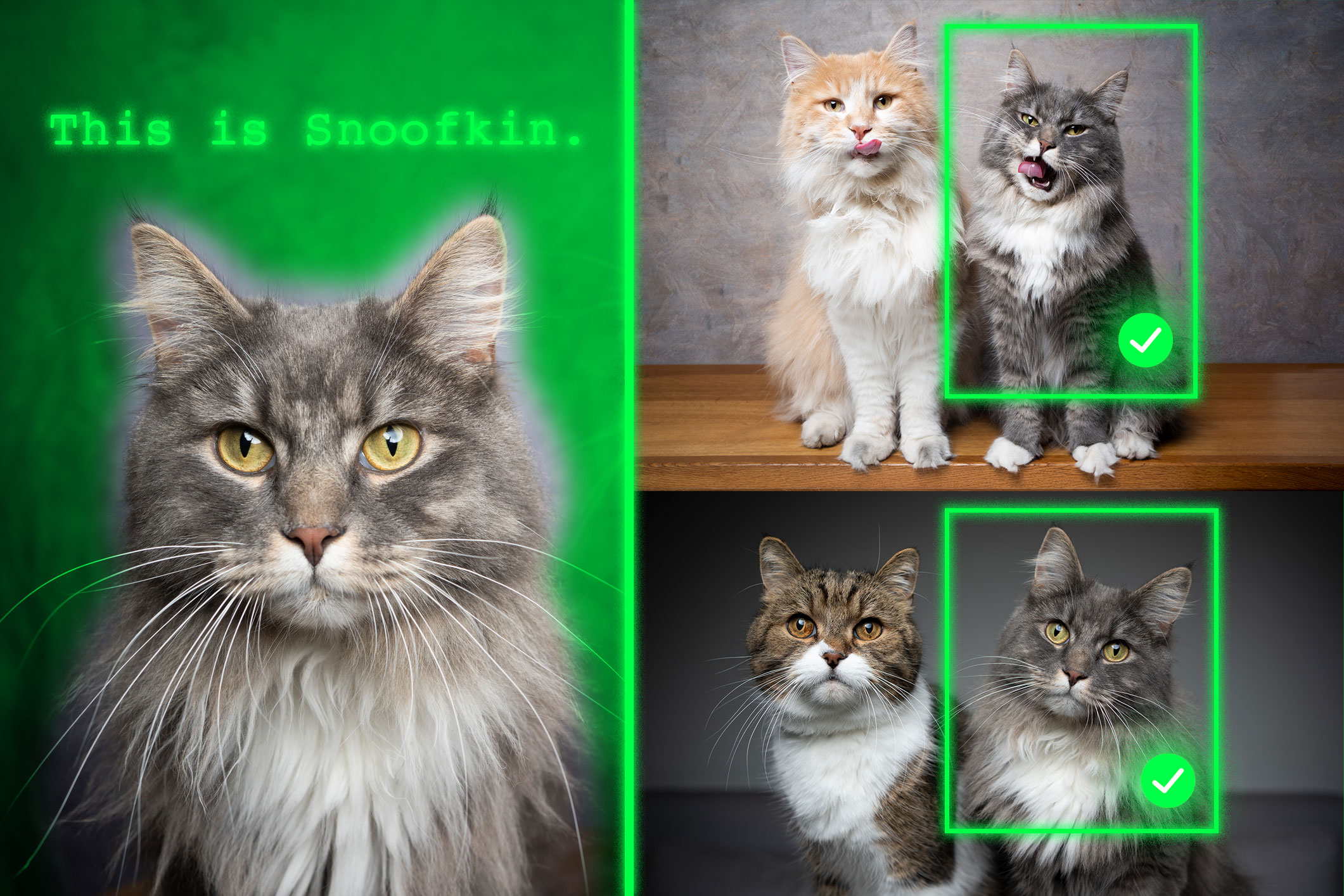

麻省理工学院研究人员提出了一种新方法,利用视频追踪数据提升视觉语言模型(VLM)在图像中定位个性化物体的能力,如宠物。这种方法提高了定位准确性,为未来AI在物体追踪和辅助技术方面的应用提供了可能性。

🎯

关键要点

- 麻省理工学院研究人员提出了一种新方法,利用视频追踪数据提升视觉语言模型(VLM)在图像中定位个性化物体的能力。

- 该方法提高了定位准确性,尤其是在识别个性化物体如宠物方面。

- 研究人员设计了一个新的数据集,利用视频追踪数据,要求模型关注上下文线索来识别个性化物体。

- 经过重新训练的模型在定位个性化物体的任务中超越了现有的最先进系统。

- 研究发现,视觉语言模型(VLM)在上下文学习能力上不如大型语言模型(LLM),需要改进。

- 研究人员通过使用伪名称而非实际物体类别名称来防止模型作弊,迫使模型关注上下文。

- 使用新数据集微调VLM后,个性化定位准确性平均提高了12%,使用伪名称时提高了21%。

- 未来研究将探讨VLM为何不继承LLM的上下文学习能力,并寻找改进VLM性能的新机制。

- 该研究为个性化物体定位提供了新的视角,并为视觉语言基础模型的广泛应用奠定了基础。

❓

延伸问答

麻省理工学院的研究人员提出了什么新方法来提升视觉语言模型的能力?

研究人员提出了一种利用视频追踪数据的新方法,以提高视觉语言模型在图像中定位个性化物体的能力。

该方法在个性化物体定位方面的准确性提高了多少?

使用新数据集微调后,个性化定位准确性平均提高了12%,使用伪名称时提高了21%。

研究人员如何防止模型在定位个性化物体时作弊?

研究人员使用伪名称而非实际物体类别名称,迫使模型关注上下文线索来识别物体。

视觉语言模型在上下文学习能力上与大型语言模型相比有什么不足?

研究发现,视觉语言模型在上下文学习能力上不如大型语言模型,尚需改进。

该研究对未来AI应用有什么潜在影响?

该研究为未来AI在物体追踪和辅助技术方面的应用提供了可能性,尤其是在个性化物体定位方面。

研究人员是如何设计新的数据集以提升模型性能的?

研究人员设计了一个新的数据集,利用视频追踪数据,要求模型关注上下文线索来识别个性化物体。

➡️